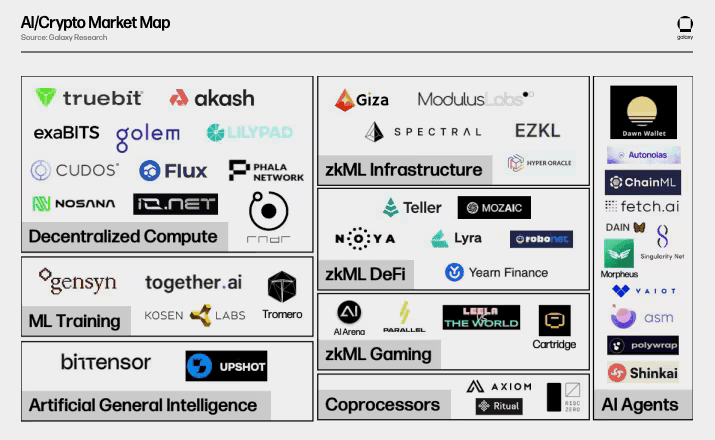

Vergeet memecoins en hypecycli — AI-utility-tokens zijn een nieuw soort crypto dat golven maakt, en dit keer doen ze daadwerkelijk iets.

Ze bouwen in alle stilte aan de brug tussen blockchain en de enorme rekeninfrastructuur die kunstmatige intelligentie aandrijft. En terwijl AI zijn weg baant in alles, van scripts schrijven tot het ontwerpen van moleculen, evolueren deze tokens mee — van speculatieve fiches op een casinotafel naar echte hulpmiddelen die gedecentraliseerde netwerken draaiende houden.

Drie projecten staan aan de frontlinie van deze verschuiving: Bittensor (TAO), Fetch.ai (FET) en Render Token (RNDR).

Bittensor opereert een gedecentraliseerd machinelearning-netwerk waarin bijdragers gezamenlijk AI-modellen trainen en beloningen verdienen. Fetch.ai zet autonome economische agents in die taken uitvoeren in toeleveringsketens, energiemarkten en decentralized finance. Render Network transformeert ongebruikte GPU-kracht in een peer-to-peer-marktplaats voor 3D-rendering, visuele effecten en AI-inferentie.

Deze tokens vertegenwoordigen meer dan een incrementele innovatie.

Ze wijzen op een mogelijke architecturale verschuiving in crypto: weg van “digitaal goud”-verhalen rond schaarste en store-of-value, richting utility-gedreven ecosystemen waar tokens daadwerkelijk rekenwerk faciliteren.

Terwijl Bitcoin (BTC) en Ethereum (ETH) zich vestigden via monetaire en platformverhalen, stellen AI-utility-tokens een andere waardethese voor: tokens als toegangssleutels tot gedecentraliseerde infrastructuur, betaalrails voor machine-tot-machine-economieën en beloningsmechanismen voor computationele middelen.

Hier duiken we diep in waarom deze tokens nu in de belangstelling staan, analyseren we hun utility-modellen en tokenomics, beoordelen we concurrentiedynamiek en narratieve risico’s, verkennen we waarderingskaders en bekijken we bredere implicaties voor hoe utility-tokens zich kunnen ontwikkelen ten opzichte van gevestigde store-of-value-activa.

Waarom utility-tokens, waarom nu

De convergentie van AI-versnelling en blockchaininfrastructuur heeft omstandigheden gecreëerd die rijp zijn voor adoptie van utility-tokens. Verschillende macrodrijvers verklaren de huidige momentum.

Ten eerste is de vraag naar AI-rekenkracht geëxplodeerd.

Het trainen van geavanceerde taalmodellen en het genereren van synthetische media vereist enorme GPU-resources, wat knelpunten veroorzaakt in gecentraliseerde cloudinfrastructuur. Traditionele aanbieders zoals AWS en Google Cloud hebben moeite om aan de vraag te voldoen, met datacenters die gemiddeld slechts 12–18% benutting halen terwijl GPU-tekorten aanhouden. Deze disbalans tussen vraag en aanbod heeft de kosten van compute opgedreven, waardoor gedecentraliseerde alternatieven economisch aantrekkelijk worden.

Ten tweede richtten eerdere cryptocycles zich vooral op DeFi-protocollen en store-of-value-narratieven. Maar rond 2024–2025 kwamen infrastructuur en compute naar voren als dominant thema.

The total crypto market cap crossed $4 trillion in 2025, and within that growth, AI-crypto projects captured significant investor attention.

Projecten die tastbare infrastructuur boden in plaats van puur financiële producten, wonnen aan tractie naarmate de markt volwassen werd.

Ten derde biedt tokenisatie unieke voordelen voor het coördineren van gedistribueerde middelen.

Gedecentraliseerde GPU-netwerken zoals Render kunnen ongebruikte rekenkracht wereldwijd bundelen, wat tot 90% kostenbesparing mogelijk maakt ten opzichte van gecentraliseerde alternatieven. Tokens vormen de economische coördinatielaag: makers betalen voor renderdiensten in RNDR, nodeoperators verdienen beloningen voor het bijdragen van GPU-capaciteit en het protocol behoudt transparantie via blockchaintransacties.

Het utility-model staat in schril contrast met store-of-value-tokens. De waardepropositie van Bitcoin draait om schaarste door vaste voorraad en de positionering als digitaal goud. Ethereum voegt programmeerbaarheid toe maar ontleent nog steeds veel waarde aan zijn rol als settlementlaag en onderpand. Utility-tokens zoals TAO, FET en RNDR ontlenen hun waarde daarentegen aan netwerkgebruik: meer AI-modellen die op Bittensor worden getraind, meer autonome agents die op Fetch.ai worden ingezet, meer renderingopdrachten op Render Network leiden theoretisch tot hogere tokenvraag.

Deze verschuiving richting utility is niet louter een verhaal. Render Network verwerkt renderopdrachten voor grote studio’s via gedecentraliseerde nodes. Fetch.ai demonstreerde toepassingen in de echte wereld, waaronder autonome parkeercoördinatie in Cambridge en systemen voor energiehandel. Bittensor’s subnet-architectuur omvat nu 128 actieve subnets gericht op verschillende AI-domeinen, van tekstgeneratie tot eiwitvouwing.

Utility-adoptie kent echter uitdagingen. De meeste tokens worden nog vooral verhandeld op speculatieve waarde in plaats van gebruiksfundamentals. Tokenvelocity — hoe snel tokens van eigenaar wisselen — kan prijsstabiliteit ondermijnen als gebruikers beloningen direct omzetten in andere activa. De vraag is of deze protocollen voldoende gebruik kunnen genereren om hun waarderingen te dragen, of dat ze narratief-gedreven activa blijven die gevoelig zijn voor hypecycli.

Ook interessant: Bitcoin Decentralization Faces A Problem: Mining Power Tied To Just Three Nations

Token 1: Bittensor (TAO) diepgaande analyse

Wat Bittensor is

Bittensor is een open-sourceprotocol dat een gedecentraliseerd machinelearning-netwerk aandrijft. In tegenstelling tot traditionele AI-ontwikkeling, die geconcentreerd is in de labs van techgiganten, creëert Bittensor een peer-to-peer-marktplaats waar ontwikkelaars machinelearning-modellen bijdragen, validators hun kwaliteit beoordelen en bijdragers beloningen verdienen op basis van de informatie-waarde die ze leveren aan de collectieve intelligentie.

Het protocol is opgericht door Jacob Steeves en Ala Shaabana, computerwetenschappers die het netwerk lanceerden om AI-ontwikkeling te democratiseren. De ambitie is groot: een markt creëren voor kunstmatige intelligentie waar producenten en consumenten in een trustless, transparente context interageren zonder gecentraliseerde poortwachters.

Utility en werking

De TAO-token vervult meerdere functies binnen het ecosysteem. In de kern biedt TAO toegang tot de collectieve intelligentie van het netwerk. Gebruikers halen informatie uit getrainde modellen door in TAO te betalen, terwijl bijdragers die waarde toevoegen aan het netwerk meer stake verdienen. Dit creëert een prikkelstructuur waarbij hoogwaardige modelbijdragen grotere beloningen ontvangen.

Het netwerk werkt via een subnet-architectuur. Elk subnet specialiseert zich in verschillende AI-taken — natuurlijke taalverwerking, beeldherkenning, datavoorspelling — en gebruikt eigen evaluatielogica. Modellen concurreren binnen subnets op basis van nauwkeurigheid en efficiëntie. Validators staken TAO om modeluitvoer te beoordelen en eerlijke scoring te waarborgen. Nominators steunen specifieke validators of subnets en delen in beloningen, vergelijkbaar met delegated-proof-of-stake-systemen.

Dit modulaire ontwerp stelt Bittensor in staat om over tal van AI-domeinen tegelijk te schalen. In plaats van een monolithisch netwerk fungeert het protocol als infrastructuur voor gespecialiseerde AI-marktplaatsen, elk met eigen evaluatiecriteria en beloningsstructuren.

Tokenomics

De tokenomics van Bittensor weerspiegelen het schaarstemodel van Bitcoin. TAO heeft een vaste voorraad van 21 miljoen tokens, met uitgifte volgens een halveringsschema. De eerste halvering vond plaats in 2025, waarbij de dagelijkse uitgifte daalde van 7.200 naar 3.600 tokens. Dit deflatoire mechanisme creëert aanbodschaarste, vergelijkbaar met de vierjarige cycli van Bitcoin.

Momenteel zijn ongeveer 9,6 miljoen TAO-tokens in omloop, ongeveer 46% van de totale voorraad. De circulerende voorraad zal blijven groeien, maar in een afnemend tempo door de halveringen, met volledige distributie over meerdere decennia.

Miningbeloningen gaan naar bijdragers die de intelligentie van het netwerk aantoonbaar verbeteren. Validators verdienen beloningen voor nauwkeurige beoordeling van modelbijdragen. Deze dubbele beloningsstructuur stimuleert zowel modelontwikkeling als netwerkintegriteit.

Usecases

De toepassingen van Bittensor beslaan meerdere domeinen. Collective learning stelt zorginstellingen in staat om modellen te trainen op gevoelige medische data zonder de onderliggende informatie te delen — aangetoond bij COVID-19-detectie op basis van röntgenbeelden van de borstkas met 90% nauwkeurigheid. Financiële instellingen kunnen gezamenlijk fraudedetectiemodellen trainen terwijl ze hun eigen data privé houden.

De subnet-structuur maakt gespecialiseerde AI-diensten mogelijk. Subnets voor tekstgeneratie concurreren om hoogwaardige taaluitvoer te produceren. Voorspellingsmarkten gebruiken de inferentiecapaciteiten van Bittensor. Embedding-diensten verwerken en encoderen data voor downstream-toepassingen. Elk subnet opereert autonoom en draagt tegelijk bij aan de bredere intelligentiemarkt.

De adoptie door ondernemingen staat nog in de kinderschoenen, maar groeit. Deutsche Digital Assets en Safello lanceerden in november 2025 's werelds eerste fysiek gedekte Bittensor-ETP aan de SIX Swiss Exchange, waarmee institutionele beleggers gereguleerde blootstelling aan TAO krijgen. Deze ontwikkeling wijst op een volwassen wordende interesse die verder gaat dan puur retail-speculatie.

Concurrentie en Ecosysteem

Bittensor concurreert in de gedecentraliseerde AI-ruimte met projecten als SingularityNET (AGIX) en Ocean Protocol (OCEAN). SingularityNET exploiteert een AI-marktplaats waar ontwikkelaars algoritmen en diensten te gelde maken. Ocean richt zich op datamarktplaatsen en compute-to-data-toepassingen. Elk project benadert gedecentraliseerde AI anders: Bittensor legt de nadruk op collaboratieve modeltraining, SingularityNET focust op dienstenmarktplaatsen, Ocean geeft prioriteit aan data-assets.

De grootste concurrentiedreiging komt echter van gecentraliseerde AI-giganten. OpenAI, Google DeepMind en Anthropic beschikken over enorme middelen, propriëtaire datasets en toptalent. Deze partijen kunnen sneller itereren en krachtigere modellen inzetten dan wat gedecentraliseerde alternatieven momenteel kunnen bereiken. Bittensor moet aantonen dat zijn collaboratieve aanpak modellen oplevert die kunnen concurreren met gecentraliseerde alternatieven – niet alleen filosofisch aantrekkelijk, maar technisch superieur voor specifieke use-cases.

De WASM (WebAssembly) smartcontract-upgrade van het netwerk in 2025 breidde de functionaliteit uit en maakte features mogelijk zoals het uitlenen van middelen, geautomatiseerde handel in subnet-tokens en cross-subnettoepassingen. Deze infrastructuurontwikkeling is erop gericht een meer omvattende digitale economie te creëren die verder gaat dan louter modeltraining.

Narratief Risico en Waardering

De waardering van Bittensor wordt gekenmerkt door verschillende spanningsvelden. Op 12 november 2025 handelde TAO rond $362-390, met een marktkapitalisatie van ongeveer $3,7-4,1 miljard. De token bereikte eerder in 2025 pieken boven $400, maar kende volatiliteit die typisch is voor crypto-assets.

Optimisten wijzen op verschillende groeifactoren.

Het halveringsmechanisme creëert deflatoire druk, wat de prijs mogelijk ondersteunt als de vraag stabiel blijft. Analisten projecteren koersdoelen variërend van $360-500 in 2026 tot meer agressieve prognoses boven $1.000 tegen 2027-2030, hoewel deze voorspellingen met aanzienlijke onzekerheid gepaard gaan.

De fundamentele vraag is of het netwerkgebruik de waardering rechtvaardigt.

Token-velocity-theorie suggereert dat utility-tokens die hoofdzakelijk voor transacties worden gebruikt, moeite hebben hun waarde te behouden omdat gebruikers beloningen snel omzetten in andere assets.

Bittensor verzacht dit via staking – validators moeten TAO vastzetten om deel te nemen aan het netwerkconsensusmechanisme, wat het circulerende aanbod en de omloopsnelheid vermindert.

Als Bittensor er echter niet in slaagt om aanzienlijke AI-workloads aan te trekken bovenop de huidige subnetactiviteit, wordt de token vooral speculatief. Het protocol moet aantonen dat gedecentraliseerde modeltraining voordelen biedt die overtuigend genoeg zijn om ontwikkelaars te laten overstappen van gevestigde frameworks zoals TensorFlow of PyTorch in combinatie met gecentraliseerde rekenkracht.

Risico’s omvatten technologische concurrentie, regelgevingsonzekerheid rond AI-systemen, potentiële beveiligingslekken in het protocol en de uitdaging om decentralisatie te handhaven naarmate het netwerk schaalt. De recente wekelijkse daling van 20% onderstreept de aanhoudende volatiliteit, zelfs nu de bredere institutionele interesse groeit.

Token 2: Fetch.ai (FET) Deep Dive

Wat Fetch.ai Is

Fetch.ai is een blockchain-ecosysteem dat AI en automatisering inzet om autonome economische agenten mogelijk te maken – digitale entiteiten die zelfstandig taken uitvoeren namens gebruikers, apparaten of organisaties.

Fetch.ai, opgericht in 2017 en gelanceerd via een IEO op Binance in maart 2019, wil de toegang tot AI-technologie democratiseren via een gedecentraliseerd netwerk.

De bepalende eigenschap van het platform zijn Autonomous Economic Agents (AEAs).

Dit zijn software-entiteiten die met een zekere mate van autonomie opereren en taken uitvoeren zoals het optimaliseren van toeleveringsketens, het beheren van smartgrid-energiesystemen, het coördineren van transportnetwerken en het automatiseren van DeFi-handel. Agenten ontdekken en onderhandelen met elkaar via een Open Economic Framework en creëren zo een machine-to-machine-economie.

CEO Humayun Sheikh leidt een team dat zich een toekomst voorstelt waarin AI-gebaseerde systemen het datamonopolie van grote techbedrijven doorbreken. Door AI-capaciteiten over een gedecentraliseerd netwerk te verspreiden, positioneert Fetch.ai zich als infrastructuur voor de “agentische economie” – een toekomst waarin autonome agenten individuen en apparaten vertegenwoordigen in ontelbare microtransacties en coördinatietaken.

Nut van FET

De FET-token fungeert als het primaire ruilmiddel binnen het Fetch.ai-ecosysteem.

Wanneer twee agenten verbinding maken, communiceren en onderhandelen, betaalt de één de ander voor data of diensten in FET. Belangrijk is dat de token micropayments van fracties van een cent ondersteunt, wat de fijnmazige transacties mogelijk maakt die nodig zijn voor een machine-to-machine-economie.

FET heeft verschillende specifieke functies. De token betaalt voor transactiekosten op het netwerk en voor de uitrol van AI-diensten. Ontwikkelaars die autonome agenten bouwen, betalen in FET om toegang te krijgen tot de machinelearningvoorzieningen en rekenbronnen van het netwerk. Gebruikers kunnen FET staken om bij te dragen aan de netwerkbeveiliging via het Proof-of-Stake-consensusmechanisme van Fetch.ai en beloningen verdienen door validator-nodes te ondersteunen.

Agenten moeten ook FET deponeren om zich op het netwerk te registreren, waardoor een stakingvereiste ontstaat die hun recht om te opereren financiert. Dit depositomechanisme zorgt ervoor dat agenten economisch belang hebben (“skin in the game”), waardoor spam wordt verminderd en kwalitatieve bijdragen worden gestimuleerd.

Tokenomics en Structuur

FET bestaat in meerdere vormen op verschillende blockchains. Oorspronkelijk gelanceerd als ERC-20-token op Ethereum, heeft Fetch.ai later zijn eigen mainnet uitgerold, gebouwd binnen het Cosmos-ecosysteem. Gebruikers kunnen een brug gebruiken tussen de native versie en het ERC-20-formaat, waarbij de keuze invloed heeft op transactiekosten en compatibiliteit met verschillende DeFi-ecosystemen.

De maximale voorraad bedraagt ongeveer 1 miljard FET-tokens, al verschillen de exacte verdeling en vestingschema’s.

De token opereert zowel op Ethereum (voor ERC-20-compatibiliteit) als op Binance Smart Chain (als BEP-20-token), met een 1:1 tokenbrug die gebruikers in staat stelt te wisselen tussen netwerken afhankelijk van hun behoeften.

Fetch.ai maakt deel uit van de Artificial Superintelligence Alliance, een samenwerking met SingularityNET en Ocean Protocol die in 2024 werd aangekondigd. Het doel van de alliantie is een verenigd gedecentraliseerd AI-ecosysteem te creëren, met een gecombineerde marktkapitalisatie die mikt op een top-20-positie binnen crypto.

Tokenhouders van AGIX en OCEAN kunnen hun tokens omwisselen naar FET, wat mogelijk liquiditeit en ontwikkelingsinspanningen over de projecten heen consolideert.

Use-Cases

De toepassingen van Fetch.ai bestrijken meerdere sectoren. In smart cities coördineren agenten parkeren en verkeer. Een pilot in Cambridge liet zien hoe agenten autonoom parkeerplaatsen vinden, op plekken bieden en betalingen in real time verwerken. Door ride-hailing toe te voegen kan het netwerk voertuigen dispatchen op basis van vraagpatronen.

Energiemarkten vormen een andere belangrijke use-case.

Huiseigenaren met zonnepanelen op het dak zetten agenten in die overtollige energie rechtstreeks verhandelen met buren, waarbij gecentraliseerde nutsbedrijven worden omzeild. Agenten onderhandelen over prijzen, verifiëren transacties en handelen afrekeningen in FET af, waardoor een peer-to-peer-energiemarkt ontstaat.

In logistiek en toeleveringsketens optimaliseren agenten routering, voorraadbeheer en vervoerderskeuze.

Een bedrijf kan een agent inzetten die leveranciers via het netwerk ontdekt, over voorwaarden onderhandelt, prijzen vergelijkt, kwaliteitscores controleert, bestellingen plaatst, verzending regelt en betalingen afhandelt – allemaal autonoom op basis van vooraf gedefinieerde parameters.

DeFi-automatisering toont veel potentieel. Agenten kunnen complexe handelsstrategieën uitvoeren, liquiditeitsverschaffing over protocollen optimaliseren en zekerheidsposities in leenmarkten beheren. Midden 2025 won een door Fetch.ai ondersteunde agent de hackathon van UC Berkeley voor luchtverkeerscoördinatie, waarbij werd gedemonstreerd hoe vluchtslots worden toegewezen, vertragingen worden beheerd en congestiezones worden uitonderhandeld door autonome agenten die met live data werken.

De samenwerking met Interactive Strength (TRNR) creëerde intelligente fitnesscoach-agenten die prestatiedata analyseren, gepersonaliseerde suggesties doenworkouts en het onderhandelen over trainingsschema's met gebruikers, allemaal afgerekend via FET-betalingen.

Concurrentielandschap en risico

Fetch.ai concurreert met andere op agents gerichte protocollen zoals Autonolas (OLAS), dat een acceleratorprogramma voor autonome agents aanbiedt. Virtuals Protocol kwam eind 2024 op als een grote concurrent en bouwt een AI-agent-launchpad op Base en Solana met een eigen ecosysteem van getokeniseerde agents.

De bredere concurrentiedreiging komt van gecentraliseerde AI-platforms.

Google, Amazon en Microsoft bieden geavanceerde AI-diensten via hun cloudplatforms zonder dat gebruikers eigen tokens hoeven aan te houden.

Voor Fetch.ai om te slagen, moet het gedecentraliseerde agentmodel duidelijke voordelen bieden – privacybescherming, censuurbestendigheid, directe peer‑to‑peer-coördinatie – die de complexiteit van het beheren van crypto‑activa rechtvaardigen.

Regelgevingsonzekerheid brengt risico's met zich mee. AI‑systemen die autonoom opereren, kunnen onderworpen worden aan streng toezicht onder opkomende regulering. De risicogebaseerde aanpak van de EU AI Act zou de agents van Fetch.ai kunnen classificeren als “hoog risico” wanneer zij actief zijn in sectoren zoals energie of logistiek, wat audits en toezicht vereist die de operationele kosten verhogen.

Scepsis over het verhaal van de agent‑economie blijft bestaan.

Critici betwijfelen of autonome agents brede mainstream‑adoptie zullen bereiken of een niche‑technische curiositeit blijven. Als de machine‑tot‑machine‑economie niet op schaal van de grond komt, wordt FET een oplossing op zoek naar een probleem.

Op 12 november 2025 handelde FET rond $0,25–0,30, na gedurende het jaar aanzienlijke volatiliteit te hebben gekend. De token kreeg aandacht toen Interactive Strength plannen aankondigde voor een crypto‑schatkist van $500 miljoen rond FET, wat institutioneel vertrouwen in het langetermijnpotentieel van het project signaleerde.

Analisten projecteren koersdoelen van $6,71 tegen 2030, al gaan dergelijke prognoses gepaard met aanzienlijke onzekerheid. De fundamentele vraag is of agent‑gebaseerde coördinatie voldoende waarde biedt om de token‑economie te rechtvaardigen, of dat eenvoudigere gecentraliseerde alternatieven de overhand krijgen.

Recente ontwikkelingen zijn veelbelovend. Fetch.ai lanceerde begin 2025 een accelerator van $10 miljoen om te investeren in startups die op zijn infrastructuur bouwen. Dit geeft blijk van een inzet voor ecosysteemgroei voorbij louter speculatieve handel.

Token 3: Render Token (RNDR) diepgaande analyse

Wat Render Network is

Render Network is een gedecentraliseerd GPU‑renderplatform dat makers die rekenkracht nodig hebben verbindt met individuen en organisaties die over ongebruikte GPU‑resources beschikken. Oorspronkelijk bedacht in 2009 door OTOY‑CEO Jules Urbach en in april 2020 publiek gelanceerd, is Render uitgegroeid tot een toonaangevend gedecentraliseerd fysiek infrastructuurnetwerk (DePIN) voor grafische en AI‑workloads.

Het netwerk functioneert als een peer‑to‑peer‑marktplaats. Makers dienen renderopdrachten in – 3D‑graphics, visuele effecten, architectonische visualisaties, AI‑inferentie – bij het netwerk.

Node‑operators met vrije GPU‑capaciteit nemen opdrachten op en verwerken die in ruil voor RNDR‑tokens. Het platform maakt gebruik van OTOY's toonaangevende OctaneRender‑software en biedt rendercapaciteiten op professioneel niveau via gedistribueerde infrastructuur.

Render Network pakt een fundamentele bottleneck aan: renderen van hoge kwaliteit vereist enorme GPU‑kracht, maar gecentraliseerde clouddiensten zijn duur en kunnen tijdens piekuren over onvoldoende capaciteit beschikken. Door onderbenutte GPU's wereldwijd te bundelen, democratiseert Render de toegang tot professionele rendertools tegen een fractie van de traditionele kosten.

Utility‑token RNDR

De RNDR‑token (nu RENDER na de migratie naar Solana) fungeert als de native utility‑token van het netwerk. Makers betalen voor renderdiensten in RENDER, waarbij de kosten worden bepaald door de vereiste GPU‑kracht, gemeten in OctaneBench (OBH) – een gestandaardiseerde eenheid die door OTOY is ontwikkeld om rendercapaciteit te kwantificeren.

Node‑operators verdienen RENDER voor het voltooien van opdrachten.

Het netwerk implementeert een getrapt reputatiesysteem: Tier 1 (Trusted Partners), Tier 2 (Priority) en Tier 3 (Economy). Node‑operators van een hogere tier rekenen premietarieven maar bieden gegarandeerde betrouwbaarheid. De reputatiescores van makers beïnvloeden de snelheid van toewijzing van opdrachten – wie een sterke geschiedenis heeft, krijgt sneller toegang tot resources.

Governancerechten horen bij RENDER‑tokens. Houders stemmen over netwerkupgrades, protocolwijzigingen en financieringsvoorstellen via de Render DAO. Deze gedecentraliseerde governance zorgt ervoor dat de gemeenschap de evolutie van het netwerk vormgeeft in plaats van alleen een gecentraliseerde stichting.

Het Burn‑and‑Mint Equilibrium‑mechanisme dat in januari 2023 werd ingevoerd, beheert het tokenaanbod dynamisch. Wanneer makers voor renderen betalen, wordt 95% van de tokens verbrand en uit omloop gehaald. Node‑operators ontvangen nieuw geslagen tokens om het economische evenwicht te behouden. Dit ontwerp maakt RENDER potentieel deflatoir naarmate het netwerkgebruik toeneemt, aangezien het verbrandingspercentage de mint‑rate kan overtreffen als de vraag sterk is.

Tokenomics

RENDER migreerde eind 2023 van Ethereum naar Solana na een community‑stemming. Deze overgang was bedoeld om te profiteren van Solana's snellere transacties en lagere kosten. De oorspronkelijke RNDR‑token (ERC‑20) op Ethereum werd geüpgraded naar RENDER (SPL‑token) op Solana. De totale voorraad is begrensd op 644.168.762 tokens, met ongeveer 517 miljoen in omloop vanaf 2025.

De tokenverdeling kende 25% toe aan publieke verkopen, 10% aan reserves en 65% in escrow om de vraag‑ en aanbodstromen te moduleren. Deze reserve stelt de stichting in staat de beschikbare tokenvoorraad te beheren naarmate het netwerk schaalt.

Use‑cases

Render Network bedient meerdere sectoren. Film‑ en tv‑productiebedrijven gebruiken het netwerk voor het renderen van visuele effecten. Grote studio's hebben projecten gerenderd via gedecentraliseerde nodes, wat de geschiktheid van het systeem voor professionele workflows aantoont, met end‑to‑end‑encryptie ter bescherming van intellectueel eigendom.

Game‑ontwikkelaars benutten Render voor 3D‑assetcreatie en realtime‑rendering.

Metaverse‑projecten vertrouwen op het netwerk voor het genereren van meeslepende omgevingen en avatargraphics. De schaalbaarheid van gedistribueerde GPU‑kracht stelt makers in staat rendercapaciteit op te schalen wanneer nodig, zonder te investeren in dure lokale hardware.

Architecten en productontwerpers gebruiken Render voor hoogwaardige 3D‑visualisaties. Architectenbureaus creëren virtual‑reality‑rondleidingen door gebouwen nog vóór de bouw. Productontwerpers kunnen op schaal prototypes maken en texturen en kleuren testen via geparallelliseerde GPU‑rendering.

AI‑inferentie is een groeiende use‑case.

In juli 2025 nam Render NVIDIA RTX 5090‑GPU's op, specifiek voor AI‑compute‑workloads in de Verenigde Staten. Het trainen van bepaalde AI‑modellen, vooral die voor beeld‑ of videogeneratie, profiteert van gedistribueerde GPU‑kracht. De infrastructuur van het netwerk kan AI‑training aanzienlijk versnellen in vergelijking met op één machine gebaseerde opstellingen.

Concurrentiedynamiek

Render concurreert met zowel gecentraliseerde als gedecentraliseerde aanbieders. Traditionele GPU‑clouddiensten van AWS, Google Cloud en gespecialiseerde aanbieders zoals CoreWeave leveren gestroomlijnde interfaces en betrouwbare SLA's. Ze rekenen echter premietarieven en kunnen beperkte capaciteit hebben tijdens piekperioden.

In de gedecentraliseerde ruimte omvatten concurrenten Akash Network (AKT), io.net (IO) en Aethir. Elk platform hanteert een andere benadering voor de coördinatie van GPU‑marktplaatsen – Akash richt zich op bredere cloudinfrastructuur, io.net legt de nadruk op AI/ML‑workloads, Aethir richt zich op gaming en entertainment. Render onderscheidt zich door zijn integratie met OTOY's professionele rendersoftware en zijn gevestigde reputatie onder creatieve professionals.

De vraag hoe waarde wordt vastgelegd, blijft bestaan. GPU‑rekenkracht wordt in toenemende mate gecommoditiseerd naarmate meer aanbieders de markt betreden.

Render moet aantonen dat zijn gedecentraliseerde model duidelijke voordelen biedt – kostenefficiëntie, wereldwijde beschikbaarheid, censuurbestendigheid – die het gebruik van crypto‑tokens rechtvaardigen in plaats van creditcards bij gecentraliseerde aanbieders.

Partnerschappen met grote bedrijven zorgen voor validatie. Ari Emanuel (co‑CEO van Endeavor) heeft Render Network publiekelijk gesteund en deals gesloten met Disney, HBO, Facebook en Unity. Deze partnerschappen duiden op mainstream‑erkenning, hoewel het omzetten van deze relaties in consistent netwerkgebruik een uitdaging blijft.de uitdaging.

Op 12 november 2025 werd RENDER verhandeld rond $4,50-5,00, met een marktkapitalisatie van ongeveer $2,5-3 miljard. De token kende significante groei in 2024, met een stijging van meer dan 13.300% ten opzichte van de initiële prijs in het begin van 2024, al is de koers sindsdien geconsolideerd. Analisten schrijven dit toe aan AI- en GPU/NVIDIA-narratieven, waarbij de samenwerking met Apple extra geloofwaardigheid biedt.

Risico’s omvatten concurrentie van gecentraliseerde aanbieders die efficiënter kunnen opschalen, mogelijke centralisatie van hardware doordat de mijnbouweconomie grote partijen bevoordeelt, en de vraag of gedecentraliseerde GPU-marktplaatsen duurzame adoptie bereiken of een niche-oplossing blijven.

Vergelijkende Analyse: Utility-tokens vs Store-of-Value-tokens

AI-utility-tokens werken volgens fundamenteel andere waardeproposities dan store-of-value-tokens zoals Bitcoin en Ethereum. Inzicht in deze verschillen verduidelijkt zowel de kansen als de uitdagingen voor de utility-token-categorie.

Doel en vraagdrivers

De waarde van Bitcoin komt primair voort uit zijn positionering als digitaal goud – een schaars, gedecentraliseerd oppotmiddel en hedge tegen monetaire inflatie. Bitcoin’s maximale aanbod van 21 miljoen en een marktkapitalisatie van meer dan $2 biljoen positioneren het als een macro-activaklasse. Ethereum voegt programmeerbaarheid toe en ontleent waarde aan zijn functie als settlementlaag voor DeFi-protocollen, NFT’s en andere applicaties, waarbij de vraag naar ETH voortkomt uit gas fees en stakingvereisten.

Utility-tokens zoals TAO, FET en RENDER ontlenen hun waarde daarentegen aan netwerkgebruik. In theorie correleert de vraag met verwerkte computationele taken, uitgerolde agents en voltooide rendering-taken. Meer AI-modellen die op Bittensor worden getraind, zouden de vraag naar TAO moeten vergroten om toegang tot intelligentie te krijgen. Meer autonome agents op Fetch.ai zouden FET-transacties moeten stimuleren. Meer rendering-jobs zouden tot meer verbranding van RENDER-tokens moeten leiden.

Tokenomics en governance

Store-of-value-tokens leggen de nadruk op schaarste. Bitcoin’s vaste aanbod en halveringscycli zorgen voor een voorspelbare afname van de uitgifte. Ethereum is overgestapt op Proof-of-Stake en verbrandt met EIP-1559 transactiekosten, wat deflatoire druk introduceert wanneer het netwerkgebruik hoog is.

Utility-tokens hanteren uiteenlopende benaderingen. Bittensor imiteert het halveringsmodel van Bitcoin en creëert zo schaarste. Renders Burn-and-Mint Equilibrium koppelt het aanbod aan gebruik – bij hoge vraag worden meer tokens verbrand dan gemint, wat het aanbod verlaagt. Fetch.ai hanteert een vast aanbod, maar vertrouwt op stakingprikkels om de omloopsnelheid te verminderen.

De governance verschilt aanzienlijk. Bitcoin hanteert een conservatieve ontwikkelaanpak met minimale protocolwijzigingen.

Ethereum gebruikt off-chain coördinatie en uiteindelijk ruwweg consensus. Utility-tokens implementeren vaak directe on-chain governance, waarbij tokenhouders stemmen over protocolupgrades, financieringsvoorstellen en parameterwijzigingen, waardoor gemeenschappen een actievere rol in het beheer krijgen.

Adoptiepaden en gebruikersbasis

Store-of-value-tokens richten zich op beleggers die blootstelling aan crypto-activa zoeken of zich willen indekken tegen traditionele financiën. Bitcoin spreekt mensen aan die in sound money-principes geloven. Ethereum trekt ontwikkelaars en gebruikers aan die met DeFi en Web3-applicaties werken.

Utility-tokens moeten specifieke typen gebruikers aantrekken. Bittensor heeft AI-onderzoekers en data scientists nodig die kiezen voor gedecentraliseerde modeltraining in plaats van gevestigde frameworks. Fetch.ai heeft ontwikkelaars nodig die autonome agents bouwen voor toepassingen in de echte wereld. Render heeft creatieve professionals nodig die gedecentraliseerde infrastructuur vertrouwen voor productie-workflows.

Deze adoptiedrempels zijn hoger. Ontwikkelaars ondervinden overstapkosten van bestaande tools. Ondernemingen vereisen betrouwbaarheid en ondersteuning die jonge gedecentraliseerde netwerken mogelijk moeilijk kunnen bieden. Utility-tokens moeten duidelijke voordelen tonen – kosten, prestaties, functionaliteit – om inertie te doorbreken.

Mechanismen voor waardecaptatie

Store-of-value-tokens vangen waarde door schaarste en netwerkeffecten.

Naarmate meer deelnemers Bitcoin als store of value erkennen, neemt de vraag toe terwijl het aanbod vast blijft, wat de prijs opdrijft. Deze speculatieve lus versterkt zichzelf, maar zorgt ook voor volatiliteit.

Utility-tokens worden geconfronteerd met het velocity-probleem. Als gebruikers verdiende tokens direct omzetten naar fiat of andere crypto, voorkomt een hoge omloopsnelheid waardeopbouw. De Equation of Exchange (M×V = P×Q) suggereert dat bij een gegeven transactievolume (P×Q) een hogere omloopsnelheid (V) een lagere marktkapitalisatie (M) impliceert.

Protocollen beperken velocity via meerdere mechanismen. Stakingvereisten leggen tokens vast en verminderen het circulerende aanbod. Bittensor vereist dat validators TAO staken. Fetch.ai beloont stakers met netwerkfees. Burn-mechanismen zoals dat van Render verwijderen tokens permanent uit omloop. Governancerechten creëren prikkels om tokens vast te houden voor stemkracht.

Marktprestaties en trajecten

Bitcoin bereikte in 2025 all-time highs boven $126.000 en zette zijn traject als macro-asset voort. Ethereum herstelde zich van de neergang na 2022 en behield zijn positie als belangrijkste smart contract-platform.

AI-utility-tokens lieten volatielere prestaties zien. TAO werd in 2024-2025 verhandeld tussen $200-$750, met een marktkapitalisatie die piekte op $3,7-4,1 miljard. FET kende aanzienlijke koersbewegingen, met name rond de Artificial Superintelligence Alliance-aankondiging. RENDER zag explosieve groei in 2023-2024 voordat de koers consolideerde.

Deze tokens handelen zowel op speculatie als fundamentals. Wanneer AI-narratieven de cryptodiscussie domineren, presteren utility-tokens beter. Tijdens neergangen presteren ze vaak slechter dan Bitcoin en Ethereum, omdat beleggers uitwijken naar als veiliger beschouwde assets.

Co-existentie of concurrentie?

De vraag is of utility-tokens de “volgende golf” vormen of als complementaire categorie naast andere tokens bestaan. Bewijs wijst eerder op co-existentie. Store-of-value-tokens dienen andere doelen dan operationele tokens. Bitcoin functioneert als digitaal goud, Ethereum als programmeerbare settlementlaag, terwijl utility-tokens fungeren als brandstof voor specifieke applicaties.

Succes is echter niet gegarandeerd. De meeste utility-tokens kunnen mislukken als gebruik uitblijft of als gecentraliseerde alternatieven superieur blijken. De AI-crypto-marktkapitalisatie bereikte $24-27 miljard in 2025 – aanzienlijk, maar klein vergeleken met alleen al Bitcoin, dat meer dan $2 biljoen waard is.

Waarschijnlijke winnaars zullen laten zien:

- Aanhoudend netwerkgebruik dat losstaat van pure speculatie

- Duidelijke voordelen ten opzichte van gecentraliseerde alternatieven

- Sterke ontwikkelaarsecosystemen en adoptie door ondernemingen

- Effectieve mitigatie van velocity door staking of burning

- Governancemodellen die decentralisatie en efficiëntie in balans brengen

De ultieme test is of utility-tokens infrastructuur worden voor AI-workloads op schaal, of dat ze niche-oplossingen blijven die worden overschaduwd door gecentraliseerde cloudproviders.

Waardering, adoptiemetrics & narratief risico

Het evalueren van utility-tokens vereist andere kaders dan het beoordelen van store-of-value-assets. Terwijl Bitcoin kan worden gewaardeerd via stock-to-flow-modellen of als digitaal goud vergelijkbaar met edelmetalen, vragen utility-tokens om gebruiksgebaseerde metrics.

Belangrijke metrics voor utility-tokens

Netwerkgebruiksstatistieken vormen de basis. Voor Bittensor zijn onder meer de volgende metrics relevant:

- Aantal actieve subnets en hun specialisaties

- Compute-uren besteed aan modeltraining

- Aantal miners en validators die het netwerk beveiligen

- Transactievolume dat door het protocol stroomt

- Succesvolle modeldeployments die echte applicaties bedienen

Bittensor rapporteert 128 actieve subnets eind 2025, een substantiële toename ten opzichte van eerdere perioden. Of deze subnets echter echte vraag genereren of vooral speculatieve activiteit vertegenwoordigen, vergt diepgaander onderzoek.

Voor Fetch.ai zijn relevante metrics onder andere:

- Aantal uitgerolde autonome agents

- Agent-tot-agent-interacties en transactievolume

- Integraties in de echte wereld, in verschillende sectoren

- Partnerschappen met ondernemingen of overheden

- Deelname aan staking en aantal validators

Fetch.ai heeft proof-of-concepts laten zien in parkeercoördinatie, energietransacties en logistiek, maar de uitdaging is om van pilots naar brede adoptie te schalen.

Voor Render Network zijn cruciale indicatoren:

- Aantal rendering-jobs dat maandelijks wordt verwerkt

- Aantal actieve node-operators die GPU-capaciteit leveren

- Enterprise-klanten die het netwerk voor productie-workflows gebruiken

- Burn rate vergeleken met mint rate onder het Burn-and-Mint Equilibrium

- GPU-uren die op het gedecentraliseerde netwerk worden benut

Render heeft grote studiopartnerschappen veiliggesteld en verwerkt echte renderingworkloads, wat concretere gebruiksbewijzen biedt dan veel andere utility-tokens.

Tokenvelocity en burn-metrics

Tokenvelocity meet hoe snel tokens door de economie circuleren. Hoge velocity duidt erop dat gebruikers tokens direct uitgeven of omzetten, wat waardeopbouw verhindert. Lage velocity suggereert dat tokens langer worden aangehouden, mogelijk als store of value of voor staking rewards.

Bitcoin vertoont een omloopsnelheid van 4,1%, Ethereum 3,6%, wat duidt op volwassen activa die overwegend worden aangehouden in plaats van verhandeld. Utility-tokens laten doorgaans aanvankelijk hogere omloopsnelheden zien, omdat gebruikers tokens voor werk ontvangen en deze direct omzetten in stabiele valuta.

Burn‑mechanismen bestrijden hoge omloopsnelheid. Het systeem van Render verbrandt 95% van de betalingstokens bij elke transactie, waardoor aanbod wordt verwijderd. Als het burn‑tempo de mint‑snelheid overstijgt, daalt het circulerende aanbod, wat de prijs kan ondersteunen als de vraag constant blijft.

Het evalueren van burns vereist transparantie. Projecten zouden regelmatige burn‑rapporten moeten publiceren die tonen hoeveel tokens uit omloop zijn gehaald. Render levert deze gegevens, wat onafhankelijke verificatie van deflationaire claims mogelijk maakt.

Partnerschappen en Integraties in de Praktijk

Adoptie door ondernemingen wijst op daadwerkelijke utiliteit. De eerste ETP‑lancering van Bittensor op de SIX Swiss Exchange biedt institutionele toegang. Interactive Strengths FET‑schatkist van 500 miljoen dollar toont vertrouwen van bedrijven. Renders partnerschappen met Disney, HBO en Unity bevestigen de capaciteiten van het platform voor productie‑workflows.

Partnerschappen alleen garanderen echter geen blijvende inzet. Veel blockchainprojecten kondigen partnerschappen aan die niet uitmonden in significante omzet of netwerkactiviteit. Het volgen van het daadwerkelijke transactievolume dat uit bedrijfsrelaties voortkomt, biedt helderder inzicht.

Narratieve Risico’s

Diverse narratieve risico’s bedreigen de waarderingen van utility‑tokens:

AI + Crypto‑hype Zonder Resultaat: De convergentie van AI en blockchain creëert krachtige narratieven, maar als gedecentraliseerde AI‑systemen niet kunnen tippen aan de prestaties van gecentraliseerde alternatieven, zakken waarderingen in. De meeste experts verwachten dat slechts enkele AI‑crypto‑projecten op lange termijn zullen slagen en veel projecten speculatief blijven.

Compute Zonder Vraag: Het opbouwen van gedecentraliseerde GPU‑infrastructuur is zinloos als ontwikkelaars die niet gebruiken. Als het gebruik niet verder opschaalt dan vroege adopters en evangelisten, worden tokens oplossingen op zoek naar problemen. De vraag is of gedecentraliseerde compute een betekenisvol marktaandeel kan veroveren op AWS, Google Cloud en andere gecentraliseerde reuzen.

Regulatoire Bedreigingen: Overheden wereldwijd ontwikkelen AI‑regelgeving. Het risicogebaseerde raamwerk van de EU AI Act kan bepaalde AI‑systemen als hoogrisico classificeren, met vereiste audits en toezicht. Autonome agents die economische beslissingen nemen, kunnen onder een vergrootglas komen te liggen. Onzekerheid over de vraag of utility‑tokens als effecten gelden, verhoogt het regulatoire risico.

Hardware‑centralisatie: Gedecentraliseerde netwerken lopen het risico opnieuw gecentraliseerd te raken. Als mining of node‑operatie economisch alleen nog rendabel is voor grote partijen met schaalvoordelen, vervaagt de belofte van decentralisatie. GPU‑netwerken kunnen zich concentreren rond grote datacenters, waarmee het doel van peer‑to‑peer‑infrastructuur wordt ondermijnd.

Technische Beperkingen: Gedecentraliseerde systemen kennen inherente trade‑offs. Coördinatie‑overhead, latency en betrouwbaarheidsproblemen kunnen utility‑tokens verhinderen om te concurreren met geoptimaliseerde gecentraliseerde alternatieven. Als technische beperkingen onoverkomelijk blijken, stagneert adoptie.

Waarderingskaders

Traditionele financiële modellen hebben moeite met utility‑tokens. Discounted cash flow (DCF) werkt voor tokens met winstdeling—Augur betaalt REP‑houders voor netwerkwerk, waardoor kasstroomreeksen ontstaan die geschikt zijn voor DCF‑analyse. Maar pure utility‑tokens zonder dividenden missen duidelijke kasstromen om te verdisconteren.

De Equation of Exchange biedt één benadering: M×V = P×Q, waarbij M de market cap is (wat we willen oplossen), V de omloopsnelheid, P de prijs per transactie en Q de hoeveelheid transacties. Herschikt: M = P×Q / V. Dit impliceert dat de market cap gelijk is aan het transactievolume gedeeld door de omloopsnelheid.

Hoger transactievolume (P×Q) ondersteunt hogere waarderingen. Lagere omloopsnelheid (V) ondersteunt eveneens hogere waarderingen. Projecten moeten ofwel het gebruik verhogen of de omloopsnelheid verlagen – idealiter beide. Staking verlaagt de omloopsnelheid; burn‑mechanismen verlagen het aanbod; echte utiliteit verhoogt het transactievolume.

Metcalfe’s Law suggereert dat de netwerkwaarde groeit in verhouding tot het kwadraat van het aantal gebruikers. Naarmate meer deelnemers zich aansluiten bij Bittensor, Fetch.ai of Render, kunnen netwerkeffecten exponentiële waardegroei stimuleren. Deze wet veronderstelt echter dat alle verbindingen waardevol zijn – wat niet altijd geldt voor netwerken in een vroeg stadium.

Vergelijkende waardering kijkt naar soortgelijke projecten. Als Bittensor vergelijkbaar netwerkgebruik behaalt als SingularityNET of Ocean Protocol, biedt het vergelijken van market caps ruwe ijkpunten. De unieke tokenomics en use‑cases van elk project beperken echter het nut van directe vergelijkingen.

Uiteindelijk blijft de waardering van utility‑tokens speculatief. Totdat netwerken duurzaam gebruik laten zien dat losstaat van speculatie, weerspiegelen prijzen de kracht van het narratief en het marktsentiment minstens evenveel als de fundamentele waarde.

Wat Volgt: Scenario’s voor de Toekomst

Het traject voor AI‑utility‑tokens hangt af van diverse onzekere variabelen: tempo van technologieadoptie, regulatoire ontwikkelingen, concurrentie van gecentraliseerde aanbieders en het vermogen van tokens om waarde te vangen uit netwerkgebruik. Drie brede scenario’s lichten mogelijke toekomsten toe.

Best Case: Infrastructuurtokens Worden Kernlaag

In dit optimistische scenario krijgt gedecentraliseerde AI‑infrastructuur mainstream‑adoptie. Bittensor wordt het voorkeursplatform voor collaboratieve AI‑modeltraining en trekt grote onderzoeksinstellingen en ondernemingen aan. De subnet‑architectuur blijkt superieur aan gecentraliseerde frameworks voor bepaalde use‑cases—privacybeschermende zorg‑AI, gedecentraliseerde modelmarktplaatsen, crowdsourced intelligence.

De autonome agents van Fetch.ai verspreiden zich over sectoren heen. Slimme steden zetten agentnetwerken in voor verkeerscoördinatie, energiedistributie en publieke diensten. Supply chains standaardiseren op agent‑gebaseerde optimalisatie. DeFi‑protocollen integreren agents voor geautomatiseerde strategie‑uitvoering. De “agentic economy” materialiseert zoals voorspeld, met miljarden microtransacties gecoördineerd door autonome software.

Render Network verovert een aanzienlijk marktaandeel van gecentraliseerde GPU‑aanbieders. Creatieve professionals en AI‑onderzoekers gebruiken routinematig gedecentraliseerde compute voor productie‑workflows. De wereldwijde cloudgamingmarkt, die naar verwachting 121 miljard dollar zal bereiken in 2032, drijft de vraag naar gedistribueerde GPU‑infrastructuur.

In dit scenario verkrijgen utility‑tokens blijvende waarde door:

- Aanhoudende groe i n gebruik: Netwerkactiviteit stijgt onafhankelijk van speculatie

- Beperking van omloopsnelheid: Staking, burning en governance‑prikkels zorgen ervoor dat tokens worden aangehouden in plaats van direct verkocht

- Netwerkeffecten: Naarmate meer gebruikers toetreden, worden platforms waardevoller voor alle deelnemers

- Regulatoire duidelijkheid: Raamwerken ontstaan die gedecentraliseerde AI accommoderen en tegelijk consumenten beschermen

Tokenprijzen kunnen optimistische analistenprojecties bereiken – TAO boven $1.000, FET richting $6–10, RENDER boven $20 – als gebruiksfundamentals deze waarderingen rechtvaardigen. Market caps groeien evenredig, waarbij leidende AI‑utility‑tokens mogelijk waarderingen van 20–50 miljard dollar bereiken naarmate ze delen van de markten voor AI en cloudcomputing ter waarde van biljoenen dollars veroveren.

Voor beleggers betekent dit aanzienlijke waardestijging vanaf de huidige niveaus. Voor ontwikkelaars bevestigt het gedecentraliseerde infrastructuur als levensvatbaar alternatief voor gecentraliseerde cloudaanbieders. Voor cryptomarkten bewijst het dat utility‑tokens zich kunnen ontwikkelen van puur speculatieve activa tot functionele infrastructuurassets.

Ook interessant: Bitcoin daalt tot onder $67K nadat Trump dreigt Iran ‘naar het Stenen Tijdperk’ te bombarderen

Basisscenario: Selecte Tokens Slagen, Velen Vlakken Af

Een realistischer scenario erkent dat slechts een deel van de huidige AI‑utility‑tokens duurzame adoptie zal bereiken. Winnaars onderscheiden zich door superieure technologie, sterke ecosystemen, echte partnerschappen en effectieve mechanismen voor waarde‑captatie. De meeste projecten vlakken af of verdwijnen naarmate gebruikers de beperkte praktische utiliteit herkennen.

In dit scenario hebben Bittensor, Fetch.ai en Render – als leidende projecten – betere kansen dan kleinere concurrenten. Toch worden ook zij geconfronteerd met uitdagingen. Gedecentraliseerde AI blijkt waardevol voor specifieke niches—privacykritische toepassingen, censuurbestendige netwerken, bepaalde onderzoeksdomeinen—maar verdringt gecentraliseerde aanbieders niet voor de meeste use‑cases.

Store‑of‑value‑tokens blijven dominant. Bitcoin verstevigt zijn positie als digitaal goud. Ethereum blijft dienen als primaire settlement‑laag voor gedecentraliseerde applicaties. AI‑utility‑tokens bestaan naast deze activa als infrastructuur voor gespecialiseerde toepassingen in plaats van als general‑purpose platforms.

Tokenprijzen weerspiegelen bescheiden groe i in gebruik. TAO kan $500–800 bereiken, FET $2–4, RENDER $8–12 in de komende jaren – betekenisvolle waardestijging maar ver onder explosieve prognoses. Market caps groeien, maar blijven ordegroottes lager dan die van Bitcoin en Ethereum.

Diverse factoren kenmerken dit basisscenario:

- Niche‑adoptie: Utility‑tokens bedienen specifieke verticale markten of use‑cases effectief

- Gecentraliseerde concurrentie: AWS, Google Cloud en andere giganten behouden hun dominantie voor algemene compute

- Regulatoire overhead: Compliance‑vereisten voegen wrijving toe aan gedecentraliseerde platformen

- Technische afwegingen: Gedecentraliseerde systemen blijken langzamer, complexer of minder betrouwbaar dan gecentraliseerde alternatieven voor veel toepassingen.

Voor investeerders beloont een gematigde waardestijging vroege supporters, maar blijft deze achter bij de meest optimistische prognoses. Voor cryptomarkten vestigen utility-tokens legitimiteit als een activaklasse die zich onderscheidt van store-of-value-tokens, maar met gematigder waarderingen.

Negatief scenario: Gebruik blijft uit

In het pessimistische scenario slagen utility-tokens er niet in hun technische mogelijkheden te vertalen naar duurzame vraag. Ondanks indrukwekkende infrastructuur stappen gebruikers niet over van gevestigde platforms. Ontwikkelaars blijven TensorFlow, PyTorch en gecentraliseerde cloudcomputing gebruiken in plaats van nieuwe gedecentraliseerde protocollen te leren. Creatieve professionals blijven bij Adobe, Autodesk en traditionele renderfarms in plaats van te experimenteren met crypto-gestuurde alternatieven.

In dit scenario worden AI-utility-tokens in hoofdzaak speculatieve activa. Prijzen schommelen op basis van het algemene sentiment op de cryptomarkt en AI-hypecycli in plaats van fundamenteel gebruik. Wanneer de narratieven wegebben – zoals gebeurde bij veel ICO-tokens uit 2017-2018 – storten waarderingen in.

Meerdere dynamieken kunnen tot deze uitkomst leiden:

- Frictie in gebruikerservaring: Het beheren van wallets, betalen van gas fees en navigeren door gedecentraliseerde protocollen blijkt te omslachtig voor mainstreamgebruikers

- Prestatiekloof: Gecentraliseerde alternatieven blijven sneller, betrouwbaarder en rijker aan functies dan gedecentraliseerde opties

- Economische haalbaarheid: Tokenomics slagen er niet in de prikkels goed op elkaar af te stemmen, wat leidt tot verloop bij aanbieders, kwaliteitsproblemen of netwerkinstabiliteit

- Regulatoire repressie: Overheden classificeren utility-tokens als effecten of verbieden bepaalde toepassingen, waardoor legaal gebruik wordt beperkt

Tokenprijzen zouden terugvallen naar speculatieve dieptepunten. TAO zou onder $200 kunnen zakken, FET onder $0,50, RENDER onder $3, naarmate beleggers het gebrek aan fundamentele vraag herkennen. Projecten zouden kunnen overleven met toegewijde communities maar er niet in slagen betekenisvolle schaal te bereiken.

Dit scenario vormt een existentiële bedreiging voor de categorie utility-tokens. Als toonaangevende projecten met substantiële financiering, getalenteerde teams en echte partnerships geen product-market fit kunnen aantonen, suggereert dat dat het gedecentraliseerde AI-/compute-model fundamenteel niet werkt op schaal.

Also Read: Dogecoin Drops Below $0.089 On Bearish Signals

Gevolgen in de verschillende scenario’s

Voor investeerders: De risico-rendementsprofielen verschillen sterk per scenario. In het beste geval zijn er multibagger-rendementen, maar die vereisen dat meerdere onzekerheden gunstig uitpakken. Het basisscenario biedt een bescheiden waardestijging met lager risico. Het negatieve scenario betekent aanzienlijke verliezen.

Portefeuillebouw moet rekening houden met de waarschijnlijkheid van de scenario’s. Kleine percentages toewijzen aan utility-tokens biedt asymmetrische upside als het beste scenario uitkomt, terwijl de neerwaartse blootstelling beperkt blijft. Een concentratie in utility-tokens in plaats van store-of-value-activa vergroot volatiliteit en risico.

Voor ontwikkelaars: Bouwen op utility-tokenplatforms vereist een beoordeling van de langetermijnlevensvatbaarheid. Als het basis- of het negatieve scenario uitkomt, kunnen applicaties die op deze platforms zijn gebouwd moeite hebben om gebruikers of financiering te vinden. Ontwikkelaars zouden hun opties open moeten houden—applicaties zo ontwerpen dat ze overdraagbaar zijn tussen platforms of kunnen draaien op gecentraliseerde backends als gedecentraliseerde infrastructuur onvoldoende blijkt.

Voor de structuur van de cryptomarkt: Het succes of falen van utility-tokens bepaalt de verdere evolutie van crypto. Als het beste scenario zich ontvouwt, breidt crypto zich uit voorbij store-of-value en DeFi naar echte infrastructuur. Als het negatieve scenario zich voltrekt, blijft crypto in hoofdzaak een speculatief en financieel domein.

Waarop te letten

Verschillende indicatoren zullen verduidelijken welk scenario zich ontvouwt:

Aantal nodes en participatie: Groeiende aantallen miners, validators en GPU-aanbieders duiden op echte netwerkeffecten. Stagnerende of dalende participatie suggereert een gebrek aan economische haalbaarheid.

Verwerkte compute-jobs: Werkelijke renderingjobs, AI-trainingsruns en agentinteracties – niet alleen testnetactiviteit – tonen echte vraag aan. Projecten zouden transparante gebruiksstatistieken moeten publiceren.

Enterprise-partnerships: Het omzetten van aangekondigde partnerships in meetbaar transactievolume valideert businessmodellen. Partnerships zonder bijbehorend gebruik duiden op mogelijk luchtfietserij.

Token burns en staking: Voor projecten met burnmechanismen wijst een burnrate die hoger ligt dan de mint-rate op sterke vraag. Hoge stakingparticipatie verlaagt de omloopsnelheid en toont vertrouwen van langetermijnhouders.

Ontwikkelaarsactiviteit: Groeiende ontwikkelaarsecosystemen – gemeten aan GitHub-commits, nieuwe protocollen die op platforms worden gebouwd, deelname aan hackathons – duiden op gezonde fundamenten. Afnemende interesse van ontwikkelaars voorspelt stagnatie.

Regulatoire duidelijkheid: Duidelijkere kaders rond utility-tokens, AI-systemen en gedecentraliseerde infrastructuur verminderen onzekerheid. Gunstige regelgeving versnelt adoptie; restrictieve regelgeving remt die af.

Hardware-ecosystemen: Integratie met grote GPU-fabrikanten of cloudproviders legitimeert gedecentraliseerde compute. Partnerschappen of erkenning van Nvidia, AMD en anderen met utility-tokenplatforms zouden op mainstreamvalidatie wijzen.

Door deze metrics tussen 2025 en 2027 te volgen, wordt duidelijker of AI-utility-tokens echte infrastructuurinnovatie vertegenwoordigen of voornamelijk speculatieve vehikels zijn. Dat onderscheid bepaalt of deze activa blijvende betekenis krijgen op de cryptomarkten of vervagen als weer een voorbijgaande narratiefcyclus.

Slotgedachten

AI-utility-tokens vormen een betekenisvolle evolutie in het architecturale narratief van crypto. Bittensor, Fetch.ai en Render Network laten zien dat tokens andere doelen kunnen dienen dan store-of-value of speculatieve handel – ze kunnen gedecentraliseerde infrastructuur coördineren, computationeel werk stimuleren en machine-to-machine-economieën mogelijk maken.

De fundamentele these is overtuigend.

Gedecentraliseerde GPU-netwerken bundelen onderbenutte middelen, verlagen kosten en democratiseren toegang. Autonome agents maken coördinatie mogelijk op schalen die onpraktisch zijn voor menselijke tussenkomst.

Collaboratieve AI-ontwikkeling verspreidt de creatie van intelligentie voorbij de monopolies van techgiganten. Deze visies pakken reële problemen aan op het gebied van infrastructuurschaalbaarheid, AI-toegankelijkheid en economische coördinatie.

Maar het vertalen van visie naar duurzame adoptie blijft de cruciale uitdaging. Utility-tokens moeten duidelijke voordelen aantonen ten opzichte van gecentraliseerde alternatieven en tegelijk de frictie overwinnen die inherent is aan gedecentraliseerde systemen. Ze moeten waarde vangen via gebruik in plaats van via speculatie, het snelheidsprobleem van tokens oplossen via effectieve tokenomics, en product-market fit bereiken bij ondernemingen en ontwikkelaars.

Read Next: XRP Ledger Hits Record 4.49M Transactions Amid Price Decline