Vergiss Memecoins und Hype-Zyklen – KI-Utility-Token sind eine neue Art von Krypto, die Wellen schlagen, und dieses Mal tun sie tatsächlich etwas.

Sie bauen leise die Brücke zwischen Blockchain und der gewaltigen Recheninfrastruktur, die künstliche Intelligenz antreibt. Und während KI in alles vordringt – vom Schreiben von Skripten bis zum Entwurf von Molekülen – entwickeln sich diese Token parallel dazu weiter: weg von spekulativen Jetons auf einem Casinotisch hin zu echten Werkzeugen, die dezentrale Netzwerke am Laufen halten.

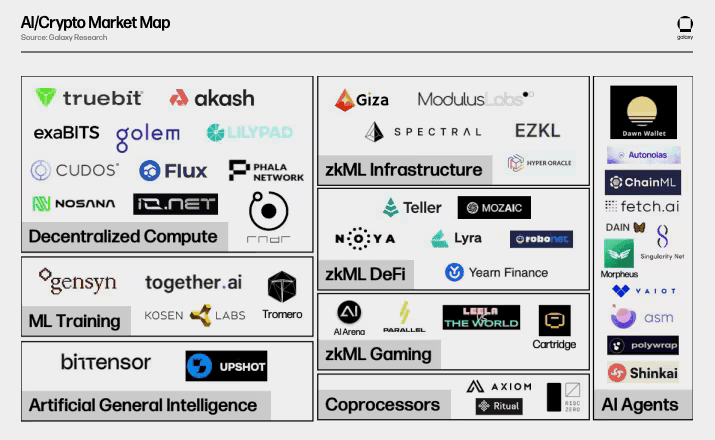

Drei Projekte stehen an der Spitze dieses Wandels: Bittensor (TAO), Fetch.ai (FET) und Render Token (RNDR).

Bittensor operates a decentralized machine learning network, in dem Mitwirkende KI-Modelle gemeinsam trainieren und Belohnungen verdienen. Fetch.ai setzt autonome ökonomische Agenten ein, die Aufgaben in Lieferketten, Energiemärkten und dezentralen Finanzanwendungen ausführen. Render Network verwandelt ungenutzte GPU-Leistung in einen peer-to-peer marketplace für 3D-Rendering, visuelle Effekte und KI-Inferenz.

Diese Token stehen für mehr als nur inkrementelle Innovation.

Sie signalisieren einen möglichen Architekturwandel in Krypto – weg von „digitalem Gold“, das auf Knappheit und Wertspeicher-Eigenschaften basiert, hin zu nutzungsgetriebenen Ökosystemen, in denen Token tatsächliche Rechenarbeit ermöglichen.

Während Bitcoin (BTC) und Ethereum (ETH) sich über monetäre und Plattform-Narrative etabliert haben, schlagen KI-Utility-Token eine andere Wertthese vor: Token als Zugangsschlüssel zu dezentraler Infrastruktur, Zahlungsbahnen für Maschinen-zu-Maschinen-Ökonomien und Belohnungsmechanismen für Rechenressourcen.

Hier beleuchten wir, warum diese Token gerade jetzt im Trend liegen, analysieren ihre Nutzungsmodelle und Tokenomics, bewerten die Wettbewerbssituation und Narrative-Risiken, untersuchen Bewertungsrahmen und betrachten die weiter gefassten Implikationen dafür, wie sich Utility-Token im Vergleich zu etablierten Wertspeicher-Assets entwickeln könnten.

Warum Utility-Token – und warum jetzt

Die Konvergenz von KI-Beschleunigung und Blockchain-Infrastruktur hat Bedingungen geschaffen, die reif für die Einführung von Utility-Token sind. Mehrere Makrotreiber erklären die aktuelle Dynamik.

Erstens ist die Nachfrage nach KI-Rechenleistung explodiert.

Das Training fortgeschrittener Sprachmodelle und die Erzeugung synthetischer Medien erfordern enorme GPU-Ressourcen, was zu Engpässen in zentralisierten Cloud-Infrastrukturen führt. Traditionelle Anbieter wie AWS und Google Cloud haben Schwierigkeiten, die Nachfrage zu decken; Rechenzentren erreichen im Schnitt nur 12–18 % Auslastung, während GPU-Knappheit anhält. Dieses Missverhältnis von Angebot und Nachfrage hat die Kosten für Rechenleistung erhöht und macht dezentrale Alternativen wirtschaftlich attraktiv.

Zweitens konzentrierten sich frühere Kryptozyklen vor allem auf DeFi-Protokolle und Wertspeicher-Narrative. Doch bis 2024–2025 sind infrastructure and compute emerged zu einem dominanten Thema geworden.

The total crypto market cap crossed $4 trillion in 2025, and within that growth, AI-crypto projects captured significant investor attention.

Projekte, die greifbare Infrastruktur statt rein finanzieller Produkte bieten, gewannen an Zugkraft, als der Markt reifer wurde.

Drittens bietet die Tokenisierung einzigartige Vorteile bei der Koordination verteilter Ressourcen.

Dezentrale GPU-Netzwerke wie Render können ungenutzte Rechenleistung weltweit bündeln und so cost savings of up to 90% gegenüber zentralisierten Alternativen ermöglichen. Token bilden dabei die ökonomische Koordinationsebene: Creator zahlen für Rendering-Dienste in RNDR, Node-Betreiber erhalten Belohnungen für die Bereitstellung von GPU-Kapazität, und das Protokoll sorgt über Blockchain-Transaktionen für Transparenz.

Das Nutzungsmodell unterscheidet sich deutlich von Wertspeicher-Token. Bitcoins Wertversprechen basiert auf fixed supply scarcity und seiner Positionierung als digitales Gold. Ethereum fügt Programmierbarkeit hinzu, bezieht aber weiterhin einen Großteil seines Werts aus seiner Rolle als Settlement-Layer und Basis für Vermögenswerte. Utility-Token wie TAO, FET und RNDR beziehen ihren Wert dagegen aus der Netzwerknutzung: Mehr KI-Modelle, die auf Bittensor trainiert werden, mehr autonome Agenten auf Fetch.ai, mehr Rendering-Aufträge auf Render Network bedeuten theoretisch eine höhere Token-Nachfrage.

Diese Hinwendung zur Utility ist nicht bloß ein Narrativ. Render Network processes rendering jobs für große Studios über dezentrale Nodes. Fetch.ai hat reale Anwendungen demonstriert, darunter autonomous parking coordination in Cambridge und Energiemärkte. Bittensors Subnetz-Architektur umfasst inzwischen 128 active subnets, die sich auf verschiedene KI-Domänen konzentrieren, von Textgenerierung bis Protein-Faltung.

Dennoch steht die Utility-Adoption vor Herausforderungen. Die meisten Token werden immer noch hauptsächlich auf spekulativer Basis gehandelt statt auf Nutzungsfundamenten. Die Token-Velocity – also wie schnell Token den Besitzer wechseln – kann die Preisstabilität untergraben, wenn Nutzer Belohnungen sofort in andere Assets tauschen. Die zentrale Frage ist, ob diese Protokolle genügend Nutzung generieren können, um ihre Bewertungen zu stützen, oder ob sie narrativegetriebene Assets bleiben, die Hype-Zyklen ausgesetzt sind.

Auch interessant: Bitcoin Decentralization Faces A Problem: Mining Power Tied To Just Three Nations

Token 1: Bittensor (TAO) im Detail

Was Bittensor ist

Bittensor is an open-source protocol, das ein dezentrales Machine-Learning-Netzwerk betreibt. Anders als traditionelle KI-Entwicklung, die in den Laboren großer Tech-Konzerne konzentriert ist, schafft Bittensor einen Peer-to-Peer-Marktplatz, auf dem Entwickler Machine-Learning-Modelle beisteuern, Validatoren deren Qualität bewerten und Mitwirkende Belohnungen entsprechend dem Informationswert erhalten, den sie zur kollektiven Intelligenz beitragen.

Das Protokoll wurde von founded by Jacob Steeves and Ala Shaabana, Informatikforschern, ins Leben gerufen, um die KI-Entwicklung zu demokratisieren. Die Vision ist ambitioniert: einen Markt für künstliche Intelligenz zu schaffen, in dem Produzenten und Konsumenten in einem vertrauenslosen, transparenten Umfeld ohne zentrale Gatekeeper interagieren.

Utility und Funktionsweise

Der TAO-Token erfüllt mehrere Funktionen im Ökosystem. Am grundlegendsten TAO grants access to the network's collective intelligence. Nutzer rufen Informationen aus trainierten Modellen ab, indem sie mit TAO bezahlen, während Mitwirkende, die dem Netzwerk Wert hinzufügen, mehr Stake verdienen. So entsteht ein Anreizsystem, in dem hochwertige Modellbeiträge höhere Belohnungen erhalten.

Das Netzwerk arbeitet mit einer Subnetz-Architektur. Each subnet specializes in different AI tasks – Natural Language Processing, Bilderkennung, Datenvorhersage – und verwendet eine eigene Bewertungslogik. Modelle konkurrieren innerhalb der Subnetze anhand von Genauigkeit und Effizienz. Validatoren staken TAO, um Modellausgaben zu bewerten und eine faire Bepunktung sicherzustellen. Nominatoren unterstützen bestimmte Validatoren oder Subnetze und teilen sich die Rewards, ähnlich wie in Delegated-Proof-of-Stake-Systemen.

Dieses modulare Design ermöglicht es Bittensor, gleichzeitig über zahlreiche KI-Domänen zu skalieren. Anstatt eines monolithischen Netzwerks fungiert das Protokoll als Infrastruktur für spezialisierte KI-Marktplätze, jeweils mit eigenen Bewertungskriterien und Belohnungsverteilungen.

Tokenomics

Bittensors Tokenomics spiegeln Bitcoins Knappheitsmodell wider. TAO has a fixed supply of 21 million tokens, mit einer Emission nach Halving-Zeitplan. Das first halving occurred in 2025, wodurch die tägliche Emission von 7.200 auf 3.600 Token sank. Dieser deflationäre Mechanismus schafft eine Angebotsknappheit ähnlich den Vierjahreszyklen von Bitcoin.

Aktuell sind approximately 9.6 million TAO tokens are in circulation, was rund 46 % des Gesamtangebots entspricht. Die circulating supply will continue growing, jedoch aufgrund der Halvings mit abnehmender Geschwindigkeit; die vollständige Verteilung wird sich über mehrere Jahrzehnte erstrecken.

Mining-Rewards fließen an Mitwirkende, die die Intelligenz des Netzwerks nachweislich verbessern. Validatoren verdienen Belohnungen für die genaue Bewertung von Modellbeiträgen. Diese doppelte Belohnungsstruktur schafft Anreize sowohl für die Modellentwicklung als auch für die Netzwerkintegrität.

Anwendungsfälle

Bittensors Anwendungsbereiche sind vielfältig. Collective learning ermöglicht es Gesundheitseinrichtungen, Modelle auf sensiblen medizinischen Daten zu trainieren, ohne die zugrunde liegenden Informationen zu teilen – demonstriert etwa bei der COVID-19-Erkennung auf Röntgenaufnahmen des Brustkorbs mit 90 % Genauigkeit. Finanzinstitute können gemeinsam Betrugserkennungsmodelle trainieren, während proprietäre Daten privat bleiben.

Die Subnetz-Struktur ermöglicht spezialisierte KI-Dienste. Textgenerierungs-Subnetze konkurrieren um besonders hochwertige Sprachoutputs. Vorhersagemärkte nutzen Bittensors Inferenzfähigkeiten. Embedding-Services verarbeiten und kodieren Daten für nachgelagerte Anwendungen. Jedes Subnetz arbeitet autonom und trägt gleichzeitig zu der breiteren Intelligence-Marktplatz.

Die Einführung in Unternehmen steckt noch in den Anfängen, wächst jedoch. Deutsche Digital Assets und Safello brachten im November 2025 das weltweit erste physisch gedeckte Bittensor-ETP an der SIX Swiss Exchange auf den Markt und verschaffen institutionellen Anlegern damit einen regulierten Zugang zu TAO. Diese Entwicklung signalisiert ein reiferes Interesse über die reine Privatspekulation hinaus.

Wettbewerb und Ökosystem

Bittensor konkurriert im dezentralen KI‑Bereich mit Projekten wie SingularityNET (AGIX) und Ocean Protocol (OCEAN). SingularityNET betreibt einen KI‑Marktplatz, auf dem Entwickler Algorithmen und Services monetarisieren. Ocean konzentriert sich auf Daten‑Marktplätze und Compute‑to‑Data‑Anwendungen. Jedes Projekt verfolgt einen anderen Ansatz für dezentrale KI – Bittensor betont kollaboratives Modell‑Training, SingularityNET fokussiert sich auf Service‑Marktplätze, Ocean priorisiert Daten‑Assets.

Die größte Wettbewerbsbedrohung geht jedoch von zentralisierten KI‑Giganten aus. OpenAI, Google DeepMind und Anthropic verfügen über enorme Ressourcen, proprietäre Datensätze und Spitzen‑Talente. Diese Akteure können schneller iterieren und leistungsfähigere Modelle bereitstellen, als es dezentrale Alternativen derzeit erreichen. Bittensor muss zeigen, dass der kollaborative Ansatz Modelle hervorbringt, die mit zentralisierten Alternativen konkurrieren können – nicht nur philosophisch attraktiv, sondern für bestimmte Anwendungsfälle technisch überlegen.

Das WASM‑Smart‑Contract‑Upgrade (WebAssembly) des Netzwerks im Jahr 2025 erweiterte die Funktionalität und ermöglichte Features wie Lending, automatisierten Handel von Subnetz‑Token und Cross‑Subnet‑Anwendungen. Diese Infrastrukturentwicklung zielt darauf ab, eine umfassendere digitale Ökonomie jenseits reinen Modell‑Trainings zu schaffen.

Narrativrisiko und Bewertung

Die Bewertung von Bittensor steht vor mehreren Spannungsfeldern. Am 12. November 2025 handelte TAO bei rund 362–390 US‑Dollar, mit einer Marktkapitalisierung von etwa 3,7–4,1 Milliarden US‑Dollar. Der Token erreichte Anfang 2025 Höchststände von über 400 US‑Dollar, zeigte aber eine für Krypto‑Assets typische Volatilität.

Bullen verweisen auf mehrere Wachstumstreiber.

Der Halving‑Mechanismus erzeugt deflationären Druck und kann bei stabiler Nachfrage eine Preissteigerung unterstützen. Analysten prognostizieren Kursziele von 360–500 US‑Dollar im Jahr 2026 bis hin zu aggressiveren Einschätzungen von über 1.000 US‑Dollar für 2027–2030, wobei diese Vorhersagen mit erheblicher Unsicherheit behaftet sind.

Die grundlegende Frage lautet, ob die Netzwerknutzung die Bewertung rechtfertigt.

Die Token‑Velocity‑Theorie besagt, dass Utility‑Token, die primär für Transaktionen verwendet werden, Schwierigkeiten haben, ihren Wert zu halten, da Nutzer erhaltene Rewards schnell in andere Assets umwandeln.

Bittensor begegnet dem durch Staking – Validatoren müssen TAO sperren, um am Netzwerkkonsens teilzunehmen, was das zirkulierende Angebot und die Umlaufgeschwindigkeit reduziert.

Falls es Bittensor jedoch nicht gelingt, über die aktuelle Subnetz‑Aktivität hinaus relevante KI‑Workloads anzuziehen, bleibt der Token vor allem spekulativ. Das Protokoll muss zeigen, dass dezentrales Modell‑Training Vorteile bietet, die stark genug sind, um Entwickler von etablierten Frameworks wie TensorFlow oder PyTorch in Kombination mit zentralisierter Rechenleistung wegzulocken.

Risiken umfassen den technologischen Wettbewerb, regulatorische Unsicherheiten rund um KI‑Systeme, potenzielle Sicherheitslücken im Protokoll und die Herausforderung, bei wachsendem Netzwerk die Dezentralisierung zu wahren. Der jüngste wöchentliche Rückgang um 20 % verdeutlicht die anhaltende Volatilität, selbst während das institutionelle Interesse zunimmt.

Token 2: Fetch.ai (FET) – Detaillierte Analyse

Was Fetch.ai ist

Fetch.ai ist ein Blockchain‑Ökosystem, das KI und Automatisierung nutzt, um autonome ökonomische Agenten zu ermöglichen – digitale Entitäten, die eigenständig Aufgaben für Nutzer, Geräte oder Organisationen ausführen.

Gegründet 2017 und im März 2019 per IEO auf Binance gestartet, verfolgt Fetch.ai das Ziel, den Zugang zu KI‑Technologie über ein dezentrales Netzwerk zu demokratisieren.

Das definierende Merkmal der Plattform sind Autonomous Economic Agents (AEAs).

Dabei handelt es sich um Software‑Entitäten, die mit einem gewissen Grad an Autonomie agieren und Aufgaben wie die Optimierung von Lieferketten, das Management von Smart‑Grid‑Energieverteilung, die Koordination von Verkehrsnetzen und die Automatisierung von DeFi‑Handel ausführen. Agenten entdecken und verhandeln miteinander über ein Open Economic Framework und schaffen so eine Maschine‑zu‑Maschine‑Ökonomie.

CEO Humayun Sheikh führt ein Team, das sich eine Zukunft vorstellt, in der KI‑basierte Systeme das Datenmonopol großer Tech‑Konzerne aufbrechen. Durch die Verteilung von KI‑Fähigkeiten über ein dezentrales Netzwerk positioniert sich Fetch.ai als Infrastruktur für die „agentische Ökonomie“ – eine Zukunft, in der autonome Agenten Individuen und Geräte in unzähligen Mikrotransaktionen und Koordinationsaufgaben vertreten.

Nutzen von FET

Der FET‑Token dient als primäres Tauschmittel im Fetch.ai‑Ökosystem.

Wenn zwei Agenten sich verbinden, kommunizieren und verhandeln, bezahlt einer den anderen für Daten oder Services mit FET. Wichtig ist, dass der Token Mikrozahlungen im Bereich von Bruchteilen eines Cents unterstützt und damit die feingranularen Transaktionen ermöglicht, die eine Maschine‑zu‑Maschine‑Ökonomie erfordert.

FET erfüllt mehrere spezifische Funktionen. Er bezahlt Transaktionsgebühren im Netzwerk sowie die Bereitstellung von KI‑Services. Entwickler, die autonome Agenten bauen, zahlen in FET, um Zugriff auf die Machine‑Learning‑Utilities und Rechenressourcen des Netzwerks zu erhalten. Nutzer können FET staken, um an der Netzwerksicherheit teilzunehmen über den Proof‑of‑Stake‑Konsens von Fetch.ai und erhalten Rewards für ihren Beitrag als Validator‑Nodes.

Agenten müssen zudem FET hinterlegen, um sich im Netzwerk zu registrieren, wodurch eine Staking‑Anforderung entsteht, die ihr Nutzungsrecht finanziert. Dieser Einzahlungsmechanismus stellt sicher, dass Agenten ökonomische „Skin in the Game“ haben, Spam reduziert wird und qualitativ hochwertige Beiträge gefördert werden.

Tokenomics und Struktur

FET existiert in mehreren Formen auf verschiedenen Blockchains. Ursprünglich als ERC‑20‑Token auf Ethereum gestartet, hat Fetch.ai später sein eigenes Mainnet im Cosmos‑Ökosystem eingeführt. Nutzer können zwischen der nativen Version und dem ERC‑20‑Format hin‑ und herwechseln, wobei die Wahl sich auf Transaktionsgebühren und die Kompatibilität mit verschiedenen DeFi‑Ökosystemen auswirkt.

Das Maximalangebot liegt bei rund 1 Milliarde FET‑Token, wobei sich die genaue Verteilung und die Vesting‑Pläne unterscheiden.

Der Token läuft sowohl auf Ethereum (für ERC‑20‑Kompatibilität) als auch auf der Binance Smart Chain (als BEP‑20‑Token), mit einer 1:1‑Token‑Bridge, die es Nutzern ermöglicht, je nach Bedarf zwischen den Netzwerken zu wechseln.

Fetch.ai ist Teil der Artificial Superintelligence Alliance, einer 2024 angekündigten Kooperation mit SingularityNET und Ocean Protocol. Die Allianz zielt darauf ab, ein einheitliches dezentrales KI‑Ökosystem zu schaffen, dessen kombinierte Marktkapitalisierung einen Platz unter den Top‑20‑Kryptowährungen erreichen soll.

Token‑Inhaber von AGIX und OCEAN können in FET tauschen, wodurch Liquidität und Entwicklungsaufwand potenziell über die Projekte hinweg gebündelt werden.

Anwendungsfälle

Die Anwendungen von Fetch.ai erstrecken sich über mehrere Sektoren. In Smart Cities koordinieren Agenten Parkraum und Verkehr. Ein Pilotprojekt in Cambridge zeigte, wie Agenten autonom Parkplätze finden, auf Stellplätze bieten und Zahlungen in Echtzeit abwickeln. Durch die Einbindung von Ride‑Hailing kann das Netzwerk Fahrzeuge basierend auf Nachfrageprofilen disponieren.

Energiemärkte stellen einen weiteren wichtigen Anwendungsfall dar.

Hausbesitzer mit Photovoltaik auf dem Dach setzen Agenten ein, die Überschussenergie direkt mit Nachbarn handeln und zentrale Versorger umgehen. Agenten verhandeln Preise, verifizieren Transaktionen und wickeln Zahlungen in FET ab, wodurch ein Peer‑to‑Peer‑Energiemarkt entsteht.

In Logistik und Lieferketten optimieren Agenten Routenführung, Bestandsmanagement und die Auswahl von Dienstleistern.

Ein Unternehmen kann einen Agenten einsetzen, der über das Netzwerk Lieferanten entdeckt, Konditionen verhandelt, Preise vergleicht, Qualitätsbewertungen prüft, Bestellungen aufgibt, den Versand organisiert und Zahlungen abwickelt – alles autonom auf Basis vordefinierter Parameter.

DeFi‑Automatisierung zeigt ebenfalls Potenzial. Agenten können komplexe Handelsstrategien ausführen, Liquiditätsbereitstellung über Protokolle hinweg optimieren und Sicherheitenpositionen in Kreditmärkten managen. Mitte 2025 gewann ein von Fetch.ai unterstützter Agent den UC‑Berkeley‑Hackathon zur Koordination des Luftverkehrs und demonstrierte Fähigkeiten bei der Zuteilung von Flugslots, dem Management von Verspätungen und der Aushandlung von Stauzonen zwischen autonomen Agenten, die mit Live‑Daten arbeiten.

Die Partnerschaft mit Interactive Strength (TRNR) schuf intelligente Fitness‑Coach‑Agenten, die Leistungsdaten analysieren, personalisierte Empfehlungen gebenworkouts und verhandeln Trainingspläne mit Nutzern – alles über FET-Zahlungen abgewickelt.

Wettbewerbslandschaft und Risiken

Fetch.ai konkurriert mit anderen agentenfokussierten Protokollen wie Autonolas (OLAS), das ein Accelerator-Programm für autonome Agenten anbietet. Virtuals Protocol trat Ende 2024 als wichtiger Konkurrent auf und baut ein AI-Agent-Launchpad auf Base und Solana mit einem eigenen Ökosystem tokenisierter Agenten auf.

Die größere Wettbewerbsbedrohung geht von zentralisierten KI-Plattformen aus.

Google, Amazon und Microsoft bieten fortgeschrittene KI-Dienste über ihre Cloud-Plattformen an, ohne dass Nutzer proprietäre Token halten müssen.

Damit Fetch.ai erfolgreich ist, muss das Modell der dezentralen Agenten klare Vorteile bieten – Wahrung der Privatsphäre, Zensurresistenz, direkte Peer-to-Peer-Koordination –, die die Komplexität des Umgangs mit Krypto-Assets rechtfertigen.

Regulatorische Unsicherheit birgt Risiken. Autonom agierende KI-Systeme könnten unter neuen Regulierungen verstärkt geprüft werden. Der risikobasierte Ansatz des EU AI Act könnte die Agenten von Fetch.ai als „Hochrisiko“ einstufen, wenn sie in Sektoren wie Energie oder Logistik eingesetzt werden, was Prüfungen und Aufsichten erfordert, die die Betriebskosten erhöhen.

Skepsis gegenüber dem Narrativ der Agentenökonomie hält an.

Kritiker bezweifeln, dass autonome Agenten den Massenmarkt erreichen, und vermuten, dass sie eine technische Nischenkuriosität bleiben. Sollte sich die Machine-to-Machine-Ökonomie nicht in großem Maßstab materialisieren, wird FET zu einer Lösung, die ein Problem sucht.

Am 12. November 2025 wurde FET bei etwa 0,25–0,30 US-Dollar gehandelt, nachdem der Token im Jahresverlauf erheblicher Volatilität ausgesetzt war. Der Token rückte in den Fokus, als Interactive Strength Pläne für eine Krypto-Treasury in Höhe von 500 Mio. US-Dollar ankündigte, die sich auf FET konzentriert, was institutionelles Vertrauen in das langfristige Potenzial des Projekts signalisiert.

Analysten prognostizieren Kursziele von 6,71 US-Dollar bis 2030, wobei solche Vorhersagen mit erheblicher Unsicherheit behaftet sind. Die grundlegende Frage lautet, ob agentenbasierte Koordination genügend Mehrwert bietet, um die Token-Ökonomie zu rechtfertigen, oder ob einfachere zentrale Alternativen die Oberhand gewinnen.

Jüngste Entwicklungen sind vielversprechend. Fetch.ai startete Anfang 2025 einen Accelerator über 10 Mio. US-Dollar, um in Start-ups zu investieren, die auf seiner Infrastruktur aufbauen. Dies signalisiert ein Engagement für Ökosystemwachstum über spekulativen Handel hinaus.

Token 3: Render Token (RNDR) Deep Dive

Was das Render Network ist

Render Network ist eine dezentrale GPU-Rendering-Plattform, die Kreative, die Rechenleistung benötigen, mit Einzelpersonen und Organisationen verbindet, die ungenutzte GPU-Ressourcen anbieten. Ursprünglich 2009 vom OTOY-CEO Jules Urbach konzipiert und im April 2020 öffentlich gestartet, hat sich Render zu einem führenden dezentralen physischen Infrastrukturnetzwerk (DePIN) für Grafik- und KI-Workloads entwickelt.

Das Netzwerk arbeitet als Peer-to-Peer-Marktplatz. Kreative reichen Rendering-Aufträge – 3D-Grafiken, visuelle Effekte, Architekturvisualisierungen, KI-Inferenz – ins Netzwerk ein.

Node-Betreiber mit freier GPU-Kapazität nehmen Aufträge an und verarbeiten sie im Austausch gegen RNDR-Token. Die Plattform nutzt OTOYs branchenführende OctaneRender-Software und bietet professionelle Rendering-Funktionen über eine verteilte Infrastruktur.

Render Network adressiert einen grundlegenden Engpass: Hochwertiges Rendering erfordert enorme GPU-Leistung, doch zentralisierte Cloud-Dienste sind teuer und können in Spitzenzeiten Kapazitätsengpässe haben. Durch die Bündelung unterausgelasteter GPUs weltweit demokratisiert Render den Zugang zu professionellen Rendering-Tools zu einem Bruchteil der herkömmlichen Kosten.

Utility-Token RNDR

Der RNDR-Token (nach der Migration zu Solana nun RENDER) dient als nativer Utility-Token des Netzwerks. Kreative bezahlen Rendering-Dienste in RENDER, wobei die Kosten durch die benötigte GPU-Leistung bestimmt werden, gemessen in OctaneBench (OBH) – einer von OTOY entwickelten standardisierten Einheit zur Quantifizierung der Rendering-Kapazität.

Node-Betreiber verdienen RENDER für abgeschlossene Aufträge.

Das Netzwerk implementiert ein gestuftes Reputationssystem: Tier 1 (Trusted Partners), Tier 2 (Priority) und Tier 3 (Economy). Node-Betreiber höherer Stufen verlangen Premiumpreise, bieten aber garantierte Zuverlässigkeit. Die Reputation von Kreativen beeinflusst die Geschwindigkeit der Auftragszuweisung – wer eine starke Historie aufweist, erhält schneller Zugang zu Ressourcen.

Mit RENDER-Token sind Governance-Rechte verbunden. Inhaber stimmen über Netzwerk-Upgrades, Protokolländerungen und Finanzierungsanträge über die Render DAO ab. Diese dezentrale Governance stellt sicher, dass die Community – und nicht nur eine zentrale Stiftung – die Entwicklung des Netzwerks prägt.

Der im Januar 2023 eingeführte Burn-and-Mint-Equilibrium-Mechanismus steuert das Tokenangebot dynamisch. Wenn Kreative für Rendering zahlen, werden 95 % der Token verbrannt und damit aus dem Umlauf genommen. Node-Betreiber erhalten neu gemintete Token, um das wirtschaftliche Gleichgewicht zu wahren. Dieses Design macht RENDER potenziell deflationär, wenn die Netzwerknutzung wächst, da die Verbrennungsrate bei starker Nachfrage die Präge-Rate übersteigen kann.

Tokenomics

RENDER migrierte Ende 2023 nach einer Community-Abstimmung von Ethereum zu Solana. Dieser Schritt sollte Solanas schnellere Transaktionen und geringere Gebühren nutzen. Der ursprüngliche RNDR-Token (ERC-20) auf Ethereum wurde auf RENDER (SPL-Token) auf Solana aufgerüstet. Das Gesamtangebot ist auf 644.168.762 Token begrenzt, mit etwa 517 Millionen im Umlauf (Stand 2025).

Die Tokenverteilung sah 25 % für öffentliche Verkäufe, 10 % für Reserven und 65 % in Escrow vor, um Angebots-Nachfrage-Ströme zu steuern. Diese Reserve ermöglicht es der Stiftung, die Tokenverfügbarkeit zu managen, während das Netzwerk skaliert.

Anwendungsfälle

Render Network bedient mehrere Branchen. Film- und TV-Produktionsfirmen nutzen das Netzwerk für das Rendering visueller Effekte. Große Studios haben Projekte über dezentrale Nodes gerendert, was die Eignung des Systems für professionelle Workflows demonstriert; Ende-zu-Ende-Verschlüsselung schützt dabei geistiges Eigentum.

Spieleentwickler nutzen Render für 3D-Asset-Erstellung und Echtzeit-Rendering.

Metaverse-Projekte sind auf das Netzwerk angewiesen, um immersive Umgebungen und Avatar-Grafiken zu erzeugen. Die Skalierbarkeit verteilter GPU-Leistung ermöglicht es Kreativen, Rendering-Kapazitäten nach Bedarf hochzufahren, ohne in teure lokale Hardware investieren zu müssen.

Architekten und Produktdesigner setzen Render für hochwertige 3D-Visualisierungen ein. Architekturbüros erstellen VR-Begehungen von Gebäuden vor dem Bau. Produktdesigner können in großem Maßstab Prototypen anfertigen und Texturen sowie Farben durch parallelisiertes GPU-Rendering testen.

KI-Inferenz stellt einen wachsenden Anwendungsfall dar.

Im Juli 2025 integrierte Render NVIDIA-RTX-5090-GPUs speziell für KI-Compute-Workloads in den USA. Das Training bestimmter KI-Modelle, insbesondere im Bereich Bild- oder Videogenerierung, profitiert von verteilter GPU-Leistung. Die Infrastruktur des Netzwerks kann das KI-Training deutlich beschleunigen im Vergleich zu Einzelmaschinen-Setups.

Wettbewerbsdynamik

Render konkurriert mit zentralisierten wie dezentralisierten Anbietern. Traditionelle GPU-Cloud-Services von AWS, Google Cloud und spezialisierten Anbietern wie CoreWeave bieten benutzerfreundliche Oberflächen und zuverlässige SLAs, verlangen jedoch Premiumpreise und können in Spitzenzeiten begrenzte Kapazitäten haben.

Im dezentralen Bereich zählen Akash Network (AKT), io.net (IO) und Aethir zu den Wettbewerbern. Jede Plattform verfolgt einen anderen Ansatz bei der Koordination von GPU-Marktplätzen – Akash fokussiert sich auf breitere Cloud-Infrastruktur, io.net betont KI/ML-Workloads, Aethir zielt auf Gaming und Entertainment. Render differenziert sich durch die Integration mit OTOYs professioneller Rendering-Software und seinen etablierten Ruf unter Kreativprofis.

Die Frage der Wertabschöpfung bleibt bestehen. GPU-Rechenleistung wird zunehmend zur Ware, da immer mehr Anbieter auf den Markt drängen.

Render muss zeigen, dass sein dezentrales Modell klare Vorteile bietet – Kosteneffizienz, weltweite Verfügbarkeit, Zensurresistenz –, die die Nutzung von Krypto-Token gegenüber Kreditkartenzahlungen bei zentralisierten Anbietern rechtfertigen.

Partnerschaften mit großen Unternehmen liefern Validierung. Ari Emanuel (Co-CEO von Endeavor) hat das Render Network öffentlich unterstützt und Verträge mit Disney, HBO, Facebook und Unity unterzeichnet. Diese Partnerschaften signalisieren eine Anerkennung im Mainstream, doch bleibt die Herausforderung, diese Beziehungen in eine konsistente Netzwerknutzung zu überführen.die Herausforderung.

Am 12. November 2025 wurde RENDER bei etwa 4,50–5,00 $ gehandelt, mit einer Marktkapitalisierung von rund 2,5–3 Milliarden $. Der Token verzeichnete signifikantes Wachstum im Jahr 2024 und stieg bis Anfang 2024 um über 13.300 % gegenüber seinem Anfangspreis, konsolidierte sich jedoch anschließend. Analysten führen dies auf KI- und GPU/NVIDIA-Narrative zurück, wobei die Apple-Partnerschaft zusätzliche Glaubwürdigkeit verschafft.

Zu den Risiken gehören Konkurrenz durch zentralisierte Anbieter, die effizienter skalieren, potenzielle Hardware-Zentralisierung, da die Mining-Ökonomie große Betreiber bevorzugt, sowie die Frage, ob dezentrale GPU-Marktplätze eine nachhaltige Adoption erreichen oder Nischenlösungen bleiben.

Vergleichsanalyse: Utility-Token vs. Store-of-Value-Token

KI-Utility-Token folgen grundsätzlich anderen Wertversprechen als Store-of-Value-Token wie Bitcoin und Ethereum. Das Verständnis dieser Unterschiede verdeutlicht sowohl Chancen als auch Herausforderungen für die Kategorie der Utility-Token.

Zweck und Nachfragefaktoren

Der Wert von Bitcoin resultiert in erster Linie aus seiner Positionierung als digitales Gold – ein knappes, dezentrales Wertaufbewahrungsmittel und Absicherung gegen monetäre Inflation. Das Angebotslimit von 21 Millionen Bitcoin und eine Marktkapitalisierung von über 2 Billionen $ positionieren BTC als makroökonomische Anlageklasse. Ethereum fügt Programmierbarkeit hinzu und leitet seinen Wert daraus ab, als Abwicklungsschicht für DeFi-Protokolle, NFTs und andere Anwendungen zu dienen; die Nachfrage nach ETH entsteht durch Gasgebühren und Staking-Anforderungen.

Utility-Token wie TAO, FET und RENDER leiten ihren Wert hingegen aus der Nutzung des Netzwerks ab. Die Nachfrage korreliert theoretisch mit den verarbeiteten Rechenjobs, den eingesetzten Agenten und den abgeschlossenen Rendering-Aufträgen. Mehr auf Bittensor trainierte KI-Modelle sollten die TAO-Nachfrage für den Zugang zu Intelligenz erhöhen. Mehr autonome Agenten auf Fetch.ai sollten FET-Transaktionen antreiben. Mehr Rendering-Jobs sollten mehr RENDER-Token verbrennen.

Tokenomics und Governance

Store-of-Value-Token betonen Knappheit. Bitcoins fixes Angebot und Halving-Zyklen schaffen vorhersehbare Emissionsreduktionen. Ethereum ist mit Proof-of-Stake und EIP-1559, das Transaktionsgebühren verbrennt, zu einem System mit deflationärem Druck bei hoher Netzauslastung übergegangen.

Utility-Token nutzen unterschiedliche Ansätze. Bittensor imitiert das Halving-Modell von Bitcoin und erzeugt Knappheit. Renders Burn-and-Mint Equilibrium koppelt das Angebot an die Nutzung – bei hoher Nachfrage werden mehr Token verbrannt als neu geprägt, was das Angebot reduziert. Fetch.ai behält ein fixes Angebot bei, setzt aber auf Staking-Anreize, um die Umlaufgeschwindigkeit zu senken.

Die Governance unterscheidet sich deutlich. Bitcoin verfolgt einen konservativen Entwicklungsansatz mit minimalen Protokolländerungen.

Ethereum nutzt Off-Chain-Koordination und letztlich groben Konsens. Utility-Token implementieren häufig direkte On-Chain-Governance, bei der Token-Inhaber über Protokoll-Upgrades, Finanzierungsanträge und Parameteranpassungen abstimmen und so der Community eine aktivere Steuerung ermöglichen.

Adoptionspfade und Nutzerbasis

Store-of-Value-Token zielen auf Investoren, die ein Exposure zu Krypto-Assets oder eine Absicherung gegen das traditionelle Finanzsystem suchen. Bitcoin spricht Personen an, die an Prinzipien soliden Geldes glauben. Ethereum zieht Entwickler und Nutzer an, die mit DeFi- und Web3-Anwendungen interagieren.

Utility-Token müssen spezifische Nutzertypen gewinnen. Bittensor benötigt KI-Forscher und Datenwissenschaftler, die dezentrales Modelltraining etablierten Frameworks vorziehen. Fetch.ai braucht Entwickler, die autonome Agenten für reale Anwendungen aufbauen. Render ist auf Kreativprofis angewiesen, die dezentraler Infrastruktur für Produktions-Workflows vertrauen.

Diese Adoptionshürden sind höher. Entwickler sehen sich Wechselkosten von bestehenden Tools gegenüber. Unternehmen verlangen Zuverlässigkeit und Support, die junge dezentrale Netzwerke möglicherweise nur schwer bieten können. Utility-Token müssen klare Vorteile – Kosten, Performance, Funktionen – aufweisen, um diese Trägheit zu überwinden.

Mechanismen der Wertabschöpfung

Store-of-Value-Token schöpfen Wert durch Knappheit und Netzwerkeffekte ab.

Je mehr Teilnehmer Bitcoin als Wertaufbewahrungsmittel erkennen, desto stärker steigt die Nachfrage, während das Angebot fix bleibt, was die Preise nach oben treibt. Diese spekulative Rückkopplung verstärkt sich selbst, erzeugt aber auch Volatilität.

Utility-Token stehen vor dem Velocity-Problem. Wenn Nutzer verdiente Token sofort in Fiat oder andere Krypto-Assets umtauschen, verhindert eine hohe Umlaufgeschwindigkeit die Wertakkumulation. Die Quantitätsgleichung (M×V = P×Q) legt nahe, dass bei gegebenem Transaktionsvolumen (P×Q) eine höhere Umlaufgeschwindigkeit (V) eine niedrigere Marktkapitalisierung (M) bedeutet.

Protokolle begegnen hoher Velocity mit mehreren Mechanismen. Staking-Anforderungen sperren Token und senken das zirkulierende Angebot. Bittensor verlangt von Validatoren, TAO zu staken. Fetch.ai belohnt Staker mit Netzwerkgebühren. Burn-Mechanismen wie bei Render entfernen Token dauerhaft aus dem Umlauf. Governance-Rechte schaffen Anreize, Token für Stimmmacht zu halten.

Marktperformance und Entwicklungspfade

Bitcoin erreichte Allzeithochs von über 126.000 $ im Jahr 2025 und setzte seine Entwicklung als Makro-Asset fort. Ethereum erholte sich von Rücksetzern nach 2022 und behauptete seine Rolle als primäre Smart-Contract-Plattform.

KI-Utility-Token zeigten eine volatilere Performance. TAO wurde 2024–2025 zwischen 200–750 $ gehandelt, mit einer Marktkapitalisierung von 3,7–4,1 Milliarden $ an den Spitzen. FET verzeichnete starke Kursbewegungen, insbesondere rund um die Artificial Superintelligence Alliance-Ankündigung. RENDER erlebte explosives Wachstum 2023–2024, bevor der Kurs konsolidierte.

Diese Token werden sowohl auf Grundlage von Spekulation als auch Fundamentaldaten gehandelt. Wenn KI-Narrative den Krypto-Diskurs dominieren, performen Utility-Token überdurchschnittlich. In Abschwüngen schneiden sie häufig schlechter ab als Bitcoin und Ethereum, da Investoren in vermeintlich sicherere Assets flüchten.

Koexistenz oder Konkurrenz?

Die Frage ist, ob Utility-Token die „nächste Welle“ darstellen oder als komplementäre Kategorie koexistieren. Die Evidenz spricht eher für Koexistenz. Store-of-Value-Token erfüllen andere Zwecke als operationale Token. Bitcoin fungiert als digitales Gold, Ethereum als programmierbare Abwicklungsschicht, während Utility-Token als Treibstoff für spezifische Anwendungen dienen.

Der Erfolg ist jedoch nicht garantiert. Die meisten Utility-Token könnten scheitern, wenn die Nutzung ausbleibt oder zentralisierte Alternativen überlegen sind. Die Marktkapitalisierung von KI-Krypto erreichte 24–27 Milliarden $ im Jahr 2025 – beachtlich, aber klein im Vergleich zu Bitcoin allein mit über 2 Billionen $.

Wahrscheinliche Gewinner werden Folgendes aufweisen:

- Nachhaltige Netzwerknutzung, die sich unabhängig von Spekulation entwickelt

- Klare Vorteile gegenüber zentralisierten Alternativen

- Starke Entwickler-Ökosysteme und Unternehmensadoption

- Effektive Begrenzung der Velocity durch Staking oder Burning

- Governance-Modelle, die Dezentralisierung und Effizienz ausbalancieren

Der letztliche Test ist, ob Utility-Token zu Infrastruktur für KI-Workloads im großen Maßstab werden oder ob sie Nischenlösungen bleiben, die von zentralisierten Cloud-Anbietern überschattet werden.

Bewertung, Adoptionsmetriken & Narrativrisiko

Die Bewertung von Utility-Token erfordert andere Rahmenwerke als die Beurteilung von Store-of-Value-Assets. Während Bitcoin über Stock-to-Flow-Modelle oder als digitales Gold im Vergleich zu Edelmetallen bewertet werden kann, verlangen Utility-Token nutzungsbasierte Kennzahlen.

Zentrale Kennzahlen für Utility-Token

Netzwerknutzungsstatistiken bilden die Grundlage. Für Bittensor umfassen sinnvolle Metriken:

- Anzahl aktiver Subnetze und ihre Spezialisierungen

- Rechenstunden, die dem Modelltraining gewidmet sind

- Anzahl der Miner und Validatoren, die das Netzwerk sichern

- Transaktionsvolumen, das durch das Protokoll fließt

- Erfolgreiche Modellbereitstellungen, die reale Anwendungen bedienen

Bittensor meldet 128 aktive Subnetze Ende 2025, ein erheblicher Anstieg gegenüber früheren Perioden. Die Beurteilung, ob diese Subnetze echte Nachfrage erzeugen oder eher spekulative Aktivität widerspiegeln, erfordert jedoch eine tiefere Untersuchung.

Für Fetch.ai sind relevante Kennzahlen:

- Anzahl der bereitgestellten autonomen Agenten

- Agent-zu-Agent-Interaktionen und Transaktionsvolumen

- Reale Integrationen in verschiedenen Branchen

- Partnerschaften mit Unternehmen oder Regierungen

- Staking-Beteiligung und Zahl der Validatoren

Fetch.ai zeigte Proof-of-Concepts in den Bereichen Parkkoordination, Energiehandel und Logistik, doch die Skalierung von Pilotprojekten zur breiten Adoption bleibt die Herausforderung.

Für das Render Network sind entscheidende Indikatoren:

- Monatlich verarbeitete Rendering-Jobs

- Anzahl aktiver Node-Betreiber, die GPU-Kapazität bereitstellen

- Unternehmenskunden, die das Netzwerk für Produktions-Workflows nutzen

- Burn-Rate im Vergleich zur Mint-Rate im Rahmen des Burn-and-Mint Equilibrium

- Genutzte GPU-Stunden im dezentralen Netzwerk

Render hat sich wichtige Studio-Partnerschaften gesichert und verarbeitet reale Rendering-Workloads, was im Vergleich zu vielen Utility-Token konkretere Nutzungsevidenz liefert.

Token-Velocity und Burn-Metriken

Token-Velocity misst, wie schnell Token durch die Ökonomie zirkulieren. Hohe Velocity zeigt an, dass Nutzer Token sofort ausgeben oder umtauschen, was Wertakkumulation verhindert. Niedrige Velocity deutet darauf hin, dass Token länger gehalten werden, potenziell als Wertaufbewahrungsmittel oder für Staking Rewards.

Bitcoin weist eine Umlaufgeschwindigkeit von 4,1 % auf, Ethereum 3,6 %, was auf gereifte Assets hindeutet, die überwiegend gehalten statt regelmäßig transferiert werden. Utility-Token zeigen typischerweise anfangs höhere Umlaufgeschwindigkeiten, da Nutzer Token für Arbeit erhalten und diese unmittelbar in stabile Währungen umtauschen.

Burn-Mechanismen bekämpfen hohe Umlaufgeschwindigkeit. Das System von Render verbrennt 95 % der Zahlungs-Token bei jeder Transaktion und nimmt sie so aus dem Umlauf. Übersteigt die Burn-Rate die Mint-Rate, verringert sich das zirkulierende Angebot, was bei konstanter Nachfrage potenziell den Preis stützen kann.

Die Bewertung von Burns erfordert Transparenz. Projekte sollten regelmäßige Burn-Berichte veröffentlichen, die zeigen, wie viele Token aus dem Umlauf entfernt wurden. Render stellt diese Daten bereit und ermöglicht so eine unabhängige Überprüfung der deflationären Aussagen.

Partnerschaften und Integrationen in der realen Welt

Die Einführung im Unternehmenssektor signalisiert echte Utility. Bittensors erste ETP-Einführung an der SIX Swiss Exchange ermöglicht institutionellen Zugang. Interactive Strengths FET-Schatz von 500 Millionen US-Dollar demonstriert unternehmerisches Vertrauen. Renders Partnerschaften mit Disney, HBO und Unity bestätigen die Fähigkeiten der Plattform für Produktions-Workflows.

Allerdings garantieren Partnerschaften allein keine nachhaltige Nutzung. Viele Blockchain-Projekte kündigen Partnerschaften an, die sich nicht in nennenswerte Umsätze oder Netzwerkaktivität umsetzen. Die Beobachtung des tatsächlichen Transaktionsvolumens, das aus Unternehmensbeziehungen entsteht, liefert klarere Einblicke.

Narrativ-Risiken

Mehrere Narrativ-Risiken bedrohen die Bewertungen von Utility-Token:

KI + Krypto-Hype ohne Ergebnisse: Die Konvergenz von KI und Blockchain erzeugt starke Narrative, doch wenn dezentralisierte KI-Systeme nicht die Performance zentralisierter Alternativen erreichen, fallen Bewertungen. Die meisten Experten erwarten, dass nur ausgewählte KI-Krypto-Projekte langfristig Erfolg haben, während viele spekulativ bleiben.

Rechenleistung ohne Nachfrage: Der Aufbau dezentraler GPU-Infrastruktur ist bedeutungslos, wenn Entwickler sie nicht nutzen. Wenn die Nutzung nicht über Early Adopter und Evangelisten hinaus skaliert, werden Token zu Lösungen auf der Suche nach Problemen. Die Frage ist, ob dezentrale Rechenleistung einen signifikanten Marktanteil erobern kann von AWS, Google Cloud und anderen zentralisierten Giganten.

Regulatorische Risiken: Regierungen weltweit entwickeln KI-Regulierungen. Der risikobasierte Rahmen des EU AI Act könnte bestimmte KI-Systeme als Hochrisiko einstufen und Prüfungen sowie Aufsicht verlangen. Autonome Agenten, die wirtschaftliche Entscheidungen treffen, könnten unter besondere Beobachtung geraten. Die Unsicherheit darüber, ob Utility-Token Wertpapiere darstellen, erhöht das regulatorische Risiko.

Hardware-Zentralisierung: Dezentrale Netzwerke laufen Gefahr, wieder zentralisiert zu werden. Wenn Mining oder der Betrieb von Nodes nur noch für große Akteure mit Skaleneffekten wirtschaftlich ist, verblasst das Dezentralisierungsversprechen. GPU-Netzwerke könnten sich um große Rechenzentren konzentrieren und damit den Zweck einer Peer-to-Peer-Infrastruktur unterlaufen.

Technische Begrenzungen: Dezentrale Systeme haben inhärente Trade-offs. Koordinationsaufwand, Latenz und Zuverlässigkeitsprobleme können verhindern, dass Utility-Token mit optimierten zentralisierten Alternativen konkurrieren. Wenn sich technische Beschränkungen als unüberwindbar erweisen, stagniert die Adoption.

Bewertungsrahmen

Traditionelle Finanzmodelle haben Schwierigkeiten mit Utility-Token. Die Discounted Cash Flow (DCF)-Analyse funktioniert für Token mit Gewinnbeteiligung – Augur zahlt REP-Inhabern für Netzwerk-Arbeit, wodurch Cashflow-Ströme entstehen, die sich für DCF-Analysen eignen. Reine Utility-Token ohne Dividenden haben jedoch keine offensichtlichen Cashflows, die diskontiert werden könnten.

Die Tauschgleichung bietet einen Ansatz: M×V = P×Q, wobei M die Marktkapitalisierung ist (die gesuchte Größe), V die Umlaufgeschwindigkeit, P der Preis pro Transaktion und Q die Anzahl der Transaktionen. Umgestellt: M = P×Q / V. Dies impliziert, dass die Marktkapitalisierung dem Transaktionsvolumen geteilt durch die Umlaufgeschwindigkeit entspricht.

Höheres Transaktionsvolumen (P×Q) stützt höhere Bewertungen. Niedrigere Umlaufgeschwindigkeit (V) stützt ebenfalls höhere Bewertungen. Projekte müssen entweder die Nutzung erhöhen oder die Umlaufgeschwindigkeit senken – idealerweise beides. Staking verringert die Umlaufgeschwindigkeit; Burn-Mechanismen verringern das Angebot; echte Utility erhöht das Transaktionsvolumen.

Metcalfes Gesetz legt nahe, dass der Netzwerkwert proportional zum Quadrat der Nutzerzahl wächst. Wenn mehr Teilnehmer Bittensor, Fetch.ai oder Render beitreten, könnten Netzwerkeffekte ein exponentielles Wertwachstum antreiben. Allerdings setzt dieses Gesetz voraus, dass alle Verbindungen wertvoll sind – was für Netzwerke in der Frühphase nicht immer zutrifft.

Die vergleichende Bewertung betrachtet ähnliche Projekte. Wenn Bittensor eine ähnliche Netzauslastung wie SingularityNET oder Ocean Protocol erreicht, liefert der Vergleich der Marktkapitalisierungen grobe Anhaltspunkte. Allerdings begrenzen die einzigartigen Tokenomics und Use Cases jedes Projekts die Nützlichkeit direkter Vergleiche.

Letztlich bleibt die Bewertung von Utility-Token spekulativ. Solange Netzwerke keine nachhaltige Nutzung unabhängig von Spekulation nachweisen, spiegeln die Preise die Stärke des Narrativs und die Marktstimmung ebenso wider wie fundamentale Werte.

Wie geht es weiter: Zukunftsszenarien

Der Entwicklungspfad für KI-Utility-Token hängt von mehreren unsicheren Variablen ab: Technologie-Adoptionsraten, regulatorische Entwicklungen, Konkurrenz durch zentrale Anbieter und die Fähigkeit der Token, Wert aus der Netzwerknutzung abzuschöpfen. Drei breite Szenarien beleuchten mögliche Zukünfte.

Best Case: Infrastruktur-Token werden zur Kernschicht

In diesem optimistischen Szenario erreicht dezentrale KI-Infrastruktur eine breite Mainstream-Adoption. Bittensor wird zur bevorzugten Plattform für kollaboratives KI-Modelltraining und zieht große Forschungseinrichtungen und Unternehmen an. Die Subnet-Architektur erweist sich für bestimmte Anwendungsfälle – datenschutzfreundliche Healthcare-KI, dezentrale Modell-Marktplätze, crowdsourced Intelligence – als überlegen gegenüber zentralisierten Frameworks.

Die autonomen Agenten von Fetch.ai verbreiten sich in zahlreichen Branchen. Smart Cities setzen Agenten-Netzwerke für Verkehrskoordination, Energieverteilung und öffentliche Dienstleistungen ein. Lieferketten standardisieren sich auf agentenbasierte Optimierung. DeFi-Protokolle integrieren Agenten für die automatisierte Ausführung von Strategien. Die „agentische Ökonomie“ materialisiert sich wie prognostiziert, mit Milliarden von Mikrotransaktionen, die von autonomer Software koordiniert werden.

Das Render Network gewinnt einen bedeutenden Marktanteil von zentralisierten GPU-Anbietern. Kreativschaffende und KI-Forscher nutzen routinemäßig dezentrale Rechenleistung für Produktions-Workflows. Der globale Cloud-Gaming-Markt, der bis 2032 voraussichtlich 121 Milliarden US-Dollar erreichen wird, treibt die Nachfrage nach verteilter GPU-Infrastruktur an.

In diesem Szenario gewinnen Utility-Token dauerhaften Wert durch:

- Nachhaltiges Nutzungswachstum: Die Netzwerkaktivität nimmt unabhängig von Spekulation zu

- Minderung der Umlaufgeschwindigkeit: Staking, Burning und Governance-Anreize sorgen dafür, dass Token gehalten statt sofort verkauft werden

- Netzwerkeffekte: Mit steigender Nutzerzahl werden Plattformen für alle Teilnehmer wertvoller

- Regulatorische Klarheit: Es entstehen Rahmenwerke, die dezentrale KI ermöglichen und gleichzeitig Verbraucher schützen

Die Tokenpreise könnten optimistische Analystenprognosen erreichen – TAO über 1.000 US-Dollar, FET im Bereich von 6–10 US-Dollar, RENDER über 20 US-Dollar –, sofern die Nutzungsfundamentaldaten die Bewertungen rechtfertigen. Die Marktkapitalisierungen würden proportional wachsen, wobei führende KI-Utility-Token potenziell Bewertungen von 20–50 Milliarden US-Dollar erreichen könnten, wenn sie Teile der Billionen-Märkte für KI und Cloud Computing erobern.

Für Investoren bedeutet dies eine erhebliche Wertsteigerung gegenüber dem aktuellen Niveau. Für Entwickler bestätigt es dezentrale Infrastruktur als tragfähige Alternative zu zentralisierten Cloud-Anbietern. Für Kryptomärkte beweist es, dass Utility-Token sich über reine Spekulation hinaus zu funktionalen Infrastruktur-Assets entwickeln können.

Auch lesen: Bitcoin Goes Below $67K After Trump Vows To Bomb Iran To 'Stone Ages'

Baseline: Ausgewählte Token setzen sich durch, viele stagnieren

Ein realistischeres Szenario erkennt an, dass nur ein Teil der aktuellen KI-Utility-Token eine nachhaltige Adoption erreichen wird. Gewinner zeichnen sich durch überlegene Technologie, starke Ökosysteme, echte Partnerschaften und effektive Mechanismen zur Wertabschöpfung aus. Die meisten Projekte stagnieren oder verschwinden, sobald Nutzer den begrenzten praktischen Nutzen erkennen.

In diesem Szenario haben Bittensor, Fetch.ai und Render – als führende Projekte – bessere Chancen als kleinere Wettbewerber. Dennoch stehen selbst diese vor Herausforderungen. Dezentrale KI erweist sich für spezifische Nischen – datenschutzkritische Anwendungen, zensurresistente Netzwerke, bestimmte Forschungsdomänen – als wertvoll, verdrängt zentrale Anbieter jedoch für die meisten Use Cases nicht.

Store-of-Value-Token bleiben dominant. Bitcoin festigt seine Position als digitales Gold. Ethereum dient weiterhin als primäre Settlement-Schicht für dezentrale Anwendungen. KI-Utility-Token koexistieren als Infrastruktur für spezialisierte Anwendungen, statt als universelle Plattformen.

Die Tokenpreise spiegeln moderates Nutzungswachstum wider. TAO könnte 500–800 US-Dollar erreichen, FET 2–4 US-Dollar, RENDER 8–12 US-Dollar in den kommenden Jahren – eine bedeutende Wertsteigerung, aber weit entfernt von explosiven Prognosen. Die Marktkapitalisierungen wachsen, bleiben jedoch um Größenordnungen unter denen von Bitcoin und Ethereum.

Mehrere Faktoren kennzeichnen dieses Basisszenario:

- Nischenadoption: Utility-Token bedienen bestimmte Verticals oder Use Cases effektiv

- Zentralisierte Konkurrenz: AWS, Google Cloud und andere Giganten behalten ihre Dominanz bei allgemeiner Rechenleistung

- Regulatorischer Overhead: Compliance-Anforderungen fügen dezentralen Plattformen zusätzliche Reibung hinzu

- Technische Trade-offs: Dezentralisierte Systeme erweisen sich für viele Anwendungen als langsamer, komplexer oder weniger zuverlässig als zentrale Alternativen.

Für Investoren belohnt eine moderate Wertsteigerung frühe Unterstützer, bleibt aber hinter den optimistischsten Prognosen zurück. Für Kryptomärkte etablieren Utility-Token ihre Legitimität als eigene Anlagekategorie, die sich von Store-of-Value-Token unterscheidet, jedoch mit moderateren Bewertungen.

Nachteil: Nutzung bleibt aus

Im pessimistischen Szenario gelingt es Utility-Token nicht, ihre technischen Fähigkeiten in eine nachhaltige Nachfrage zu übersetzen. Trotz beeindruckender Infrastruktur wechseln die Nutzer nicht von etablierten Plattformen. Entwickler verwenden weiterhin TensorFlow, PyTorch und zentralisierte Cloud-Compute-Dienste, anstatt neue, dezentrale Protokolle zu erlernen. Kreative Fachkräfte bleiben bei Adobe, Autodesk und traditionellen Renderfarmen, statt mit krypto-basierten Alternativen zu experimentieren.

In diesem Szenario werden KI-Utility-Token primär zu spekulativen Assets. Preise schwanken eher basierend auf der allgemeinen Marktstimmung im Kryptobereich und KI-Hype-Zyklen als auf fundamentaler Nutzung. Wenn Erzählungen verblassen – wie bei vielen ICO-Token der Jahre 2017–2018 – brechen die Bewertungen ein.

Mehrere Dynamiken könnten zu diesem Ergebnis führen:

- Reibungen in der Nutzererfahrung: Das Verwalten von Wallets, das Bezahlen von Gasgebühren und das Navigieren durch dezentrale Protokolle erweist sich für Mainstream-Nutzer als zu umständlich

- Leistungslücken: Zentrale Alternativen bleiben schneller, zuverlässiger und funktionsreicher als dezentrale Optionen

- Wirtschaftliche Tragfähigkeit: Token-Ökonomie richtet Anreize nicht richtig aus, was zu Anbieterfluktuation, Qualitätsproblemen oder Netzwerkinstabilität führt

- Regulatorische Durchgriffe: Regierungen stufen Utility-Token als Wertpapiere ein oder verbieten bestimmte Anwendungsfälle, was die legale Nutzung einschränkt

Tokenpreise würden auf spekulative Tiefstände zurückfallen. TAO könnte unter 200 $, FET unter 0,50 $, RENDER unter 3 $ fallen, wenn Investoren den Mangel an fundamentaler Nachfrage erkennen. Projekte könnten mit engagierten Communities überleben, würden aber keine sinnvolle Skalierung erreichen.

Dieses Szenario stellt ein existenzielles Risiko für die Kategorie der Utility-Token dar. Wenn führende Projekte mit beträchtlicher Finanzierung, talentierten Teams und realen Partnerschaften keinen Product-Market-Fit nachweisen können, deutet das darauf hin, dass das dezentrale KI/Compute-Modell auf großer Skala fundamental nicht funktioniert.

Also Read: Dogecoin Drops Below $0.089 On Bearish Signals

Konsequenzen in den verschiedenen Szenarien

Für Investoren: Risiko-Rendite-Profile unterscheiden sich drastisch zwischen den Szenarien. Der Best Case bietet Mehrfachrenditen, erfordert aber, dass sich mehrere Unsicherheiten positiv auflösen. Das Basisszenario bringt moderate Wertsteigerung bei geringerem Risiko. Der Downside-Fall bedeutet erhebliche Verluste.

Die Portfolio-Konstruktion sollte Szenariowahrscheinlichkeiten berücksichtigen. Kleine prozentuale Allokationen in Utility-Token bieten asymmetrisches Aufwärtspotenzial, falls der Best Case eintritt, während das Abwärtsrisiko begrenzt wird. Eine Konzentration auf Utility-Token statt Store-of-Value-Assets erhöht Volatilität und Risiko.

Für Entwickler: Auf Utility-Token-Plattformen aufzubauen, erfordert eine Bewertung der langfristigen Tragfähigkeit. Wenn sich Basis- oder Downside-Szenarien materialisieren, könnten Anwendungen auf diesen Plattformen Schwierigkeiten haben, Nutzer oder Finanzierung zu finden. Entwickler sollten sich optional halten – Anwendungen so designen, dass sie plattformübergreifend portierbar sind oder mit zentralisierten Backends betrieben werden können, falls sich dezentrale Infrastruktur als unzureichend erweist.

Für die Struktur der Kryptomärkte: Erfolg oder Misserfolg von Utility-Token prägt die weitere Entwicklung von Krypto. Wenn der Best Case eintritt, expandiert Krypto über Store-of-Value und DeFi hinaus in echte Infrastruktur. Wenn der Downside-Fall eintritt, bleibt Krypto primär ein spekulativer und finanzieller Bereich.

Worauf man achten sollte

Mehrere Indikatoren werden verdeutlichen, welches Szenario sich entfaltet:

Node-Anzahl und Teilnahme: Wachsende Zahlen von Minern, Validatoren und GPU-Anbietern signalisieren echte Netzwerkeffekte. Stagnierende oder rückläufige Teilnahme deutet auf mangelnde wirtschaftliche Tragfähigkeit hin.

Verarbeitete Compute-Jobs: Tatsächliche Rendering-Jobs, KI-Trainingsläufe und Agenten-Interaktionen – nicht nur Testnet-Aktivität – demonstrieren reale Nachfrage. Projekte sollten transparente Nutzungsstatistiken veröffentlichen.

Unternehmenspartnerschaften: Die Umwandlung angekündigter Partnerschaften in messbares Transaktionsvolumen validiert Geschäftsmodelle. Partnerschaften ohne begleitende Nutzung deuten auf potenzielles „Vaporware“ hin.

Token-Burns und Staking: Bei Projekten mit Burn-Mechanismen weist eine Burn-Rate, die über der Mint-Rate liegt, auf starke Nachfrage hin. Hohe Staking-Teilnahme reduziert die Umlaufgeschwindigkeit und zeigt Vertrauen langfristiger Halter.

Entwickleraktivität: Wachsende Entwickler-Ökosysteme – gemessen an GitHub-Commits, neuen Protokollen, die auf den Plattformen aufbauen, und Hackathon-Teilnahmen – signalisieren gesunde Grundlagen. Nachlassendes Entwicklerinteresse kündigt Stagnation an.

Regulatorische Klarheit: Klarere Rahmenbedingungen für Utility-Token, KI-Systeme und dezentrale Infrastruktur verringern Unsicherheit. Günstige Regulierung beschleunigt die Adoption; restriktive bremst sie.

Hardware-Ökosysteme: Integration mit großen GPU-Herstellern oder Cloud-Anbietern legitimiert dezentrale Compute-Netzwerke. Wenn Nvidia, AMD und andere mit Utility-Token-Plattformen kooperieren oder sie anerkennen, wäre das ein Signal für Mainstream-Validierung.

Die Verfolgung dieser Kennzahlen in den Jahren 2025–2027 wird klären, ob KI-Utility-Token echte Infrastrukturinnovation darstellen oder primär spekulative Vehikel sind. Diese Unterscheidung entscheidet, ob diese Assets dauerhafte Bedeutung in den Kryptomärkten erlangen oder als weitere abgeschlossene Narrative-Phase verblassen.

Abschließende Gedanken

KI-Utility-Token stellen eine bedeutende Weiterentwicklung in der architektonischen Erzählung von Krypto dar. Bittensor, Fetch.ai und Render Network zeigen, dass Token andere Zwecke erfüllen können als nur Store-of-Value oder spekulativen Handel – sie können dezentrale Infrastruktur koordinieren, Rechenarbeit incentivieren und Maschinen-zu-Maschinen-Ökonomien ermöglichen.

Die grundlegende These ist überzeugend.

Dezentrale GPU-Netzwerke bündeln ungenutzte Ressourcen, senken Kosten und demokratisieren den Zugang. Autonome Agenten ermöglichen Koordination in Größenordnungen, die für menschliche Vermittlung unpraktisch sind.

Kollaborative KI-Entwicklung verteilt die Schaffung von Intelligenz über die Monopole der Tech-Giganten hinaus. Diese Visionen adressieren reale Probleme in Infrastrukturskalierung, KI-Zugänglichkeit und wirtschaftlicher Koordination.

Die Umsetzung der Vision in nachhaltige Adoption bleibt jedoch die entscheidende Herausforderung. Utility-Token müssen klare Vorteile gegenüber zentralisierten Alternativen nachweisen und gleichzeitig die mit dezentralen Systemen verbundenen Reibungen überwinden. Sie müssen Wert durch Nutzung statt durch Spekulation einfangen, das Geschwindigkeitsproblem durch effektive Tokenomics lösen und Product-Market-Fit bei Unternehmen und Entwicklern erreichen.

Read Next: XRP Ledger Hits Record 4.49M Transactions Amid Price Decline