Zapomnij o memecoinach i cyklach hype’u — tokeny użyteczności AI to nowy gatunek krypto, który naprawdę coś robi.

Po cichu budują most między blockchainem a ogromną infrastrukturą obliczeniową napędzającą sztuczną inteligencję. A gdy AI wdziera się we wszystko — od pisania skryptów po projektowanie molekuł — te tokeny ewoluują razem z nią, przesuwając się od spekulacyjnych żetonów na kasynowym stole w stronę realnych narzędzi podtrzymujących pracę zdecentralizowanych sieci.

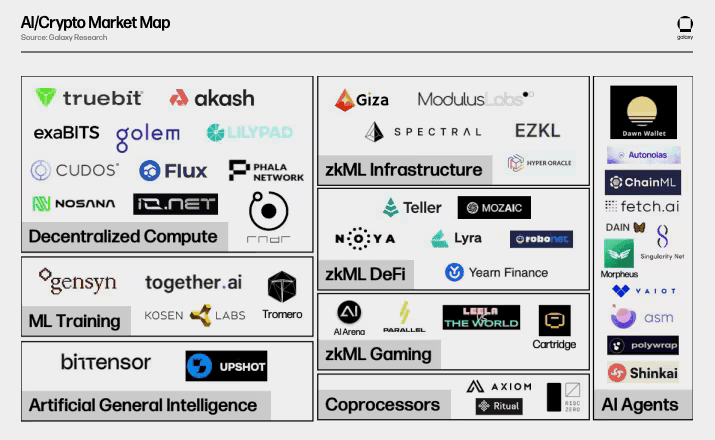

Trzy projekty stoją na czele tej zmiany: Bittensor (TAO), Fetch.ai (FET) oraz Render Token (RNDR).

Bittensor operates a decentralized machine learning network, w której uczestnicy wspólnie trenują modele AI i otrzymują nagrody. Fetch.ai wdraża autonomicznych agentów ekonomicznych realizujących zadania w łańcuchach dostaw, na rynkach energii i w zdecentralizowanych finansach. Render Network przekształca niewykorzystaną moc GPU w peer-to-peer marketplace do renderingu 3D, efektów wizualnych i wnioskowania AI.

Te tokeny reprezentują coś więcej niż stopniową innowację.

Sygnalizują potencjalną zmianę architektury w krypto: odejście od narracji „cyfrowego złota”, opartej na niedoborze i funkcji przechowywania wartości, w stronę ekosystemów napędzanych użytecznością, w których tokeny ułatwiają realną pracę obliczeniową.

Podczas gdy Bitcoin (BTC) i Ethereum (ETH) ugruntowały swoją pozycję dzięki narracjom monetarnym i platformowym, tokeny użyteczności AI proponują inną tezę wartości: tokeny jako klucze dostępu do zdecentralizowanej infrastruktury, szyny płatnicze dla gospodarek machine‑to‑machine oraz mechanizmy nagradzania za zasoby obliczeniowe.

Poniżej szczegółowo wyjaśniamy, dlaczego te tokeny zyskują dziś na popularności, analizujemy ich modele użyteczności i tokenomikę, oceniamy dynamikę konkurencyjną i ryzyka narracyjne, omawiamy ramy wyceny oraz szersze implikacje tego, jak tokeny użyteczne mogą ewoluować względem ugruntowanych aktywów typu store‑of‑value.

Dlaczego tokeny użyteczności, dlaczego teraz

Zbieg przyspieszenia rozwoju AI i dojrzewania infrastruktury blockchain stworzył warunki sprzyjające adopcji tokenów użyteczności. Kilka makro‑czynników wyjaśnia obecne momentum.

Po pierwsze, popyt na moc obliczeniową pod AI eksplodował.

Trenowanie zaawansowanych modeli językowych i generowanie mediów syntetycznych wymaga ogromnych zasobów GPU, co tworzy wąskie gardła w scentralizowanej infrastrukturze chmurowej. Tradycyjni dostawcy, tacy jak AWS czy Google Cloud, mają problem z zaspokojeniem popytu — centra danych są wykorzystywane średnio tylko w 12–18%, podczas gdy niedobory GPU utrzymują się. Ta nierównowaga podaży i popytu windowała koszty obliczeń, czyniąc zdecentralizowane alternatywy ekonomicznie opłacalnymi.

Po drugie, wcześniejsze cykle krypto skupiały się głównie na protokołach DeFi i narracjach store‑of‑value. Jednak do lat 2024–2025 infrastructure and compute emerged jako dominujący motyw.

The total crypto market cap crossed $4 trillion in 2025, and within that growth, AI-crypto projects captured significant investor attention.

Projekty oferujące namacalną infrastrukturę, a nie wyłącznie produkty finansowe, zyskały na znaczeniu wraz z dojrzewaniem rynku.

Po trzecie, tokenizacja oferuje unikalne korzyści przy koordynowaniu rozproszonych zasobów.

Zdecentralizowane sieci GPU, takie jak Render, mogą agregować niewykorzystaną moc obliczeniową globalnie, umożliwiając cost savings of up to 90% w porównaniu ze scentralizowanymi alternatywami. Tokeny pełnią funkcję warstwy koordynacji ekonomicznej: twórcy płacą za usługi renderingu w RNDR, operatorzy węzłów zarabiają za udostępnianie mocy GPU, a protokół utrzymuje przejrzystość dzięki transakcjom na blockchainie.

Ten model użyteczności ostro kontrastuje z tokenami store‑of‑value. Propozycja wartości Bitcoina koncentruje się na fixed supply scarcity i jego pozycji cyfrowego złota. Ethereum dodaje programowalność, ale nadal czerpie znaczną część wartości z roli warstwy rozliczeniowej i zabezpieczenia aktywów. Tokeny użyteczności, takie jak TAO, FET i RNDR, czerpią wartość z wykorzystania sieci: im więcej modeli AI trenuje się na Bittensor, im więcej autonomicznych agentów działa na Fetch.ai, im więcej zadań renderingu przetwarza Render Network, tym teoretycznie większy popyt na token.

To przesunięcie w stronę użyteczności nie jest wyłącznie narracją. Render Network processes rendering jobs dla dużych studiów, korzystając ze zdecentralizowanych węzłów. Fetch.ai pokazało realne zastosowania, w tym autonomous parking coordination in Cambridge oraz systemy handlu energią. Architektura subnetów Bittensora obejmuje już 128 active subnets skoncentrowanych na różnych domenach AI — od generowania tekstu po składanie białek.

Jednak adopcja użyteczności mierzy się z wyzwaniami. Większość tokenów wciąż handlowana jest głównie ze względu na wartość spekulacyjną, a nie fundamenty wykorzystania. Prędkość obrotu tokenem — to, jak szybko przechodzi z rąk do rąk — może podważać stabilność ceny, jeśli użytkownicy natychmiast zamieniają nagrody na inne aktywa. Pytanie brzmi, czy protokoły te wygenerują wystarczające użycie, by uzasadnić swoje wyceny, czy jednak pozostaną aktywami napędzanymi narracją i podatnymi na cykle hype’u.

Also Read: Bitcoin Decentralization Faces A Problem: Mining Power Tied To Just Three Nations

Token 1: Bittensor (TAO) – szczegółowa analiza

Czym jest Bittensor

Bittensor is an open-source protocol, który zasila zdecentralizowaną sieć uczenia maszynowego. W przeciwieństwie do tradycyjnego rozwoju AI skoncentrowanego w laboratoriach gigantów technologicznych, Bittensor tworzy rynek peer‑to‑peer, na którym deweloperzy dostarczają modele uczenia maszynowego, walidatorzy oceniają ich jakość, a kontrybutorzy otrzymują nagrody w zależności od wartości informacyjnej, jaką wnoszą do zbiorowej inteligencji.

Protokół został founded by Jacob Steeves and Ala Shaabana, badaczy informatyki, którzy uruchomili sieć, by zdemokratyzować rozwój AI. Wizja jest ambitna: stworzyć rynek sztucznej inteligencji, na którym producenci i konsumenci wchodzą w interakcje w beztrustowym, przejrzystym środowisku, bez scentralizowanych strażników.

Użyteczność i mechanika

Token TAO pełni wiele funkcji w ekosystemie. Najbardziej fundamentalnie TAO grants access to the network's collective intelligence. Użytkownicy pozyskują informacje z wytrenowanych modeli, płacąc w TAO, podczas gdy kontrybutorzy, którzy dodają wartość do sieci, zdobywają większy stake. Tworzy to strukturę zachęt, w której wkład modeli wysokiej jakości jest lepiej wynagradzany.

Sieć działa w oparciu o architekturę subnetów. Each subnet specializes in different AI tasks — przetwarzanie języka naturalnego, rozpoznawanie obrazów, predykcja danych — i korzysta z własnej logiki oceny. Modele konkurują w subnetach na podstawie dokładności i efektywności. Walidatorzy stakują TAO, aby oceniać wyniki modeli i zapewniać uczciwe punktowanie. Nominatorzy wspierają konkretnych walidatorów lub subnetworki i partycypują w nagrodach, podobnie jak w systemach delegated proof‑of‑stake.

Ta modułowa konstrukcja pozwala Bittensorowi skalować się jednocześnie w wielu domenach AI. Zamiast monolitycznej sieci, protokół działa jako infrastruktura dla wyspecjalizowanych rynków AI, z własnymi kryteriami oceny i dystrybucji nagród.

Tokenomika

Tokenomika Bittensora odzwierciedla model niedoboru Bitcoina. TAO has a fixed supply of 21 million tokens, a emisja podąża za harmonogramem halvingów. first halving occurred in 2025, zmniejszając dzienną emisję z 7200 do 3600 tokenów. Ten deflacyjny mechanizm tworzy niedobór podaży podobny do czteroletnich cykli Bitcoina.

Obecnie approximately 9.6 million TAO tokens are in circulation, co stanowi około 46% całkowitej podaży. circulating supply will continue growing, ale w coraz wolniejszym tempie z powodu halvingów; pełna dystrybucja przewidziana jest na kolejne dekady.

Nagrody „wydobywcze” trafiają do kontrybutorów, którzy skutecznie podnoszą inteligencję sieci. Walidatorzy zarabiają za dokładną ocenę wkładu modeli. Ten podwójny system nagradzania zachęca zarówno do rozwoju modeli, jak i utrzymania integralności sieci.

Przypadki użycia

Zastosowania Bittensora obejmują wiele dziedzin. Collective learning pozwala instytucjom medycznym trenować modele na wrażliwych danych bez udostępniania surowych informacji — pokazano to przy wykrywaniu COVID‑19 na zdjęciach RTG klatki piersiowej z 90% dokładnością. Instytucje finansowe mogą wspólnie trenować modele wykrywania oszustw, zachowując poufność własnych danych.

Struktura subnetów umożliwia wyspecjalizowane usługi AI. Subnety generowania tekstu konkurują o tworzenie wysokiej jakości treści językowych. Rynki predykcyjne wykorzystują możliwości inferencji Bittensora. Usługi embeddingu przetwarzają i kodują dane dla aplikacji downstream. Każdy subnet działa autonomicznie, jednocześnie kontrybuując do the broader intelligence marketplace.

Adopcja korporacyjna jest wciąż w początkowej fazie, lecz rośnie. Deutsche Digital Assets i Safello uruchomiły pierwszy na świecie fizycznie zabezpieczony Bittensor ETP na giełdzie SIX Swiss Exchange w listopadzie 2025 r., zapewniając inwestorom instytucjonalnym regulowany dostęp do TAO. Ten rozwój sygnalizuje dojrzewające zainteresowanie wykraczające poza detaliczną spekulację.

Competition and Ecosystem

Bittensor konkuruje na polu zdecentralizowanej AI z projektami takimi jak SingularityNET (AGIX) i Ocean Protocol (OCEAN). SingularityNET prowadzi rynek AI, na którym deweloperzy monetyzują algorytmy i usługi. Ocean koncentruje się na rynkach danych i aplikacjach compute-to-data. Każdy projekt inaczej podchodzi do zdecentralizowanej AI – Bittensor kładzie nacisk na współpracę przy trenowaniu modeli, SingularityNET na rynki usług, a Ocean priorytetyzuje aktywa danych.

Jednak największe zagrożenie konkurencyjne pochodzi od scentralizowanych gigantów AI. OpenAI, Google DeepMind i Anthropic dysponują ogromnymi zasobami, zastrzeżonymi zbiorami danych i najnowocześniejszym talentem. Podmioty te mogą iterować szybciej i wdrażać bardziej zaawansowane modele, niż obecnie osiągają alternatywy zdecentralizowane. Bittensor musi wykazać, że jego model współpracy tworzy rozwiązania konkurencyjne wobec scentralizowanych alternatyw – nie tylko atrakcyjne filozoficznie, lecz technicznie lepsze dla konkretnych zastosowań.

Aktualizacja inteligentnych kontraktów WebAssembly (WASM) sieci w 2025 r. rozszerzyła funkcjonalność, umożliwiając funkcje takie jak pożyczki, automatyczny handel tokenami subnetów oraz aplikacje między-subnetowe. Ten rozwój infrastruktury ma na celu stworzenie bardziej kompleksowej gospodarki cyfrowej, wykraczającej poza samo trenowanie modeli.

Narrative Risk and Valuation

Wycena Bittensora mierzy się z kilkoma napięciami. 12 listopada 2025 r. TAO handlowany był w okolicach 362–390 USD, z kapitalizacją rynkową około 3,7–4,1 mld USD. Token osiągał wcześniej w 2025 r. poziomy powyżej 400 USD, lecz doświadczał zmienności typowej dla aktywów kryptowalutowych.

Byki wskazują na kilka czynników wzrostu.

Mechanizm halvingu tworzy presję deflacyjną, która potencjalnie wspiera aprecjację ceny, jeśli popyt pozostanie stabilny. Analitycy przewidują cele w przedziale 360–500 USD w 2026 r. oraz bardziej agresywne prognozy przekraczające 1 000 USD w latach 2027–2030, choć te przewidywania obarczone są znaczną niepewnością.

Fundamentalne pytanie brzmi, czy wykorzystanie sieci uzasadnia obecną wycenę.

Teoria prędkości obrotu tokena sugeruje, że tokeny użytkowe wykorzystywane głównie do transakcji mają trudności z utrzymaniem wartości, ponieważ użytkownicy szybko konwertują nagrody na inne aktywa.

Bittensor łagodzi to poprzez staking – walidatorzy muszą zablokować TAO, aby uczestniczyć w konsensusie sieci, co redukuje podaż w obiegu i prędkość obrotu.

Jeśli jednak Bittensor nie przyciągnie znaczących obciążeń AI poza swoją obecną aktywnością subnetów, token stanie się głównie spekulacyjny. Protokół musi wykazać, że zdecentralizowane trenowanie modeli oferuje na tyle przekonujące przewagi, by uzasadnić migrację deweloperów z ugruntowanych frameworków, takich jak TensorFlow czy PyTorch połączonych ze scentralizowaną mocą obliczeniową.

Ryzyka obejmują konkurencję technologiczną, niepewność regulacyjną wokół systemów AI, potencjalne luki bezpieczeństwa w protokole oraz wyzwanie utrzymania decentralizacji w miarę skalowania sieci. Niedawny 20% tygodniowy spadek podkreśla utrzymującą się zmienność, nawet gdy rośnie szersze zainteresowanie instytucjonalne.

Token 2: Fetch.ai (FET) Deep Dive

What Fetch.ai Is

Fetch.ai to ekosystem blockchain, który wykorzystuje AI i automatyzację do umożliwienia działania autonomicznych agentów ekonomicznych – cyfrowych bytów, które samodzielnie wykonują zadania w imieniu użytkowników, urządzeń lub organizacji.

Założony w 2017 r. i uruchomiony poprzez IEO na Binance w marcu 2019 r. Fetch.ai ma na celu demokratyzację dostępu do technologii AI poprzez zdecentralizowaną sieć.

Definiującą cechą platformy są Autonomiczni Agenci Ekonomiczni (AEA).

Są to programowe byty, które działają z pewnym stopniem autonomii, wykonując zadania takie jak optymalizacja łańcuchów dostaw, zarządzanie dystrybucją energii w inteligentnych sieciach, koordynacja sieci transportowych czy automatyzacja handlu w DeFi. Agenci odnajdują się i negocjują między sobą za pośrednictwem Open Economic Framework, tworząc gospodarkę maszyna–maszyna.

CEO Humayun Sheikh kieruje zespołem, który wyobraża sobie systemy oparte na AI przełamujące monopol danych posiadanych przez wielkie firmy technologiczne. Poprzez dystrybucję możliwości AI w zdecentralizowanej sieci, Fetch.ai pozycjonuje się jako infrastruktura dla „gospodarki agentów” – przyszłości, w której autonomiczni agenci reprezentują jednostki i urządzenia w niezliczonych mikrotransakcjach i zadaniach koordynacyjnych.

Utility of FET

Token FET pełni rolę głównego medium wymiany w ekosystemie Fetch.ai.

Gdy dwa agenty łączą się, komunikują i negocjują, jeden płaci drugiemu za dane lub usługi przy użyciu FET. Co istotne, token obsługuje mikropłatności o wartości ułamków centa, umożliwiając granularne transakcje wymagane w gospodarce maszyna–maszyna.

FET pełni kilka konkretnych funkcji. Opłaca opłaty transakcyjne w sieci oraz wdrażanie usług AI. Deweloperzy budujący autonomicznych agentów płacą w FET za dostęp do narzędzi uczenia maszynowego i zasobów obliczeniowych sieci. Użytkownicy mogą stakować FET, aby uczestniczyć w zabezpieczaniu sieci poprzez mechanizm konsensusu Proof-of-Stake Fetch.ai, zdobywając nagrody za wkład w węzły walidacyjne.

Agenci muszą także zdeponować FET, aby zarejestrować się w sieci, tworząc wymóg stakingu, który finansuje ich prawo do działania. Mechanizm depozytu zapewnia, że agenci mają ekonomiczną „skórę w grze”, ograniczając spam i zachęcając do wartościowych kontrybucji.

Tokenomics and Structure

FET istnieje w wielu formach na różnych blockchainach. Pierwotnie uruchomiony jako token ERC-20 na Ethereum, Fetch.ai później wdrożył własny mainnet zbudowany w ekosystemie Cosmos. Użytkownicy mogą mostkować między wersją natywną a formatem ERC-20, przy czym wybór wpływa na opłaty transakcyjne i kompatybilność z różnymi ekosystemami DeFi.

Maksymalna podaż wynosi około 1 miliard tokenów FET, choć dokładny podział i harmonogramy uwalniania różnią się.

Token działa zarówno na Ethereum (dla kompatybilności ERC-20), jak i na Binance Smart Chain (jako token BEP-20), z mostem 1:1, który pozwala użytkownikom wymieniać tokeny między sieciami w zależności od potrzeb.

Fetch.ai jest częścią Artificial Superintelligence Alliance, współpracy z SingularityNET i Ocean Protocol ogłoszonej w 2024 r. Sojusz ma na celu stworzenie zjednoczonego, zdecentralizowanego ekosystemu AI z łączną kapitalizacją rynkową celującą w status top-20 kryptowalut.

Posiadacze tokenów AGIX i OCEAN mogą wymieniać je na FET, potencjalnie konsolidując płynność i wysiłki deweloperskie w ramach projektów.

Use Cases

Zastosowania Fetch.ai obejmują wiele sektorów. W inteligentnych miastach agenci koordynują parkowanie i ruch uliczny. Pilotaż w Cambridge pokazał, że agenci autonomicznie znajdują miejsca parkingowe, licytują o miejsca i przetwarzają płatności w czasie rzeczywistym. Dodanie ride-hailingu pozwala sieci wysyłać pojazdy w oparciu o wzorce popytu.

Rynki energii stanowią kolejny istotny przypadek użycia.

Właściciele domów z instalacjami fotowoltaicznymi wdrażają agentów, którzy handlują nadwyżkami energii bezpośrednio z sąsiadami, z pominięciem scentralizowanych zakładów energetycznych. Agenci negocjują ceny, weryfikują transakcje i rozliczają płatności w FET, tworząc peer‑to‑peer rynek energii.

W logistyce i łańcuchach dostaw agenci optymalizują trasy, zarządzanie zapasami i dobór przewoźników.

Przedsiębiorstwo może wdrożyć agenta, który odnajduje dostawców w sieci, negocjuje warunki, porównuje ceny, sprawdza oceny jakości, składa zamówienia, organizuje wysyłkę i obsługuje płatności – wszystko autonomicznie, na podstawie z góry zdefiniowanych parametrów.

Automatyzacja DeFi wykazuje duży potencjał. Agenci mogą realizować złożone strategie handlowe, optymalizować dostarczanie płynności w różnych protokołach i zarządzać pozycjami zabezpieczeń na rynkach pożyczkowych. W połowie 2025 r. agent wspierany przez Fetch.ai wygrał hackathon UC Berkeley dotyczący koordynacji ruchu lotniczego, demonstrując możliwości w alokacji slotów lotów, zarządzaniu opóźnieniami i negocjowaniu stref zatłoczenia przez autonomicznych agentów pracujących na danych w czasie rzeczywistym.

Partnerstwo z Interactive Strength (TRNR) stworzyło inteligentnych agentów‑trenerów fitness, którzy analizują dane dotyczące wydajności, sugerują spersonalizowaneworkouts and negotiate training plans with users, all settled via FET payments.

Competitive Landscape and Risk

Fetch.ai konkuruje z innymi protokołami skoncentrowanymi na agentach, takimi jak Autonolas (OLAS), który oferuje accelerator program for autonomous agents. Virtuals Protocol pojawił się pod koniec 2024 roku jako główny konkurent, budując launchpad agentów AI na Base i Solanie z własnym ekosystemem tokenizowanych agentów.

Szersze zagrożenie konkurencyjne pochodzi od scentralizowanych platform AI.

Google, Amazon i Microsoft oferują zaawansowane usługi AI poprzez swoje platformy chmurowe, nie wymagając od użytkowników posiadania własnych tokenów.

Aby Fetch.ai odniosło sukces, zdecentralizowany model agentów musi oferować wyraźne korzyści – ochronę prywatności, odporność na cenzurę, bezpośrednią koordynację peer‑to‑peer – które uzasadnią złożoność związaną z zarządzaniem aktywami kryptowalutowymi.

Niepewność regulacyjna stanowi ryzyko. Systemy AI działające autonomicznie mogą zostać poddane kontroli w ramach nowych regulacji. The EU AI Act's risk-based approach może sklasyfikować agentów Fetch.ai jako „wysokiego ryzyka” w sektorach takich jak energetyka czy logistyka, co wymagałoby audytów i nadzoru podnoszących koszty operacyjne.

Sceptycyzm wobec narracji gospodarki agentów utrzymuje się.

Krytycy kwestionują, czy autonomiczni agenci zyskają masową adopcję, czy pozostaną niszową ciekawostką techniczną. Jeśli gospodarka machine‑to‑machine nie zmaterializuje się na szeroką skalę, FET staje się rozwiązaniem szukającym problemu.

12 listopada 2025 r. FET był notowany w okolicach 0,25–0,30 USD, po okresie znaczącej zmienności w ciągu roku. Token zyskał uwagę, gdy Interactive Strength announced plany utworzenia skarbca kryptowalutowego o wartości 500 mln USD opartego na FET, co sygnalizowało instytucjonalną wiarę w długoterminowy potencjał projektu.

Analitycy przewidują price targets of $6.71 by 2030, choć takie prognozy obarczone są znaczną niepewnością. Kluczowe pytanie brzmi, czy koordynacja oparta na agentach oferuje na tyle dużą wartość, by uzasadnić obecną tokenomikę, czy też zwyciężą prostsze, scentralizowane alternatywy.

Niedawne wydarzenia napawają optymizmem. Fetch.ai launched a $10 million accelerator na początku 2025 r., aby inwestować w startupy budujące na jego infrastrukturze. To sygnalizuje zaangażowanie w rozwój ekosystemu wykraczające poza spekulacyjny handel.

Token 3: Render Token (RNDR) Deep Dive

What Render Network Is

Render Network is a decentralized GPU rendering platform, która łączy twórców potrzebujących mocy obliczeniowej z osobami i organizacjami oferującymi niewykorzystane zasoby GPU. Pierwotnie pomyślana w 2009 r. przez CEO OTOY Julesa Urbacha i launched publicly in April 2020, Render rozwinął się w wiodącą zdecentralizowaną fizyczną sieć infrastruktury (DePIN) dla zadań graficznych i AI.

Sieć działa jako rynek peer‑to‑peer. Twórcy przesyłają do sieci zlecenia renderingu – grafikę 3D, efekty wizualne, wizualizacje architektoniczne, inferencję AI.

Operatorzy węzłów z wolną mocą GPU podejmują się zadań i przetwarzają je w zamian za tokeny RNDR. Platforma wykorzystuje OTOY's industry-leading OctaneRender software, zapewniając profesjonalnej klasy możliwości renderingu poprzez rozproszoną infrastrukturę.

Render Network rozwiązuje podstawową barierę: rendering wysokiej jakości wymaga ogromnej mocy GPU, tymczasem scentralizowane usługi chmurowe są drogie i mogą nie mieć wystarczającej przepustowości w okresach szczytowego zapotrzebowania. Dzięki agregacji underutilized GPUs globally Render demokratyzuje dostęp do profesjonalnych narzędzi renderujących za ułamek tradycyjnych kosztów.

Utility Token RNDR

Token RNDR (obecnie RENDER po migracji na Solanę) pełni funkcję network's native utility token. Twórcy płacą za usługi renderingu w RENDER, przy czym koszt zależy od wymaganej mocy GPU, mierzonej w OctaneBench (OBH) – znormalizowanej jednostce opracowanej przez OTOY do kwantyfikacji mocy renderowania.

Operatorzy węzłów earn RENDER for completing jobs.

Sieć wdrożyła warstwowy system reputacji: Tier 1 (Trusted Partners), Tier 2 (Priority) i Tier 3 (Economy). Operatorzy węzłów z wyższego poziomu pobierają wyższe stawki, ale oferują gwarantowaną niezawodność. Wyniki reputacyjne twórców wpływają na szybkość przydziału zleceń – ci z dobrą historią korzystania z sieci szybciej uzyskują dostęp do zasobów.

Governance rights accompany RENDER tokens. Posiadacze głosują nad aktualizacjami sieci, zmianami protokołu i propozycjami finansowania poprzez Render DAO. Taka zdecentralizowana governance zapewnia, że kierunek rozwoju sieci wyznacza społeczność, a nie wyłącznie scentralizowana fundacja.

The Burn-and-Mint Equilibrium mechanism, wdrożony w styczniu 2023 r., dynamicznie zarządza podażą tokenów. Gdy twórcy płacą za rendering, 95% tokenów jest spalanych, czyli usuwanych z obiegu. Operatorzy węzłów otrzymują nowo wybite tokeny, aby utrzymać równowagę ekonomiczną. Ten mechanizm sprawia, że RENDER może być deflacyjny w miarę wzrostu wykorzystania sieci, ponieważ tempo spalania może przewyższyć tempo emisji, jeśli popyt jest wysoki.

Tokenomics

RENDER migrował z Ethereum na Solanę pod koniec 2023 r. po community vote. Celem tej zmiany było wykorzystanie szybszych transakcji i niższych opłat oferowanych przez Solanę. Oryginalny RNDR (token ERC‑20) na Ethereum został zaktualizowany do RENDER (token SPL) na Solanie. The total supply is capped at 644,168,762 tokens, z approximately 517 million in circulation na rok 2025.

Dystrybucja tokenów przeznaczyła 25% na sprzedaż publiczną, 10% na rezerwy oraz 65% w depozycie escrow, aby modulate supply-demand flows. Ta rezerwa pozwala fundacji zarządzać dostępnością tokenów w miarę skalowania się sieci.

Use Cases

Render Network obsługuje wiele branż. Firmy produkujące filmy i programy telewizyjne wykorzystują sieć do renderowania efektów wizualnych. Główne studia have rendered projects using decentralized nodes, co pokazuje zdolność systemu do obsługi profesjonalnych procesów z szyfrowaniem end‑to‑end chroniącym własność intelektualną.

Twórcy gier wykorzystują Render do 3D asset creation and real-time rendering.

Projekty metaverse polegają na sieci przy generowaniu immersyjnych środowisk i grafik awatarów. Skalowalność rozproszonej mocy GPU pozwala twórcom dynamicznie uruchamiać zasoby renderujące bez inwestowania w drogi lokalny sprzęt.

Architekci i projektanci produktów korzystają z Render do high-quality 3D visualizations. Firmy architektoniczne tworzą wirtualne spacery po budynkach przed rozpoczęciem budowy. Projektanci produktów prototypują na dużą skalę, testując tekstury i kolory dzięki zrównoleglonemu renderowaniu na GPU.

Inferencja AI staje się rosnącym przypadkiem użycia.

In July 2025, Render onboarded NVIDIA RTX 5090 GPUs specjalnie do zadań obliczeniowych AI w Stanach Zjednoczonych. Trenowanie niektórych modeli AI, szczególnie związanych z generowaniem obrazów lub wideo, korzysta z rozproszonej mocy GPU. Infrastruktura sieci może accelerate AI training znacząco w porównaniu z pojedynczymi maszynami.

Competitive Dynamics

Render konkuruje zarówno z dostawcami scentralizowanymi, jak i zdecentralizowanymi. Tradycyjne usługi chmury GPU od AWS, Google Cloud i wyspecjalizowanych dostawców, takich jak CoreWeave, oferują proste interfejsy i wiarygodne SLA. Jednak pobierają one wysokie opłaty i mogą mieć ograniczoną przepustowość w okresach zwiększonego popytu.

W przestrzeni zdecentralizowanej konkurenci to m.in. Akash Network (AKT), io.net (IO) i Aethir. Każda platforma w inny sposób podchodzi do koordynacji rynku GPU – Akash koncentruje się na szerszej infrastrukturze chmurowej, io.net podkreśla zastosowania AI/ML, Aethir celuje w gaming i rozrywkę. Render wyróżnia się integration with OTOY's professional rendering software oraz ugruntowaną reputacją wśród profesjonalistów kreatywnych.

Pytanie o przechwytywanie wartości pozostaje otwarte. Moc obliczeniowa GPU staje się coraz bardziej skomodytyzowana wraz z pojawianiem się kolejnych dostawców.

Render musi pokazać, że jego zdecentralizowany model oferuje wyraźne przewagi – efektywność kosztową, globalną dostępność, odporność na cenzurę – które uzasadniają korzystanie z tokenów kryptowalutowych zamiast kart kredytowych u scentralizowanych dostawców.

Partnerstwa z dużymi firmami zapewniają weryfikację rynkową. Ari Emanuel (Co-CEO of Endeavor) has publicly supported Render Network, podpisując umowy z Disneyem, HBO, Facebookiem i Unity. Te partnerstwa sygnalizują uznanie głównego nurtu, choć przekształcenie relacji w stałe wykorzystanie sieci pozostaje wyzwaniem.wyzwanie.

12 listopada 2025 r. RENDER był notowany w okolicach 4,50–5,00 USD, przy kapitalizacji rynkowej bliskiej 2,5–3 mld USD. Token doświadczył znacznego wzrostu w 2024 r., rosnąc o ponad 13 300% względem ceny początkowej na początku 2024 r., choć później wszedł w fazę konsolidacji. Analitycy przypisują to narracjom związanym ze sztuczną inteligencją oraz GPU/NVIDIĄ, przy czym partnerstwo z Apple dodatkowo zwiększyło wiarygodność projektu.

Ryzyka obejmują konkurencję ze strony scentralizowanych dostawców skalujących się efektywniej, potencjalną centralizację sprzętu, ponieważ ekonomika „kopania” faworyzuje dużych operatorów, a także pytanie, czy zdecentralizowane rynki GPU osiągną trwałą adopcję, czy pozostaną rozwiązaniami niszowymi.

Analiza porównawcza: tokeny użytkowe vs. tokeny typu store-of-value

Tokeny AI-utility funkcjonują w oparciu o zupełnie inne założenia dotyczące wartości niż tokeny typu store-of-value, takie jak Bitcoin i Ethereum. Zrozumienie tych różnic uwidacznia zarówno szanse, jak i wyzwania stojące przed kategorią tokenów użytkowych.

Cel i czynniki popytu

Wartość Bitcoina wynika głównie z jego pozycjonowania jako cyfrowe złoto – rzadkiego, zdecentralizowanego magazynu wartości i zabezpieczenia przed inflacją monetarną. Limit 21 mln BTC oraz kapitalizacja rynkowa przekraczająca 2 bln USD czynią z niego aktywo o znaczeniu makroekonomicznym. Ethereum dodaje warstwę programowalności, czerpiąc wartość z roli warstwy rozliczeniowej dla protokołów DeFi, NFT i innych aplikacji, przy czym popyt na ETH wynika z opłat za gas i wymogów stakingu.

Tokeny użytkowe, takie jak TAO, FET i RENDER, czerpią natomiast wartość z wykorzystania sieci. Popyt teoretycznie koreluje z liczbą przetworzonych zadań obliczeniowych, wdrożonych agentów i zrealizowanych zleceń renderingu. Więcej modeli AI trenowanych w Bittensor powinno zwiększać popyt na TAO jako dostęp do inteligencji. Większa liczba autonomicznych agentów w Fetch.ai powinna napędzać transakcje FET. Więcej zleceń renderingu powinno skutkować większym spalaniem tokenów RENDER.

Tokenomika i zarządzanie

Tokeny typu store-of-value kładą nacisk na rzadkość. Stała podaż i cykle halvingu Bitcoina tworzą przewidywalne zmniejszanie emisji. Ethereum przeszło na Proof-of-Stake, a EIP‑1559 wprowadził spalanie opłat transakcyjnych, co przy wysokim wykorzystaniu sieci wywołuje presję deflacyjną.

Tokeny użytkowe stosują zróżnicowane podejścia. Bittensor naśladuje model halvingu Bitcoina, tworząc niedobór. Równowaga Burn-and-Mint w Render wiąże podaż z użyciem – przy wysokim popycie spalanie przekracza emisję, zmniejszając ogólną podaż. Fetch.ai utrzymuje stałą podaż, ale wykorzystuje zachęty stakingowe do ograniczenia szybkości obiegu.

Zarządzanie znacząco się różni. Bitcoin utrzymuje konserwatywne podejście rozwojowe z minimalnymi zmianami w protokole.

Ethereum korzysta z koordynacji off-chain i osiągania „szorstkiego konsensusu” w czasie. Tokeny użytkowe często implementują bezpośrednie zarządzanie on-chain, w którym posiadacze tokenów głosują nad aktualizacjami protokołu, propozycjami finansowania i zmianami parametrów, dając społecznościom bardziej aktywną rolę w zarządzaniu.

Ścieżki adopcji i baza użytkowników

Tokeny typu store-of-value są skierowane do inwestorów szukających ekspozycji na aktywa kryptowalutowe lub zabezpieczenia przed tradycyjnymi finansami. Bitcoin przemawia do osób wierzących w zasady „sound money”. Ethereum przyciąga deweloperów i użytkowników korzystających z DeFi i aplikacji Web3.

Tokeny użytkowe muszą przyciągnąć określone typy użytkowników. Bittensor potrzebuje badaczy AI i data scientistów wybierających zdecentralizowane trenowanie modeli zamiast ugruntowanych frameworków. Fetch.ai wymaga deweloperów budujących autonomicznych agentów do zastosowań w świecie rzeczywistym. Render potrzebuje profesjonalistów kreatywnych, którzy zaufają zdecentralizowanej infrastrukturze w procesach produkcyjnych.

Te bariery adopcji są wyższe. Deweloperzy mierzą się z kosztami zmiany dotychczasowych narzędzi. Przedsiębiorstwa wymagają niezawodności i wsparcia, z którymi młode sieci zdecentralizowane mogą mieć problem. Tokeny użytkowe muszą wykazać wyraźne przewagi – kosztowe, wydajnościowe lub funkcjonalne – aby przełamać inercję.

Mechanizmy przechwytywania wartości

Tokeny typu store-of-value przechwytują wartość poprzez rzadkość i efekty sieciowe.

W miarę jak coraz więcej uczestników uznaje Bitcoina za magazyn wartości, popyt rośnie przy stałej podaży, co wywiera presję na wzrost cen. Ta spekulacyjna pętla wzmacnia się sama, choć generuje też zmienność.

Tokeny użytkowe stają przed problemem szybkości obiegu. Jeżeli użytkownicy natychmiast wymieniają zdobyte tokeny na fiat lub inne kryptowaluty, wysoka prędkość obiegu utrudnia akumulację wartości. Równanie wymiany (M×V = P×Q) sugeruje, że przy danym wolumenie transakcji (P×Q) wyższa prędkość (V) oznacza niższą kapitalizację rynkową (M).

Protokoły łagodzą problem szybkości obiegu różnymi mechanizmami. Wymogi stakingu zamrażają tokeny, zmniejszając podaż w obiegu. Bittensor wymaga od walidatorów stakowania TAO. Fetch.ai nagradza stakerów opłatami sieciowymi. Mechanizmy spalania, jak w Render, usuwają tokeny z obiegu na stałe. Prawa zarządcze tworzą zachęty do utrzymywania tokenów dla siły głosu.

Wyniki rynkowe i trajektorie

Bitcoin osiągnął w 2025 r. historyczne maksima powyżej 126 000 USD, kontynuując swoją trajektorię jako aktywo makro. Ethereum odrobiło straty po spadkach z okresu po 2022 r., utrzymując pozycję głównej platformy smart kontraktów.

Tokeny AI-utility charakteryzowały się większą zmiennością. TAO był notowany w przedziale 200–750 USD w latach 2024–2025, przy kapitalizacji rynkowej sięgającej 3,7–4,1 mld USD na szczytach. FET doświadczył silnych ruchów, szczególnie w okresie ogłoszenia Artificial Superintelligence Alliance. RENDER zanotował eksplozywny wzrost w latach 2023–2024, po czym wszedł w konsolidację.

Tokeny te są wyceniane zarówno na bazie spekulacji, jak i fundamentów. Gdy narracje AI dominują w dyskursie kryptowalutowym, tokeny użytkowe zazwyczaj przewyższają rynek. W okresach dekoniunktury często radzą sobie gorzej niż Bitcoin i Ethereum, gdy inwestorzy uciekają do postrzeganych jako bezpieczniejsze aktywów.

Koegzystencja czy konkurencja?

Pytanie brzmi, czy tokeny użytkowe stanowią „następną falę”, czy też będą współistnieć jako kategoria komplementarna. Dowody sugerują, że bardziej prawdopodobna jest koegzystencja. Tokeny typu store-of-value pełnią odmienne funkcje niż tokeny operacyjne. Bitcoin działa jako cyfrowe złoto, Ethereum jako programowalna warstwa rozliczeniowa, natomiast tokeny użytkowe jako paliwo dla konkretnych aplikacji.

Sukces jednak nie jest gwarantowany. Większość tokenów użytkowych może się nie powieść, jeśli wykorzystanie sieci się nie zmaterializuje lub jeśli scentralizowane alternatywy okażą się lepsze. Kapitalizacja rynku AI‑crypto sięgnęła 24–27 mld USD w 2025 r., co jest wartością znaczną, choć nadal niewielką wobec samego Bitcoina przekraczającego 2 bln USD.

Prawdopodobnymi zwycięzcami będą projekty, które wykażą:

- trwałe wykorzystanie sieci rosnące niezależnie od spekulacji,

- wyraźne przewagi nad scentralizowanymi alternatywami,

- silne ekosystemy deweloperskie i adopcję korporacyjną,

- skuteczne ograniczanie szybkości obiegu poprzez staking lub spalanie,

- modele zarządzania równoważące decentralizację z efektywnością.

Ostatecznym testem będzie to, czy tokeny użytkowe staną się infrastrukturą dla obciążeń AI w skali masowej, czy też pozostaną niszowymi rozwiązaniami przyćmionymi przez scentralizowanych dostawców chmury.

Wycena, metryki adopcji i ryzyko narracyjne

Ocena tokenów użytkowych wymaga innych ram niż analiza aktywów typu store-of-value. Podczas gdy Bitcoina można wyceniać z użyciem modeli stock-to-flow lub jako cyfrowe złoto porównywalne do metali szlachetnych, tokeny użytkowe wymagają metryk opartych na wykorzystaniu.

Kluczowe metryki dla tokenów użytkowych

Statystyki wykorzystania sieci stanowią podstawę. W przypadku Bittensor istotne metryki obejmują:

- liczbę aktywnych subnetów i ich specjalizacje,

- godziny obliczeniowe poświęcone na trenowanie modeli,

- liczbę górników i walidatorów zabezpieczających sieć,

- wolumen transakcji przepływających przez protokół,

- liczbę udanych wdrożeń modeli obsługujących realne aplikacje.

Bittensor raportuje 128 aktywnych subnetów pod koniec 2025 r., co stanowi istotny wzrost względem wcześniejszych okresów. Ocena, czy subnety te generują rzeczywisty popyt, a nie wyłącznie aktywność spekulacyjną, wymaga jednak głębszej analizy.

Dla Fetch.ai kluczowe metryki obejmują:

- liczbę wdrożonych autonomicznych agentów,

- interakcje agent‑agent i wolumen transakcji,

- wdrożenia w realnym świecie w różnych branżach,

- partnerstwa z przedsiębiorstwami lub rządami,

- udział w stakingu i liczbę walidatorów.

Fetch.ai zaprezentował proof‑of‑concept m.in. w koordynacji parkowania, handlu energią i logistyce, ale wyzwaniem pozostaje przejście od pilotaży do szerokiej adopcji.

Dla Render Network kluczowe wskaźniki to:

- liczba zleceń renderingu przetwarzanych miesięcznie,

- liczba aktywnych operatorów węzłów dostarczających moc GPU,

- klienci korporacyjni korzystający z sieci w produkcyjnych workflow,

- tempo spalania w porównaniu do tempa emisji w modelu Burn‑and‑Mint Equilibrium,

- liczba godzin GPU wykorzystanych w zdecentralizowanej sieci.

Render pozyskał partnerstwa z dużymi studiami i obsługuje rzeczywiste obciążenia renderingu, co daje bardziej namacalne dowody wykorzystania niż w przypadku wielu innych tokenów użytkowych.

Szybkość obiegu tokena i metryki spalania

Token velocity mierzy, jak szybko tokeny krążą w gospodarce. Wysoka prędkość wskazuje, że użytkownicy natychmiast wydają lub wymieniają tokeny, co utrudnia akumulację wartości. Niska prędkość sugeruje, że tokeny są trzymane dłużej, potencjalnie jako magazyn wartości lub z myślą o…staking rewards.

Bitcoin wykazuje prędkość obiegu na poziomie 4,1%, Ethereum 3,6%, co wskazuje na dojrzałe aktywa, które są głównie przetrzymywane, a nie używane w transakcjach. Tokeny użytkowe zazwyczaj na początku cechują się wyższą prędkością obiegu, ponieważ użytkownicy otrzymują tokeny za pracę i natychmiast wymieniają je na stabilne waluty.

Mechanizmy spalania przeciwdziałają wysokiej prędkości obiegu. System Rendera spala 95% tokenów płatniczych przy każdej transakcji, usuwając je z podaży. Jeśli tempo spalania przewyższa tempo emisji, podaż w obiegu maleje, co potencjalnie wspiera wzrost ceny przy założeniu stałego popytu.

Ocena spalania wymaga przejrzystości. Projekty powinny publikować regularne raporty spalania pokazujące liczbę tokenów usuniętych z obiegu. Render udostępnia te dane, umożliwiając niezależną weryfikację deflacyjnych deklaracji.

Partnerstwa i integracje w świecie rzeczywistym

Adopcja korporacyjna sygnalizuje realną użyteczność. Pierwsze uruchomienie ETP Bittensora na SIX Swiss Exchange zapewnia dostęp inwestorom instytucjonalnym. Skarbiec FET o wartości 500 mln USD Interactive Strength pokazuje zaufanie korporacyjne. Partnerstwa Rendera z Disney, HBO i Unity potwierdzają możliwości platformy w zakresie produkcyjnych środowisk pracy.

Jednak same partnerstwa nie gwarantują trwałego wykorzystania. Wiele projektów blockchain ogłasza partnerstwa, które nie przekładają się na istotne przychody ani aktywność sieci. Śledzenie rzeczywistego wolumenu transakcji wynikającego z relacji z przedsiębiorstwami daje jaśniejszy obraz sytuacji.

Ryzyka narracyjne

Kilka ryzyk narracyjnych zagraża wycenom tokenów użytkowych:

Hype „AI + krypto” bez dostarczenia wyników: Konwergencja AI i blockchain tworzy silne narracje, ale jeśli zdecentralizowane systemy AI nie dorównają wydajnością scentralizowanym alternatywom, wyceny spadną. Większość ekspertów oczekuje, że jedynie wybrane projekty AI-krypto odniosą długoterminowy sukces, a wiele pozostanie czysto spekulacyjnych.

Moc obliczeniowa bez popytu: Budowa zdecentralizowanej infrastruktury GPU jest bez znaczenia, jeśli deweloperzy z niej nie korzystają. Jeśli użycie nie wyjdzie poza wczesnych użytkowników i entuzjastów, tokeny staną się rozwiązaniami szukającymi problemu. Pytanie brzmi, czy zdecentralizowana moc obliczeniowa może zdobyć istotny udział w rynku kosztem AWS, Google Cloud i innych scentralizowanych gigantów.

Zagrożenia regulacyjne: Rządy na całym świecie opracowują regulacje dotyczące AI. Ramowy, oparty na ryzyku model unijnej ustawy o AI (EU AI Act) może sklasyfikować niektóre systemy AI jako wysokiego ryzyka, wymagające audytów i nadzoru. Autonomiczni agenci podejmujący decyzje ekonomiczne mogą znaleźć się pod lupą regulatorów. Niepewność, czy tokeny użytkowe stanowią papiery wartościowe, zwiększa ryzyko regulacyjne.

Centralizacja sprzętowa: Zdecentralizowane sieci są zagrożone ponowną centralizacją. Jeśli kopanie lub prowadzenie węzłów opłaca się tylko dużym podmiotom z efektami skali, obietnica decentralizacji znika. Sieci GPU mogą skonsolidować się wokół dużych centrów danych, co podważy sens infrastruktury peer-to-peer.

Ograniczenia techniczne: Systemy zdecentralizowane mają wrodzone kompromisy. Koszty koordynacji, opóźnienia i obawy o niezawodność mogą uniemożliwić tokenom użytkowym konkurowanie z zoptymalizowanymi rozwiązaniami scentralizowanymi. Jeśli ograniczeń technicznych nie da się pokonać, adopcja wyhamuje.

Ramowe podejścia do wyceny

Tradycyjne modele finansowe słabo radzą sobie z tokenami użytkowymi. Zdyskontowane przepływy pieniężne (DCF) sprawdzają się dla tokenów z udziałem w zyskach — Augur płaci posiadaczom REP za pracę na rzecz sieci, tworząc strumienie przepływów pieniężnych nadające się do analizy DCF. Jednak czyste tokeny użytkowe bez dywidend nie mają oczywistych przepływów do zdyskontowania.

Równanie wymiany oferuje jedno z podejść: M×V = P×Q, gdzie M to kapitalizacja rynkowa (to, co chcemy obliczyć), V to prędkość obiegu, P to cena za transakcję, a Q to liczba transakcji. Po przekształceniu: M = P×Q / V. Oznacza to, że kapitalizacja rynkowa równa się wolumenowi transakcji podzielonemu przez prędkość obiegu.

Wyższy wolumen transakcji (P×Q) wspiera wyższe wyceny. Niższa prędkość obiegu (V) również wspiera wyższe wyceny. Projekty muszą albo zwiększać użycie, albo zmniejszać prędkość obiegu – najlepiej jedno i drugie. Staking zmniejsza prędkość; mechanizmy spalania zmniejszają podaż; realna użyteczność zwiększa wolumen transakcji.

Prawo Metcalfe’a sugeruje, że wartość sieci rośnie proporcjonalnie do kwadratu liczby użytkowników. Wraz z dołączaniem kolejnych uczestników do Bittensora, Fetch.ai czy Render, efekty sieciowe mogą napędzać wykładniczy wzrost wartości. Jednak prawo to zakłada, że wszystkie połączenia są wartościowe – co nie zawsze jest prawdą w przypadku sieci na wczesnym etapie.

Wycena porównawcza patrzy na podobne projekty. Jeśli Bittensor osiągnie podobny poziom wykorzystania sieci jak SingularityNET czy Ocean Protocol, porównanie kapitalizacji rynkowych daje przybliżone punkty odniesienia. Jednak unikalna tokenomika i przypadki użycia każdego projektu ograniczają użyteczność bezpośrednich porównań.

Ostatecznie wycena tokenów użytkowych pozostaje spekulacyjna. Dopóki sieci nie wykażą trwałego użycia niezależnego od spekulacji, ceny odzwierciedlają w równym stopniu siłę narracji i nastroje rynkowe, co wartość fundamentalną.

Co dalej: scenariusze na przyszłość

Trajektoria tokenów AI-utility zależy od kilku niepewnych zmiennych: tempa adopcji technologii, rozwoju regulacji, konkurencji ze strony scentralizowanych dostawców oraz zdolności tokenów do przechwytywania wartości z wykorzystania sieci. Trzy szerokie scenariusze ilustrują możliwe przyszłości.

Scenariusz najlepszy: tokeny infrastrukturalne stają się kluczową warstwą

W tym optymistycznym scenariuszu zdecentralizowana infrastruktura AI osiąga masową adopcję. Bittensor staje się preferowaną platformą do wspólnego trenowania modeli AI, przyciągając duże instytucje badawcze i przedsiębiorstwa. Architektura subnetów okazuje się lepsza od scentralizowanych frameworków w określonych zastosowaniach – w prywatnościowych systemach AI dla ochrony zdrowia, zdecentralizowanych rynkach modeli, crowdsourcingu inteligencji.

Autonomiczni agenci Fetch.ai rozprzestrzeniają się w wielu branżach. Inteligentne miasta wdrażają sieci agentów do koordynacji ruchu, dystrybucji energii i usług publicznych. Łańcuchy dostaw standaryzują się na optymalizacji opartej na agentach. Protokoły DeFi integrują agentów do automatycznej realizacji strategii. „Gospodarka agentowa” materializuje się zgodnie z prognozami, z miliardami mikrotransakcji koordynowanymi przez autonomiczne oprogramowanie.

Render Network zdobywa znaczący udział w rynku kosztem scentralizowanych dostawców GPU. Profesjonaliści kreatywni i badacze AI rutynowo używają zdecentralizowanej mocy obliczeniowej do produkcyjnych zadań. Globalny rynek cloud gamingu, którego wartość ma osiągnąć 121 mld USD do 2032 r., napędza popyt na rozproszoną infrastrukturę GPU.

W tym scenariuszu tokeny użytkowe zyskują trwałą wartość dzięki:

- Utrwalonemu wzrostowi wykorzystania: aktywność sieci rośnie niezależnie od spekulacji

- Ograniczaniu prędkości obiegu: staking, spalanie i zachęty związane z governance skłaniają do trzymania tokenów zamiast natychmiastowej sprzedaży

- Efektom sieciowym: im więcej użytkowników dołącza, tym bardziej wartościowe stają się platformy dla wszystkich uczestników

- Jasności regulacyjnej: powstają ramy, które godzą zdecentralizowaną AI z ochroną konsumentów

Ceny tokenów mogłyby osiągnąć optymistyczne prognozy analityków – TAO powyżej 1000 USD, FET zbliżający się do 6–10 USD, RENDER przekraczający 20 USD – jeśli fundamenty wykorzystania uzasadnią wyceny. Kapitalizacje rynkowe rosłyby proporcjonalnie, a czołowe tokeny AI-utility mogłyby osiągnąć 20–50 mld USD, przechwytując fragmenty bilionowych rynków AI i cloud computingu.

Dla inwestorów oznacza to istotną aprecjację względem obecnych poziomów. Dla deweloperów – potwierdzenie, że zdecentralizowana infrastruktura jest realną alternatywą dla scentralizowanych dostawców chmury. Dla rynku krypto – dowód, że tokeny użytkowe mogą ewoluować poza spekulację w kierunku funkcjonalnych aktywów infrastrukturalnych.

Also Read: Bitcoin Goes Below $67K After Trump Vows To Bomb Iran To 'Stone Ages'

Scenariusz bazowy: część tokenów odnosi sukces, wiele się wypłaszcza

Bardziej realistyczny scenariusz zakłada, że tylko podzbiór obecnych tokenów AI-utility osiągnie trwałą adopcję. Zwycięzcy wyróżniają się lepszą technologią, silnymi ekosystemami, realnymi partnerstwami i skutecznymi mechanizmami przechwytywania wartości. Większość projektów się wypłaszcza lub zanika, gdy użytkownicy dostrzegają ograniczoną praktyczną użyteczność.

W tym scenariuszu Bittensor, Fetch.ai i Render – jako wiodące projekty – mają lepsze szanse niż mniejsi konkurenci. Nawet one jednak stają przed wyzwaniami. Zdecentralizowana AI okazuje się wartościowa w określonych niszach — zastosowaniach krytycznych dla prywatności, sieciach odpornych na cenzurę, niektórych dziedzinach badań — ale nie wypiera scentralizowanych dostawców w większości przypadków użycia.

Tokeny pełniące funkcję magazynu wartości pozostają dominujące. Bitcoin umacnia swoją pozycję cyfrowego złota. Ethereum nadal działa jako główna warstwa rozliczeniowa dla zdecentralizowanych aplikacji. Tokeny AI-utility współistnieją jako infrastruktura dla wyspecjalizowanych zastosowań, a nie uniwersalne platformy ogólnego przeznaczenia.

Ceny tokenów odzwierciedlają umiarkowany wzrost wykorzystania. TAO może osiągnąć 500–800 USD, FET 2–4 USD, RENDER 8–12 USD w nadchodzących latach – to istotna aprecjacja, ale daleka od eksplodujących prognoz. Kapitalizacje rosną, lecz pozostają rzędy wielkości poniżej Bitcoina i Ethereum.

Ten scenariusz charakteryzują:

- Niszowa adopcja: tokeny użytkowe skutecznie obsługują określone branże lub przypadki użycia

- Konkurencja scentralizowana: AWS, Google Cloud i inni giganci utrzymują dominację w zakresie ogólnej mocy obliczeniowej

- Obciążenia regulacyjne: wymogi zgodności dodają tarcia zdecentralizowanym platformom

- Techniczne kompromisy: Systemy zdecentralizowane okazują się wolniejsze, bardziej złożone lub mniej niezawodne niż scentralizowane alternatywy w wielu zastosowaniach.

Dla inwestorów umiarkowany wzrost cen nagradza wczesnych zwolenników, ale wypada gorzej niż najbardziej bycze prognozy. Dla rynków krypto tokeny użytkowe zyskują legitymację jako odrębna kategoria aktywów, różna od tokenów typu store-of-value, lecz o bardziej umiarkowanych wycenach.

Negatywny scenariusz: Zastosowanie się nie materializuje

Pesymistyczny scenariusz zakłada, że tokeny użytkowe nie potrafią przełożyć swoich możliwości technicznych na trwały popyt. Pomimo imponującej infrastruktury użytkownicy nie migrują z ugruntowanych platform. Deweloperzy nadal używają TensorFlow, PyTorch i scentralizowanych usług chmurowych zamiast uczyć się nowych, zdecentralizowanych protokołów. Profesjonaliści kreatywni pozostają przy Adobe, Autodesk i tradycyjnych farmach renderujących, zamiast eksperymentować z alternatywami opartymi na krypto.

W tym scenariuszu tokeny AI-utility stają się przede wszystkim aktywami spekulacyjnymi. Ceny wahają się w oparciu o ogólny sentyment na rynku krypto i cykle „hype’u” wokół AI, a nie fundamentalne wykorzystanie. Gdy narracje słabną – jak stało się w przypadku wielu tokenów z ICO z lat 2017–2018 – wyceny się załamują.

Do takiego rezultatu może prowadzić kilka dynamik:

- Frykcja w doświadczeniu użytkownika: Zarządzanie portfelami, płacenie opłat za gas i poruszanie się po zdecentralizowanych protokołach okazuje się zbyt uciążliwe dla masowych użytkowników

- Luki wydajnościowe: Scentralizowane alternatywy pozostają szybsze, bardziej niezawodne i bogatsze w funkcje niż opcje zdecentralizowane

- Opłacalność ekonomiczna: Tokenomika nie potrafi właściwie zestroić bodźców, co prowadzi do rotacji dostawców, problemów z jakością lub niestabilności sieci

- Represje regulacyjne: Rządy klasyfikują tokeny użytkowe jako papiery wartościowe lub zakazują określonych zastosowań, ograniczając legalne użycie

Ceny tokenów wróciłyby do spekulacyjnych minimów. TAO mógłby spaść poniżej 200 USD, FET poniżej 0,50 USD, RENDER poniżej 3 USD, gdy inwestorzy uświadomią sobie brak fundamentalnego popytu. Projekty mogłyby przetrwać dzięki oddanym społecznościom, ale nie osiągnęłyby znaczącej skali.

Ten scenariusz stanowi egzystencjalne ryzyko dla kategorii tokenów użytkowych. Jeżeli wiodące projekty z dużym finansowaniem, utalentowanymi zespołami i realnymi partnerstwami nie potrafią wykazać dopasowania produktu do rynku, sugeruje to, że zdecentralizowany model AI/obliczeń zasadniczo nie działa w dużej skali.

Also Read: Dogecoin Drops Below $0.089 On Bearish Signals

Implikacje w różnych scenariuszach

Dla inwestorów: Profile ryzyka i zwrotu drastycznie różnią się między scenariuszami. Najlepszy przypadek oferuje wielokrotne pomnożenie kapitału, ale wymaga, by kilka niepewnych czynników rozstrzygnęło się pomyślnie. Scenariusz bazowy zapewnia umiarkowany wzrost przy mniejszym ryzyku. Negatywny wariant oznacza znaczące straty.

Budowa portfela powinna uwzględniać prawdopodobieństwa scenariuszy. Przeznaczenie niewielkich procentów portfela na tokeny użytkowe zapewnia asymetryczny potencjał wzrostu, jeśli zmaterializuje się najlepszy przypadek, jednocześnie ograniczając narażenie na spadki. Koncentracja na tokenach użytkowych kosztem aktywów typu store-of-value zwiększa zmienność i ryzyko.

Dla deweloperów: Budowanie na platformach tokenów użytkowych wymaga oceny ich długoterminowej żywotności. Jeśli zrealizują się scenariusz bazowy lub negatywny, aplikacje oparte na tych platformach mogą mieć trudności ze znalezieniem użytkowników lub finansowania. Deweloperzy powinni zachować opcjonalność — projektując aplikacje przenośne między platformami lub zdolne do działania z wykorzystaniem scentralizowanych backendów, jeśli zdecentralizowana infrastruktura okaże się niewystarczająca.

Dla struktury rynku krypto: Sukces lub porażka tokenów użytkowych kształtuje ewolucję krypto. Jeśli zrealizuje się najlepszy scenariusz, krypto wykracza poza store-of-value i DeFi, stając się realną infrastrukturą. Jeśli nastąpi scenariusz negatywny, krypto pozostanie przede wszystkim domeną spekulacji i finansów.

Na co zwracać uwagę

Kilka wskaźników pomoże wyjaśnić, który scenariusz się zrealizuje:

Liczba węzłów i uczestnictwo: Rosnąca liczba górników, walidatorów i dostawców GPU sygnalizuje autentyczne efekty sieciowe. Stagnacja lub spadek uczestnictwa sugeruje brak opłacalności ekonomicznej.

Liczba przetworzonych zadań obliczeniowych: Rzeczywiste zlecenia renderowania, przebiegi treningu AI i interakcje agentów — a nie tylko aktywność w testnecie — dowodzą realnego popytu. Projekty powinny publikować przejrzyste statystyki użycia.

Partnerstwa z przedsiębiorstwami: Przekucie ogłoszonych partnerstw w mierzalną liczbę transakcji potwierdza modele biznesowe. Partnerstwa bez towarzyszącego im użycia mogą wskazywać na „vaporware”.

Spalanie tokenów i staking: W projektach ze mechanizmami spalania, tempo spalania przewyższające tempo emisji wskazuje na silny popyt. Wysokie uczestnictwo w stakingu zmniejsza prędkość obrotu tokenem i świadczy o zaufaniu długoterminowych posiadaczy.

Aktywność deweloperska: Rozwijające się ekosystemy deweloperskie — mierzone liczbą commitów na GitHubie, nowych protokołów budowanych na platformach, udziałem w hackathonach — sygnalizują zdrowe fundamenty. Spadek zainteresowania deweloperów zapowiada stagnację.

Jasność regulacyjna: Bardziej przejrzyste ramy dotyczące tokenów użytkowych, systemów AI i zdecentralizowanej infrastruktury zmniejszają niepewność. Sprzyjające regulacje przyspieszają adopcję; restrykcyjne ją hamują.

Ekosystemy sprzętowe: Integracja z głównymi producentami GPU lub dostawcami chmury legitymizuje zdecentralizowane obliczenia. Partnerstwa lub oficjalne uznanie platform tokenów użytkowych przez Nvidię, AMD i innych stanowiłyby sygnał walidacji przez mainstream.

Śledzenie tych metryk w latach 2025–2027 pokaże, czy tokeny AI-utility stanowią rzeczywistą innowację infrastrukturalną, czy głównie spekulacyjne instrumenty. Ta różnica przesądzi, czy aktywa te zyskają trwałe znaczenie na rynkach krypto, czy też znikną jako kolejny zakończony cykl narracyjny.

Ostatnie przemyślenia

Tokeny AI-utility stanowią istotną ewolucję w architektonicznej narracji krypto. Bittensor, Fetch.ai i Render Network pokazują, że tokeny mogą służyć czemuś więcej niż tylko store-of-value lub spekulacyjnemu handlowi — mogą koordynować zdecentralizowaną infrastrukturę, wynagradzać pracę obliczeniową i umożliwiać gospodarki machine-to-machine.

Fundamentalna teza jest przekonująca.

Zdecentralizowane sieci GPU agregują niewykorzystane zasoby, obniżając koszty i demokratyzując dostęp. Autonomiczni agenci umożliwiają koordynację w skali niepraktycznej dla ludzkiej mediacji.

Kolektywny rozwój AI rozprasza proces tworzenia inteligencji poza monopole gigantów technologicznych. Te wizje odpowiadają na realne problemy skalowalności infrastruktury, dostępności AI i koordynacji ekonomicznej.

Jednak przełożenie wizji na trwałą adopcję pozostaje kluczowym wyzwaniem. Tokeny użytkowe muszą wykazać wyraźną przewagę nad scentralizowanymi alternatywami, jednocześnie pokonując wrodzone tarcia systemów zdecentralizowanych. Muszą przechwytywać wartość poprzez realne użycie, a nie spekulację, rozwiązać problem zbyt dużej prędkości obrotu dzięki skutecznej tokenomice oraz osiągnąć dopasowanie produktu do rynku wśród przedsiębiorstw i deweloperów.

Read Next: XRP Ledger Hits Record 4.49M Transactions Amid Price Decline