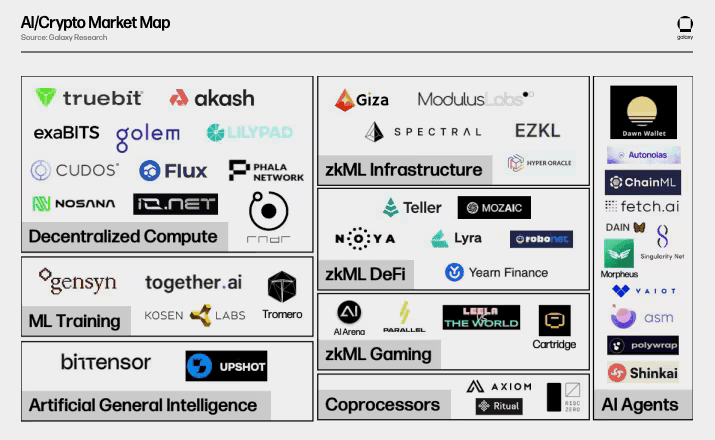

Esqueça memecoins e ciclos de hype — tokens de utilidade em IA são uma nova categoria de cripto ganhando espaço e, desta vez, eles realmente fazem algo.

Eles estão construindo silenciosamente a ponte entre blockchain e a imensa maquinaria computacional que alimenta a inteligência artificial. E conforme a IA invade tudo, de escrever roteiros a projetar moléculas, esses tokens evoluem junto — deixando de ser apenas fichas especulativas em uma mesa de cassino para se tornarem ferramentas reais que mantêm redes descentralizadas funcionando.

Três projetos estão na vanguarda dessa mudança: Bittensor (TAO), Fetch.ai (FET) e Render Token (RNDR).

Bittensor opera uma rede de machine learning descentralizada em que participantes treinam modelos de IA de forma colaborativa e recebem recompensas. Fetch.ai implementa agentes econômicos autônomos que executam tarefas em cadeias de suprimento, mercados de energia e finanças descentralizadas. Render Network transforma poder de GPU ocioso em um mercado peer-to-peer para renderização 3D, efeitos visuais e inferência de IA.

Esses tokens representam mais do que inovação incremental.

Eles sinalizam uma potencial mudança arquitetônica na cripto, saindo das narrativas de “ouro digital” centradas em escassez e reserva de valor para ecossistemas orientados à utilidade, em que tokens viabilizam trabalho computacional real.

Enquanto o Bitcoin (BTC) e o Ethereum (ETH) se consolidaram por suas narrativas monetárias e de plataforma, tokens de utilidade em IA propõem uma tese de valor diferente: tokens como chaves de acesso a infraestrutura descentralizada, trilhos de pagamento para economias máquina-a-máquina e mecanismos de recompensa por recursos computacionais.

Aqui, vamos analisar por que esses tokens estão em alta agora, examinar seus modelos de utilidade e tokenomics, avaliar dinâmicas competitivas e riscos de narrativa, explorar estruturas de avaliação e considerar implicações mais amplas para a evolução de tokens de utilidade em relação a ativos de reserva de valor consolidados.

Por que tokens de utilidade, e por que agora

A convergência entre a aceleração da IA e a infraestrutura de blockchain criou condições ideais para adoção de tokens de utilidade. Vários macrofatores ajudam a explicar o momento atual.

Primeiro, a demanda por computação para IA explodiu.

Treinar modelos avançados de linguagem e gerar mídia sintética exige enormes recursos de GPU, criando gargalos em infraestrutura de nuvem centralizada. Provedores tradicionais como AWS e Google Cloud têm dificuldade em atender à demanda, com data centers operando em média com apenas 12–18% de utilização, enquanto a escassez de GPUs persiste. Esse desequilíbrio entre oferta e demanda elevou o custo de computação, tornando alternativas descentralizadas economicamente viáveis.

Segundo, ciclos anteriores de cripto focaram principalmente em protocolos DeFi e narrativas de reserva de valor. Mas em 2024–2025, infraestrutura e computação emergiram como tema dominante.

The total crypto market cap crossed $4 trillion in 2025, and within that growth, AI-crypto projects captured significant investor attention.

Projetos que oferecem infraestrutura tangível, em vez de apenas produtos financeiros, ganharam tração à medida que o mercado amadureceu.

Terceiro, a tokenização oferece vantagens únicas para coordenar recursos distribuídos.

Redes descentralizadas de GPU como a Render podem agregar poder de computação ocioso globalmente, gerando economias de custo de até 90% em comparação com alternativas centralizadas. Tokens fornecem a camada de coordenação econômica: criadores pagam por serviços de renderização em RNDR, operadores de nós recebem recompensas por contribuir com capacidade de GPU, e o protocolo mantém transparência via transações em blockchain.

Esse modelo de utilidade contrasta fortemente com tokens de reserva de valor. A proposta do Bitcoin se concentra na escassez de oferta fixa e em seu posicionamento como ouro digital. O Ethereum adiciona programabilidade, mas ainda extrai grande parte de seu valor por ser uma camada de liquidação e base para ativos. Tokens de utilidade como TAO, FET e RNDR derivam valor do uso da rede: mais modelos de IA treinados no Bittensor, mais agentes autônomos implantados na Fetch.ai, mais jobs de renderização processados na Render Network teoricamente se traduzem em maior demanda pelo token.

Essa guinada para a utilidade não é apenas narrativa. Render Network processa jobs de renderização para grandes estúdios usando nós descentralizados. Fetch.ai já demonstrou aplicações reais, incluindo coordenação autônoma de estacionamento em Cambridge e sistemas de negociação de energia. A arquitetura de sub-redes do Bittensor agora inclui 128 sub-redes ativas focadas em diferentes domínios de IA, de geração de texto a dobramento de proteínas.

No entanto, a adoção baseada em utilidade enfrenta desafios. A maior parte dos tokens ainda negocia principalmente com base em valor especulativo, e não em fundamentos de uso. A velocidade do token — quão rápido ele muda de mãos — pode minar a estabilidade de preço se usuários converterem recompensas imediatamente em outros ativos. A questão é se esses protocolos conseguirão gerar uso suficiente para sustentar suas valorações ou se permanecerão ativos guiados por narrativa, sujeitos a ciclos de hype.

Também leia: Bitcoin Decentralization Faces A Problem: Mining Power Tied To Just Three Nations

Token 1: Bittensor (TAO) em detalhe

O que é o Bittensor

Bittensor é um protocolo de código aberto que alimenta uma rede de machine learning descentralizada. Diferente do desenvolvimento tradicional de IA, concentrado em laboratórios de grandes empresas de tecnologia, o Bittensor cria um marketplace peer‑to‑peer em que desenvolvedores contribuem com modelos de machine learning, validadores avaliam sua qualidade, e os contribuidores recebem recompensas com base no valor informacional que agregam à inteligência coletiva.

O protocolo foi fundado por Jacob Steeves e Ala Shaabana, pesquisadores de ciência da computação que lançaram a rede para democratizar o desenvolvimento de IA. A visão é ambiciosa: criar um mercado de inteligência artificial em que produtores e consumidores interajam em um contexto sem confiança, transparente e sem intermediários centralizados.

Utilidade e mecânica

O token TAO exerce múltiplas funções no ecossistema. De forma mais básica, TAO concede acesso à inteligência coletiva da rede. Usuários extraem informações de modelos treinados pagando em TAO, enquanto contribuidores que agregam valor à rede acumulam mais participação. Isso cria uma estrutura de incentivos em que contribuições de modelos de alta qualidade recebem recompensas maiores.

A rede opera com uma arquitetura de sub-redes. Cada sub-rede se especializa em diferentes tarefas de IA — processamento de linguagem natural, reconhecimento de imagem, previsão de dados — e usa sua própria lógica de avaliação. Modelos competem dentro das sub-redes com base em acurácia e eficiência. Validadores fazem stake de TAO para avaliar saídas de modelos e garantir pontuações justas. Nominadores apoiam validadores ou sub-redes específicos e participam das recompensas, de forma semelhante a sistemas de prova de participação delegada.

Esse design modular permite que o Bittensor escale simultaneamente por inúmeros domínios de IA. Em vez de uma rede monolítica, o protocolo funciona como infraestrutura para marketplaces de IA especializados, cada um com critérios de avaliação e distribuições de recompensas próprios.

Tokenomics

A tokenomics do Bittensor espelha o modelo de escassez do Bitcoin. TAO tem oferta fixa de 21 milhões de tokens, com emissão seguindo um cronograma de halving. O primeiro halving ocorreu em 2025, reduzindo a emissão diária de 7.200 para 3.600 tokens. Esse mecanismo deflacionário cria escassez de oferta semelhante aos ciclos de quatro anos do Bitcoin.

Atualmente, cerca de 9,6 milhões de TAO estão em circulação, representando aproximadamente 46% da oferta total. A oferta circulante continuará crescendo, mas em ritmo decrescente devido aos halvings, com distribuição completa projetada para ocorrer ao longo de várias décadas.

Recompensas de mineração vão para contribuidores que de fato melhoram a inteligência da rede. Validadores recebem recompensas por avaliação precisa das contribuições de modelos. Essa estrutura dupla de recompensas incentiva tanto o desenvolvimento de modelos quanto a integridade da rede.

Casos de uso

As aplicações do Bittensor abrangem vários domínios. Aprendizado coletivo permite que instituições de saúde treinem modelos em dados médicos sensíveis sem compartilhar as informações brutas — já foi demonstrado em detecção de COVID‑19 a partir de radiografias de tórax com 90% de acurácia. Instituições financeiras podem treinar em conjunto modelos de detecção de fraude mantendo seus dados proprietários privados.

A estrutura de sub-redes possibilita serviços de IA especializados. Sub-redes de geração de texto competem para produzir saídas de linguagem de alta qualidade. Mercados de previsão se valem das capacidades de inferência do Bittensor. Serviços de embeddings processam e codificam dados para aplicações posteriores. Cada sub-rede opera de forma autônoma, ao mesmo tempo em que contribui para o mercado mais amplo de inteligência.

A adoção por empresas ainda é incipiente, mas crescente. Deutsche Digital Assets e Safello lançaram o primeiro ETP de Bittensor fisicamente lastreado do mundo na SIX Swiss Exchange em novembro de 2025, oferecendo a investidores institucionais exposição regulada ao TAO. Esse desenvolvimento sinaliza um interesse em amadurecimento, indo além da especulação de varejo.

Concorrência e Ecossistema

A Bittensor compete no espaço de IA descentralizada com projetos como SingularityNET (AGIX) e Ocean Protocol (OCEAN). A SingularityNET opera um mercado de IA onde desenvolvedores monetizam algoritmos e serviços. A Ocean foca em mercados de dados e aplicações de compute-to-data. Cada projeto aborda a IA descentralizada de forma diferente – Bittensor enfatiza o treinamento colaborativo de modelos, SingularityNET se concentra em marketplaces de serviços, Ocean prioriza ativos de dados.

No entanto, a maior ameaça competitiva vem dos gigantes centralizados de IA. OpenAI, Google DeepMind e Anthropic detêm recursos massivos, conjuntos de dados proprietários e talentos de ponta. Essas entidades podem iterar mais rápido e implantar modelos mais capazes do que as alternativas descentralizadas atualmente conseguem. A Bittensor precisa demonstrar que sua abordagem colaborativa produz modelos competitivos com as alternativas centralizadas, não apenas filosoficamente atraentes, mas tecnicamente superiores para casos de uso específicos.

A atualização de smart contracts WebAssembly (WASM) da rede em 2025 expandiu a funcionalidade, viabilizando recursos como empréstimos, negociação automatizada de tokens de sub-redes e aplicações entre sub-redes. Esse desenvolvimento de infraestrutura busca criar uma economia digital mais abrangente, além do puro treinamento de modelos.

Risco de Narrativa e Avaliação

A avaliação da Bittensor enfrenta várias tensões. Em 12 de novembro de 2025, TAO era negociado em torno de US$ 362–390, com capitalização de mercado próxima de US$ 3,7–4,1 bilhões. O token atingiu máximas acima de US$ 400 no início de 2025, mas passou por volatilidade típica de criptoativos.

Os defensores apontam diversos vetores de crescimento.

O mecanismo de halving cria pressão deflacionária, potencialmente sustentando a valorização do preço se a demanda permanecer estável. Analistas projetam alvos que variam de US$ 360–500 em 2026 a previsões mais agressivas que superam US$ 1.000 entre 2027–2030, embora essas projeções carreguem incerteza significativa.

A questão fundamental é se o uso da rede justifica a avaliação.

A teoria da velocidade do token sugere que tokens de utilidade usados principalmente para transações têm dificuldade em manter valor porque os usuários convertem rapidamente as recompensas em outros ativos.

A Bittensor mitiga isso por meio de staking – validadores precisam travar TAO para participar do consenso da rede, reduzindo a oferta em circulação e a velocidade.

Porém, se a Bittensor não conseguir atrair cargas de trabalho significativas de IA além de sua atividade atual de sub-redes, o token se torna primariamente especulativo. O protocolo precisa demonstrar que o treinamento descentralizado de modelos oferece vantagens suficientemente fortes para justificar a migração de desenvolvedores a partir de frameworks consolidados como TensorFlow ou PyTorch combinados com computação centralizada.

Os riscos incluem concorrência tecnológica, incerteza regulatória em torno de sistemas de IA, possíveis vulnerabilidades de segurança no protocolo e o desafio de manter a descentralização à medida que a rede escala. A queda semanal recente de 20% destaca uma volatilidade persistente mesmo com o crescimento do interesse institucional mais amplo.

Token 2: Análise Detalhada de Fetch.ai (FET)

O que é Fetch.ai

A Fetch.ai é um ecossistema de blockchain que utiliza IA e automação para viabilizar agentes econômicos autônomos — entidades digitais que executam tarefas de forma independente em nome de usuários, dispositivos ou organizações.

Fundada em 2017 e lançada via IEO na Binance em março de 2019, a Fetch.ai busca democratizar o acesso à tecnologia de IA por meio de uma rede descentralizada.

O recurso definidor da plataforma são os Agentes Econômicos Autônomos (AEAs).

São entidades de software que operam com certo grau de autonomia, realizando tarefas como otimizar cadeias de suprimentos, gerenciar a distribuição de energia em redes inteligentes, coordenar redes de transporte e automatizar negociações em DeFi. Os agentes se descobrem e negociam entre si por meio de um Open Economic Framework, criando uma economia máquina-a-máquina.

O CEO Humayun Sheikh lidera uma equipe que enxerga sistemas baseados em IA quebrando o monopólio de dados das grandes empresas de tecnologia. Ao distribuir capacidades de IA em uma rede descentralizada, a Fetch.ai se posiciona como infraestrutura para a “economia agentic” — um futuro em que agentes autônomos representam indivíduos e dispositivos em incontáveis microtransações e tarefas de coordenação.

Utilidade do FET

O token FET funciona como principal meio de troca no ecossistema Fetch.ai.

Quando dois agentes se conectam, se comunicam e negociam, um paga ao outro por dados ou serviços usando FET. Importante: o token suporta micropagamentos de frações de centavo, viabilizando as transações granulares exigidas por uma economia máquina-a-máquina.

O FET possui diversas funções específicas. Ele paga pelas taxas de transação da rede e pelo deploy de serviços de IA. Desenvolvedores que constroem agentes autônomos pagam em FET para acessar as utilidades de machine learning e os recursos computacionais da rede. Usuários podem fazer staking de FET para participar da segurança da rede por meio do mecanismo de consenso Proof-of-Stake da Fetch.ai, recebendo recompensas por contribuir com nós validadores.

Os agentes também precisam depositar FET para se registrar na rede, criando uma exigência de staking que financia seu direito de operar. Esse mecanismo de depósito garante que os agentes tenham “skin in the game” econômico, reduzindo spam e incentivando contribuições de qualidade.

Tokenomics e Estrutura

O FET existe em múltiplas formas em diferentes blockchains. Lançado originalmente como um token ERC-20 no Ethereum, o Fetch.ai posteriormente implantou sua própria mainnet construída no ecossistema Cosmos. Usuários podem fazer bridge entre a versão nativa e o formato ERC-20, com a escolha afetando taxas de transação e compatibilidade com diferentes ecossistemas DeFi.

O fornecimento máximo é de aproximadamente 1 bilhão de tokens FET, embora a distribuição exata e os cronogramas de vesting variem.

O token opera tanto no Ethereum (para compatibilidade ERC-20) quanto na Binance Smart Chain (como token BEP-20), com uma ponte de token 1:1 permitindo que usuários troquem entre redes conforme suas necessidades.

A Fetch.ai faz parte da Artificial Superintelligence Alliance, uma colaboração com SingularityNET e Ocean Protocol anunciada em 2024. A aliança busca criar um ecossistema unificado de IA descentralizada, com capitalização de mercado combinada mirando status de top 20 em cripto.

Detentores de tokens AGIX e OCEAN podem converter para FET, potencialmente consolidando liquidez e esforços de desenvolvimento entre os projetos.

Casos de Uso

As aplicações da Fetch.ai abrangem múltiplos setores. Em cidades inteligentes, agentes coordenam estacionamento e tráfego. Um projeto-piloto em Cambridge demonstrou agentes encontrando vagas de estacionamento de forma autônoma, dando lances por espaços e processando pagamentos em tempo real. Ao adicionar ride-hailing, a rede pode despachar veículos com base em padrões de demanda.

Mercados de energia representam outro caso de uso importante.

Proprietários de residências com energia solar em telhados implantam agentes que comercializam o excedente de energia diretamente com vizinhos, contornando distribuidoras centralizadas. Os agentes negociam preços, verificam transações e liquidam pagamentos em FET, criando um marketplace de energia peer-to-peer.

Em logística e cadeia de suprimentos, agentes otimizam roteirização, gestão de estoque e seleção de transportadoras.

Uma empresa pode implantar um agente que descobre fornecedores pela rede, negocia termos, compara preços, verifica pontuações de qualidade, faz pedidos, organiza o frete e realiza pagamentos — tudo de forma autônoma com base em parâmetros pré-definidos.

A automação em DeFi mostra potencial. Agentes podem executar estratégias complexas de trading, otimizar provisão de liquidez entre protocolos e gerenciar posições de colateral em mercados de empréstimo. Em meados de 2025, um agente apoiado pela Fetch.ai venceu o hackathon da UC Berkeley para coordenação de tráfego aéreo, demonstrando capacidades em alocar slots de voo, gerenciar atrasos e negociar zonas de congestionamento entre agentes autônomos trabalhando com dados em tempo real.

A parceria com a Interactive Strength (TRNR) criou agentes de treino inteligentes que analisam dados de desempenho, sugerem recomendações personalizadastreinos e negociar planos de treinamento com os usuários, tudo liquidado via pagamentos em FET.

Cenário Competitivo e Riscos

A Fetch.ai compete com outros protocolos focados em agentes, como a Autonolas (OLAS), que oferece um programa de aceleração para agentes autônomos. O Virtuals Protocol surgiu no fim de 2024 como um grande concorrente, construindo uma plataforma de lançamento de agentes de IA na Base e na Solana com seu próprio ecossistema de agentes tokenizados.

A ameaça competitiva mais ampla vem de plataformas de IA centralizadas.

Google, Amazon e Microsoft oferecem serviços avançados de IA por meio de suas plataformas de nuvem sem exigir que os usuários mantenham tokens proprietários.

Para que a Fetch.ai tenha sucesso, o modelo descentralizado de agentes precisa oferecer vantagens claras — preservação de privacidade, resistência à censura, coordenação direta peer-to-peer — que justifiquem a complexidade de gerenciar criptoativos.

A incerteza regulatória representa riscos. Sistemas de IA que operam de forma autônoma podem enfrentar escrutínio sob regulações emergentes. A abordagem baseada em risco do AI Act da UE pode classificar os agentes da Fetch.ai como “de alto risco” quando operarem em setores como energia ou logística, exigindo auditorias e supervisão que aumentam os custos operacionais.

Persiste o ceticismo em relação à narrativa da economia de agentes.

Críticos questionam se agentes autônomos realmente alcançarão adoção em massa ou permanecerão uma curiosidade técnica de nicho. Se a economia máquina-a-máquina não se materializar em escala, o FET se torna uma solução em busca de um problema.

Em 12 de novembro de 2025, o FET era negociado em torno de US$ 0,25–0,30, após ter passado por volatilidade significativa ao longo do ano. O token ganhou atenção quando a Interactive Strength anunciou planos para um tesouro cripto de US$ 500 milhões centrado em FET, sinalizando confiança institucional no potencial de longo prazo do projeto.

Analistas projetam preços-alvo de US$ 6,71 até 2030, embora tais previsões carreguem grande incerteza. A questão fundamental é se a coordenação baseada em agentes oferece valor suficiente para justificar a economia do token, ou se alternativas centralizadas mais simples prevalecem.

Desenvolvimentos recentes mostram potencial. A Fetch.ai lançou um acelerador de US$ 10 milhões no início de 2025 para investir em startups que constroem sobre sua infraestrutura. Isso sinaliza compromisso com o crescimento do ecossistema além da negociação especulativa.

Token 3: Análise Profunda do Render Token (RNDR)

O Que é a Render Network

A Render Network é uma plataforma descentralizada de renderização em GPU que conecta criadores que precisam de poder computacional com indivíduos e organizações que oferecem recursos de GPU ociosos. Originalmente concebida em 2009 pelo CEO da OTOY, Jules Urbach, e lançada publicamente em abril de 2020, a Render evoluiu para uma das principais redes descentralizadas de infraestrutura física (DePIN) para workloads de gráficos e IA.

A rede opera como um marketplace peer-to-peer. Criadores submetem jobs de renderização — gráficos 3D, efeitos visuais, visualizações arquitetônicas, inferência de IA — para a rede.

Operadores de nós com capacidade de GPU disponível pegam esses jobs e os processam em troca de tokens RNDR. A plataforma aproveita o software OctaneRender, líder de mercado da OTOY, oferecendo capacidades de renderização em nível profissional por meio de infraestrutura distribuída.

A Render Network resolve um gargalo fundamental: renderização de alta qualidade exige enorme poder de GPU, mas serviços de nuvem centralizados são caros e podem não ter capacidade suficiente em períodos de pico de demanda. Ao agregar GPUs subutilizadas globalmente, a Render democratiza o acesso a ferramentas profissionais de renderização a uma fração do custo tradicional.

Token de Utilidade RNDR

O token RNDR (agora RENDER após migrar para Solana) funciona como o token nativo de utilidade da rede. Criadores pagam por serviços de renderização em RENDER, com custos determinados pelo poder de GPU necessário, medido em OctaneBench (OBH) — uma unidade padronizada desenvolvida pela OTOY para quantificar capacidade de renderização.

Operadores de nós ganham RENDER por completar jobs.

A rede implementa um sistema de reputação em camadas: Tier 1 (Trusted Partners), Tier 2 (Priority) e Tier 3 (Economy). Operadores de nós de níveis mais altos cobram taxas premium, mas oferecem confiabilidade garantida. As pontuações de reputação dos criadores influenciam a velocidade de atribuição de jobs — aqueles com histórico sólido acessam recursos mais rapidamente.

Direitos de governança acompanham os tokens RENDER. Detentores votam em upgrades da rede, mudanças de protocolo e propostas de financiamento por meio da Render DAO. Essa governança descentralizada garante que a comunidade molde a evolução da rede em vez de apenas uma fundação centralizada.

O mecanismo de Equilíbrio de Queima-e-Mintagem (Burn-and-Mint Equilibrium), implementado em janeiro de 2023, gerencia o suprimento de tokens de forma dinâmica. Quando criadores pagam por renderização, 95% dos tokens são queimados, sendo removidos de circulação. Operadores de nós recebem tokens recém-mintados para manter o equilíbrio econômico. Esse desenho torna o RENDER potencialmente deflacionário à medida que o uso da rede cresce, já que a taxa de queima pode exceder a de mintagem se a demanda for forte.

Tokenomics

O RENDER migrou do Ethereum para a Solana no fim de 2023 após uma votação da comunidade. Essa transição visou aproveitar as transações mais rápidas e taxas mais baixas da Solana. O token RNDR original (ERC-20) no Ethereum foi atualizado para RENDER (token SPL) na Solana. O suprimento total é limitado a 644.168.762 tokens, com aproximadamente 517 milhões em circulação em 2025.

A distribuição de tokens destinou 25% para vendas públicas, 10% para reservas e 65% mantidos em escrow para modular fluxos de oferta e demanda. Essa reserva permite que a fundação gerencie a disponibilidade de tokens à medida que a rede escala.

Casos de Uso

A Render Network atende múltiplas indústrias. Empresas de produção de filmes e televisão usam a rede para renderização de efeitos visuais. Grandes estúdios já renderizaram projetos usando nós descentralizados, demonstrando a capacidade do sistema para fluxos de trabalho profissionais, com criptografia de ponta a ponta garantindo a proteção de propriedade intelectual.

Desenvolvedores de jogos utilizam a Render para criação de ativos 3D e renderização em tempo real.

Projetos de metaverso dependem da rede para gerar ambientes imersivos e gráficos de avatares. A escalabilidade do poder de GPU distribuído permite que criadores aumentem a capacidade de renderização conforme necessário sem investir em hardware local caro.

Arquitetos e designers de produto usam a Render para visualizações 3D de alta qualidade. Escritórios de arquitetura criam visitas virtuais em realidade virtual de edifícios antes da construção. Designers de produto fazem protótipos em escala, testando texturas e cores por meio de renderização paralelizada em GPU.

A inferência de IA representa um caso de uso em crescimento.

Em julho de 2025, a Render integrou GPUs NVIDIA RTX 5090 especificamente para workloads de computação de IA nos Estados Unidos. O treinamento de certos modelos de IA, especialmente aqueles que envolvem geração de imagens ou vídeos, se beneficia do poder de GPU distribuído. A infraestrutura da rede pode acelerar o treinamento de IA de forma significativa em comparação com configurações de máquina única.

Dinâmica Competitiva

A Render compete com provedores centralizados e descentralizados. Serviços tradicionais de nuvem de GPU da AWS, Google Cloud e provedores especializados como a CoreWeave oferecem interfaces simplificadas e SLAs confiáveis. No entanto, cobram preços premium e podem ter capacidade limitada em períodos de pico de demanda.

No espaço descentralizado, os concorrentes incluem Akash Network (AKT), io.net (IO) e Aethir. Cada plataforma aborda de maneira diferente a coordenação de marketplaces de GPU — a Akash foca em infraestrutura de nuvem mais ampla, a io.net enfatiza workloads de IA/ML, e a Aethir mira jogos e entretenimento. A Render se diferencia por sua integração com o software de renderização profissional da OTOY e por sua reputação consolidada entre profissionais criativos.

A questão de captura de valor persiste. A computação em GPU está se tornando cada vez mais comoditizada à medida que mais provedores entram no mercado.

A Render precisa demonstrar que seu modelo descentralizado oferece vantagens claras — eficiência de custos, disponibilidade global, resistência à censura — que justifiquem o uso de tokens cripto em vez de cartões de crédito com provedores centralizados.

Parcerias com grandes empresas fornecem validação. Ari Emanuel (co-CEO da Endeavor) apoiou publicamente a Render Network, assinando acordos com Disney, HBO, Facebook e Unity. Essas parcerias sinalizam reconhecimento mainstream, embora converter esses relacionamentos em uso consistente da rede continue sendo um desafio.o desafio.

Em 12 de novembro de 2025, RENDER foi negociado em torno de US$ 4,50-5,00, com valor de mercado próximo de US$ 2,5-3 bilhões. O token passou por crescimento significativo em 2024, subindo mais de 13.300% em relação ao seu preço inicial no começo de 2024, embora desde então tenha se consolidado. Analistas atribuem isso às narrativas de IA e GPU/NVIDIA, com a parceria com a Apple oferecendo credibilidade adicional.

Os riscos incluem concorrência de provedores centralizados que escalam de forma mais eficiente, potencial centralização de hardware à medida que a economia de mineração favorece grandes operadores, e a dúvida se marketplaces descentralizados de GPU alcançarão adoção sustentável ou permanecerão soluções de nicho.

Análise Comparativa: Tokens de Utilidade vs Tokens de Reserva de Valor

Tokens de utilidade em IA operam com propostas de valor fundamentalmente diferentes dos tokens de reserva de valor como Bitcoin e Ethereum. Entender essas distinções esclarece tanto as oportunidades quanto os desafios que o segmento de tokens de utilidade enfrenta.

Propósito e Vetores de Demanda

O valor do Bitcoin deriva principalmente de seu posicionamento como ouro digital – uma reserva de valor escassa, descentralizada e proteção contra inflação monetária. O teto de 21 milhões de BTC e o valor de mercado acima de US$ 2 trilhões o posicionam como uma classe de ativo macro. O Ethereum adiciona programabilidade, derivando valor por atuar como camada de liquidação para protocolos DeFi, NFTs e outras aplicações, com demanda por ETH vindo de taxas de gás e requisitos de staking.

Tokens de utilidade como TAO, FET e RENDER, por sua vez, derivam valor do uso da rede. Em teoria, a demanda se correlaciona com os trabalhos computacionais processados, agentes implantados e tarefas de renderização concluídas. Mais modelos de IA treinados no Bittensor devem aumentar a demanda por TAO para acessar inteligência. Mais agentes autônomos no Fetch.ai devem impulsionar transações em FET. Mais trabalhos de renderização devem queimar mais tokens RENDER.

Tokenomics e Governança

Tokens de reserva de valor enfatizam a escassez. A oferta fixa e os ciclos de halving do Bitcoin criam uma redução de emissão previsível. O Ethereum migrou para Proof-of-Stake com o EIP-1559 queimando taxas de transação, introduzindo pressão deflacionária quando o uso da rede é alto.

Tokens de utilidade empregam abordagens variadas. Bittensor imita o modelo de halving do Bitcoin, criando escassez. O Equilíbrio de Queima-e-Mintagem (Burn-and-Mint Equilibrium) do Render vincula a oferta ao uso – demanda alta queima mais tokens do que são emitidos, reduzindo a oferta. Fetch.ai mantém oferta fixa, mas depende de incentivos de staking para reduzir a velocidade de circulação.

A governança difere significativamente. O Bitcoin mantém uma abordagem de desenvolvimento conservadora, com mudanças mínimas de protocolo.

O Ethereum usa coordenação off-chain e eventual consenso aproximado. Tokens de utilidade frequentemente implementam governança on-chain direta, na qual detentores de tokens votam em upgrades de protocolo, propostas de financiamento e ajustes de parâmetros, dando às comunidades uma gestão mais ativa.

Caminhos de Adoção e Base de Usuários

Tokens de reserva de valor miram investidores que buscam exposição a criptoativos ou proteção contra o sistema financeiro tradicional. Bitcoin atrai aqueles que acreditam em princípios de “dinheiro sólido”. Ethereum atrai desenvolvedores e usuários que interagem com aplicações DeFi e Web3.

Tokens de utilidade precisam atrair tipos de usuários específicos. Bittensor precisa de pesquisadores de IA e cientistas de dados escolhendo treinamento de modelos descentralizado em vez de frameworks consolidados. Fetch.ai requer desenvolvedores construindo agentes autônomos para aplicações no mundo real. Render precisa de profissionais criativos confiando em infraestrutura descentralizada para fluxos de trabalho de produção.

Essas barreiras de adoção são mais íngremes. Desenvolvedores enfrentam custos de troca em relação às ferramentas existentes. Empresas exigem confiabilidade e suporte que redes descentralizadas nascente podem ter dificuldade em fornecer. Tokens de utilidade precisam demonstrar vantagens claras – custo, desempenho, funcionalidades – para superar a inércia.

Mecanismos de Captura de Valor

Tokens de reserva de valor capturam valor por meio de escassez e efeitos de rede.

À medida que mais participantes reconhecem o Bitcoin como reserva de valor, a demanda aumenta enquanto a oferta permanece fixa, pressionando os preços para cima. Esse ciclo especulativo se retroalimenta, embora também crie volatilidade.

Tokens de utilidade enfrentam o problema da velocidade. Se usuários convertem imediatamente os tokens recebidos em fiat ou outras criptos, a alta velocidade impede a acumulação de valor. A Equação de Troca (M×V = P×Q) sugere que, para um dado volume de transações (P×Q), maior velocidade (V) implica menor valor de mercado (M).

Os protocolos mitigam a velocidade por meio de vários mecanismos. Requisitos de staking bloqueiam tokens, reduzindo a oferta circulante. Bittensor exige que validadores façam stake de TAO. Fetch.ai recompensa stakers com taxas da rede. Mecanismos de queima como o do Render removem tokens permanentemente de circulação. Direitos de governança criam incentivos para manter tokens visando poder de voto.

Desempenho de Mercado e Trajetórias

O Bitcoin atingiu máximas históricas acima de US$ 126.000 em 2025, continuando sua trajetória como ativo macro. O Ethereum se recuperou das quedas pós-2022, mantendo sua posição como principal plataforma de contratos inteligentes.

Tokens de utilidade em IA mostraram desempenho mais volátil. TAO foi negociado entre US$ 200-750 em 2024-2025, com valor de mercado chegando a US$ 3,7-4,1 bilhões nos picos. FET passou por movimentos significativos, especialmente em torno do anúncio da Artificial Superintelligence Alliance. RENDER apresentou crescimento explosivo em 2023-2024 antes de se consolidar.

Esses tokens são negociados tanto com base em especulação quanto em fundamentos. Quando narrativas de IA dominam o discurso em cripto, tokens de utilidade tendem a superar o desempenho. Em períodos de queda, muitas vezes têm performance inferior a Bitcoin e Ethereum, à medida que investidores migram para ativos considerados mais seguros.

Coexistência ou Competição?

A questão é se tokens de utilidade representam a “próxima onda” ou se coexistem como categoria complementar. As evidências sugerem que a coexistência é mais provável. Tokens de reserva de valor servem a propósitos diferentes de tokens operacionais. Bitcoin funciona como ouro digital, Ethereum como camada de liquidação programável, enquanto tokens de utilidade atuam como combustível para aplicações específicas.

No entanto, o sucesso não é garantido. A maior parte dos tokens de utilidade pode fracassar se o uso não se materializar ou se alternativas centralizadas se mostrarem superiores. O valor de mercado de cripto de IA alcançou US$ 24-27 bilhões em 2025, substancial, mas pequeno comparado ao Bitcoin sozinho acima de US$ 2 trilhões.

Os vencedores provavelmente demonstrarão:

- Uso sustentado da rede crescendo independentemente de especulação

- Vantagens claras sobre alternativas centralizadas

- Ecossistemas de desenvolvedores robustos e adoção empresarial

- Mitigação eficaz da velocidade por meio de staking ou queima

- Modelos de governança que equilibrem descentralização com eficiência

O teste definitivo é se tokens de utilidade se tornam infraestrutura para workloads de IA em escala, ou se permanecem soluções de nicho ofuscadas por provedores de nuvem centralizados.

Valuation, Métricas de Adoção e Risco de Narrativa

Avaliar tokens de utilidade requer frameworks diferentes dos usados para ativos de reserva de valor. Enquanto o Bitcoin pode ser avaliado por modelos stock-to-flow ou como ouro digital comparável a metais preciosos, tokens de utilidade exigem métricas baseadas em uso.

Métricas-Chave para Tokens de Utilidade

Estatísticas de uso da rede fornecem a base. Para o Bittensor, métricas relevantes incluem:

- Número de subnets ativas e suas especializações

- Horas de computação dedicadas ao treinamento de modelos

- Contagem de miners e validadores que asseguram a rede

- Volume de transações que fluem pelo protocolo

- Implantações de modelos bem-sucedidas atendendo aplicações reais

Bittensor reporta 128 subnets ativas no fim de 2025, um aumento substancial em relação a períodos anteriores. Contudo, avaliar se essas subnets geram demanda genuína versus atividade especulativa exige investigação mais profunda.

Para Fetch.ai, métricas relevantes incluem:

- Número de agentes autônomos implantados

- Interações agente‑a‑agente e volume de transações

- Integrações no mundo real em diversos setores

- Parcerias com empresas ou governos

- Participação em staking e número de validadores

Fetch.ai demonstrou provas de conceito em coordenação de estacionamento, negociação de energia e logística, mas o desafio é escalar de pilotos para adoção ampla.

Para a Render Network, indicadores críticos são:

- Jobs de renderização processados mensalmente

- Número de operadores de nodes ativos oferecendo capacidade de GPU

- Clientes corporativos usando a rede em fluxos de produção

- Taxa de queima comparada à taxa de emissão sob o modelo Burn-and-Mint Equilibrium

- Horas de GPU utilizadas na rede descentralizada

A Render assegurou parcerias com grandes estúdios e processa workloads reais de renderização, fornecendo evidências de uso mais concretas do que muitos tokens de utilidade.

Velocidade do Token e Métricas de Queima

A velocidade do token mede quão rapidamente os tokens circulam pela economia. Alta velocidade indica que usuários gastam ou convertem tokens imediatamente, impedindo a acumulação de valor. Baixa velocidade sugere que tokens são mantidos por mais tempo, potencialmente como reserva de valor ou parastaking rewards.

Bitcoin demonstra velocidade de 4,1%, Ethereum 3,6%, indicando que são ativos maduros mantidos predominantemente em carteira em vez de transacionados. Tokens de utilidade normalmente apresentam velocidades mais altas inicialmente, à medida que os usuários recebem tokens pelo trabalho e imediatamente os convertem em moedas estáveis.

Mecanismos de queima combatem alta velocidade. O sistema da Render queima 95% dos tokens de pagamento em cada transação, removendo oferta. Se a taxa de queima exceder a taxa de emissão, a oferta em circulação diminui, podendo sustentar apreciação de preço se a demanda permanecer constante.

Avaliar queimas exige transparência. Os projetos devem publicar relatórios regulares de queima, mostrando os tokens removidos de circulação. A Render fornece esses dados, permitindo verificação independente de alegações deflacionárias.

Parcerias e Integrações no Mundo Real

Adoção empresarial sinaliza utilidade genuína. O primeiro ETP da Bittensor lançado na SIX Swiss Exchange oferece acesso institucional. O tesouro de US$ 500 milhões em FET da Interactive Strength demonstra confiança corporativa. As parcerias da Render com Disney, HBO e Unity validam as capacidades da plataforma para fluxos de trabalho de produção.

No entanto, parcerias por si só não garantem uso sustentado. Muitos projetos de blockchain anunciam parcerias que não se materializam em receita significativa ou atividade de rede. Acompanhar o volume real de transações decorrentes de relacionamentos corporativos fornece uma visão mais clara.

Riscos de Narrativa

Diversos riscos de narrativa ameaçam as avaliações de tokens de utilidade:

Hype de IA + Cripto sem Entrega: A convergência de IA e blockchain cria narrativas poderosas, mas, se sistemas de IA descentralizados falharem em igualar o desempenho das alternativas centralizadas, as avaliações se reduzem. A maioria dos especialistas espera que apenas alguns projetos de IA-cripto tenham sucesso no longo prazo, com muitos permanecendo especulativos.

Capacidade de Cálculo sem Demanda: Construir infraestrutura descentralizada de GPU não significa nada se os desenvolvedores não a utilizarem. Se o uso não escalar além dos primeiros adotantes e evangelistas, os tokens se tornam soluções em busca de problemas. A questão é se a computação descentralizada pode capturar participação de mercado significativa da AWS, Google Cloud e outros gigantes centralizados.

Ameaças Regulatórias: Governos ao redor do mundo estão desenvolvendo regulamentações para IA. A estrutura baseada em risco da Lei de IA da UE pode classificar certos sistemas de IA como de alto risco, exigindo auditorias e supervisão. Agentes autônomos que tomam decisões econômicas podem enfrentar escrutínio. A incerteza sobre se tokens de utilidade constituem valores mobiliários adiciona risco regulatório.

Centralização de Hardware: Redes descentralizadas correm o risco de recentralização. Se mineração ou operação de nós se tornar economicamente viável apenas para grandes players com economias de escala, a promessa de descentralização se esvai. Redes de GPU podem se consolidar em torno de grandes data centers, contrariando o propósito de uma infraestrutura peer-to-peer.

Limitações Técnicas: Sistemas descentralizados enfrentam trade-offs inerentes. Sobrecarga de coordenação, latência e preocupações de confiabilidade podem impedir tokens de utilidade de competir com alternativas centralizadas otimizadas. Se limitações técnicas se mostrarem intransponíveis, a adoção estaciona.

Modelos de Avaliação

Modelos financeiros tradicionais têm dificuldades com tokens de utilidade. Fluxo de caixa descontado (DCF) funciona para tokens com divisão de lucros — Augur paga detentores de REP pelo trabalho na rede, criando fluxos de caixa adequados para análise por DCF. Mas tokens de utilidade pura, sem dividendos, carecem de fluxos de caixa óbvios a serem descontados.

A Equação de Troca oferece uma abordagem: M×V = P×Q, onde M é o valor de mercado (o que queremos descobrir), V é a velocidade, P é o preço por transação e Q é a quantidade de transações. Reorganizando: M = P×Q / V. Isso implica que o valor de mercado é igual ao volume de transações dividido pela velocidade.

Maior volume de transações (P×Q) sustenta avaliações mais altas. Menor velocidade (V) também sustenta avaliações mais altas. Os projetos devem aumentar o uso ou diminuir a velocidade — idealmente ambos. Staking reduz velocidade; mecanismos de queima reduzem oferta; utilidade real aumenta o volume de transações.

A Lei de Metcalfe sugere que o valor de uma rede cresce de forma proporcional ao quadrado do número de usuários. À medida que mais participantes se juntam à Bittensor, Fetch.ai ou Render, efeitos de rede podem impulsionar crescimento exponencial de valor. No entanto, essa lei assume que todas as conexões são valiosas — o que nem sempre é verdade para redes em estágio inicial.

Avaliação comparativa observa projetos semelhantes. Se a Bittensor atingir uso de rede similar ao da SingularityNET ou Ocean Protocol, comparar valores de mercado fornece referências aproximadas. Porém, a tokenômica e os casos de uso exclusivos de cada projeto limitam a utilidade de comparações diretas.

Em última análise, a avaliação de tokens de utilidade permanece especulativa. Até que redes demonstrem uso sustentado independente de especulação, os preços refletem tanto a força da narrativa e o sentimento de mercado quanto o valor fundamental.

O Que Vem a Seguir: Cenários para o Futuro

A trajetória dos tokens de utilidade em IA depende de diversas variáveis incertas: taxas de adoção tecnológica, desenvolvimentos regulatórios, competição de provedores centralizados e a capacidade dos tokens de capturar valor do uso da rede. Três cenários amplos iluminam futuros possíveis.

Melhor Cenário: Tokens de Infraestrutura se Tornam Camada Central

Nesse cenário otimista, infraestrutura de IA descentralizada atinge adoção mainstream. A Bittensor se torna a plataforma preferida para treinamento colaborativo de modelos de IA, atraindo grandes instituições de pesquisa e empresas. A arquitetura de sub-redes se mostra superior a estruturas centralizadas para certos casos de uso — IA em saúde com preservação de privacidade, marketplaces descentralizados de modelos, inteligência coletiva.

Os agentes autônomos da Fetch.ai proliferam em diversos setores. Cidades inteligentes implementam redes de agentes para coordenação de tráfego, distribuição de energia e serviços públicos. Cadeias de suprimentos se padronizam em otimização baseada em agentes. Protocolos DeFi integram agentes para execução automatizada de estratégias. A “economia agentizada” se materializa como previsto, com bilhões de microtransações coordenadas por softwares autônomos.

A Render Network captura participação de mercado significativa de provedores centralizados de GPU. Profissionais criativos e pesquisadores de IA utilizam rotineiramente computação descentralizada para fluxos de trabalho de produção. O mercado global de cloud gaming projetado para alcançar US$ 121 bilhões até 2032 impulsiona a demanda por infraestrutura distribuída de GPU.

Nesse cenário, tokens de utilidade ganham valor duradouro por meio de:

- Crescimento sustentado de uso: A atividade de rede aumenta independentemente da especulação

- Mitigação de velocidade: Staking, queima e incentivos de governança mantêm tokens em carteira em vez de vendidos imediatamente

- Efeitos de rede: À medida que mais usuários entram, as plataformas se tornam mais valiosas para todos os participantes

- Clareza regulatória: Surgem frameworks que acomodam IA descentralizada ao mesmo tempo que protegem consumidores

Os preços dos tokens podem alcançar projeções otimistas de analistas — TAO ultrapassando US$ 1.000, FET chegando a US$ 6-10, RENDER superando US$ 20 — se os fundamentos de uso justificarem as avaliações. Os valores de mercado cresceriam proporcionalmente, com os principais tokens de utilidade em IA potencialmente atingindo US$ 20-50 bilhões ao capturarem parcelas de mercados trilionários de IA e computação em nuvem.

Para investidores, isso representa valorização significativa em relação aos níveis atuais. Para desenvolvedores, valida a infraestrutura descentralizada como alternativa viável a provedores de nuvem centralizados. Para os mercados cripto, prova que tokens de utilidade podem evoluir além da especulação e se tornar ativos de infraestrutura funcional.

Também Leia: Bitcoin Cai Abaixo de US$ 67K Após Trump Prometer Bombardear o Irã Até a 'Idade da Pedra'

Cenário Base: Alguns Tokens Vencem, Muitos Estacionam

Um cenário mais realista reconhece que apenas uma parte dos tokens de utilidade em IA atuais alcançará adoção sustentada. Vencedores se destacam por tecnologia superior, ecossistemas fortes, parcerias reais e mecanismos eficazes de captura de valor. A maioria dos projetos estaciona ou desaparece à medida que os usuários reconhecem utilidade prática limitada.

Nesse cenário, a Bittensor, Fetch.ai e Render — como projetos líderes — têm mais chances do que concorrentes menores. No entanto, mesmo estes enfrentam desafios. IA descentralizada se mostra valiosa para nichos específicos — aplicações em que a privacidade é crítica, redes resistentes à censura, certos domínios de pesquisa —, mas não consegue substituir provedores centralizados na maioria dos casos de uso.

Tokens de reserva de valor permanecem dominantes. Bitcoin consolida sua posição como ouro digital. Ethereum continua servindo como principal camada de liquidação para aplicações descentralizadas. Tokens de utilidade em IA coexistem como infraestrutura para aplicações especializadas, em vez de plataformas de uso geral.

Os preços dos tokens refletem crescimento de uso modesto. TAO pode alcançar US$ 500-800, FET US$ 2-4, RENDER US$ 8-12 nos próximos anos — valorização relevante, mas distante das previsões explosivas. Os valores de mercado crescem, mas permanecem ordens de magnitude abaixo de Bitcoin e Ethereum.

Diversos fatores caracterizam esse cenário base:

- Adoção em nichos: Tokens de utilidade atendem verticalizações ou casos de uso específicos de forma eficaz

- Concorrência centralizada: AWS, Google Cloud e outros gigantes mantêm dominância em computação geral

- Sobrecarga regulatória: Exigências de conformidade adicionam atrito às plataformas descentralizadas

- Trade-offs técnicos: Sistemas descentralizados acabam sendo mais lentos, complexos ou menos confiáveis do que alternativas centralizadas para muitas aplicações

Para investidores, uma apreciação moderada recompensa os primeiros apoiadores, mas fica aquém das projeções mais otimistas. Para os mercados cripto, tokens de utilidade estabelecem legitimidade como uma categoria de ativos distinta dos tokens de reserva de valor, porém com valorizações mais moderadas.

Cenário negativo: uso não se materializa

No cenário pessimista, os tokens de utilidade não conseguem traduzir suas capacidades técnicas em demanda sustentável. Apesar de uma infraestrutura impressionante, os usuários não migram das plataformas já consolidadas. Desenvolvedores continuam usando TensorFlow, PyTorch e computação em nuvem centralizada em vez de aprender novos protocolos descentralizados. Profissionais criativos permanecem com Adobe, Autodesk e fazendas de renderização tradicionais, em vez de experimentar alternativas habilitadas por cripto.

Nesse cenário, tokens de utilidade em IA tornam‑se principalmente ativos especulativos. Os preços passam a oscilar com base no sentimento mais amplo do mercado cripto e em ciclos de hype de IA, em vez de uso fundamental. Quando as narrativas se esvaem – como aconteceu com muitos tokens de ICO de 2017‑2018 – as valorizações desabam.

Várias dinâmicas podem levar a esse desfecho:

- Atrito na experiência do usuário: Gerenciar wallets, pagar taxas de gas e navegar por protocolos descentralizados acaba sendo trabalhoso demais para o usuário comum

- Defasagens de desempenho: Alternativas centralizadas continuam mais rápidas, confiáveis e ricas em funcionalidades do que as opções descentralizadas

- Viabilidade econômica: A economia do token não consegue alinhar incentivos de forma adequada, levando à rotatividade de provedores, problemas de qualidade ou instabilidade de rede

- Repressão regulatória: Governos classificam tokens de utilidade como valores mobiliários ou proíbem certas aplicações, limitando o uso legal

Os preços dos tokens voltariam a mínimas especulativas. TAO poderia cair abaixo de US$ 200, FET abaixo de US$ 0,50, RENDER abaixo de US$ 3, à medida que investidores reconhecem a falta de demanda fundamental. Os projetos poderiam sobreviver com comunidades dedicadas, mas sem alcançar escala significativa.

Esse cenário representa um risco existencial para a categoria de tokens de utilidade. Se projetos líderes, com financiamento substancial, equipes talentosas e parcerias reais, não conseguirem demonstrar product‑market fit, isso sugere que o modelo de IA/computação descentralizada fundamentalmente não funciona em grande escala.

Also Read: Dogecoin Drops Below $0.089 On Bearish Signals

Implicações em todos os cenários

Para investidores: Perfis de risco‑retorno variam dramaticamente entre os cenários. O melhor caso oferece retornos múltiplos, mas exige que várias incertezas se resolvam de forma favorável. O cenário base proporciona valorização modesta com risco menor. O cenário negativo implica perdas significativas.

A construção de portfólio deve levar em conta as probabilidades de cada cenário. Alocar pequenas porcentagens em tokens de utilidade oferece upside assimétrico se o melhor caso se materializar, ao mesmo tempo em que limita a exposição ao downside. Concentrar‑se em tokens de utilidade em detrimento de ativos de reserva de valor aumenta a volatilidade e o risco.

Para desenvolvedores: Construir em plataformas baseadas em tokens de utilidade exige avaliar a viabilidade de longo prazo. Se os cenários base ou negativo se concretizarem, aplicações construídas nessas plataformas podem enfrentar dificuldades para encontrar usuários ou financiamento. Desenvolvedores devem manter opcionalidade — desenhando aplicações portáveis entre plataformas ou capazes de operar com backends centralizados caso a infraestrutura descentralizada se mostre inadequada.

Para a estrutura de mercado cripto: O sucesso ou fracasso dos tokens de utilidade molda a evolução das criptomoedas. Se o melhor caso se concretizar, o cripto se expande além de reserva de valor e DeFi, passando a ser infraestrutura real. Se o cenário negativo ocorrer, o cripto permanece principalmente um domínio especulativo e financeiro.

O que acompanhar

Vários indicadores ajudarão a esclarecer qual cenário vai se materializar:

Contagem de nós e participação: Crescimento no número de miners, validadores e provedores de GPU sinaliza efeitos de rede genuínos. Participação estagnada ou em queda sugere falta de viabilidade econômica.

Jobs de computação processados: Jobs reais de renderização, execuções de treinamento de IA e interações de agentes – não apenas atividade de testnet – demonstram demanda de fato. Projetos deveriam publicar estatísticas de uso transparentes.

Parcerias empresariais: Converter parcerias anunciadas em volume mensurável de transações valida os modelos de negócio. Parcerias sem uso correspondente indicam possível vaporware.

Burn e staking de tokens: Para projetos com mecanismos de queima, uma taxa de burn acima da taxa de emissão indica demanda forte. Alta participação em staking reduz a velocidade de circulação e mostra confiança de holders de longo prazo.

Atividade de desenvolvedores: Ecossistemas de desenvolvimento em crescimento – medidos por commits no GitHub, novos protocolos construídos sobre as plataformas, participação em hackathons — sinalizam bases saudáveis. Queda no interesse de desenvolvedores prenuncia estagnação.

Clareza regulatória: Marcos regulatórios mais claros sobre tokens de utilidade, sistemas de IA e infraestrutura descentralizada reduzem incertezas. Regulações favoráveis aceleram a adoção; as restritivas a dificultam.

Ecossistemas de hardware: Integração com grandes fabricantes de GPU ou provedores de nuvem legitima a computação descentralizada. Nvidia, AMD e outras parceiras ou reconhecendo plataformas de tokens de utilidade seriam um sinal de validação mainstream.

Acompanhar essas métricas entre 2025‑2027 esclarecerá se tokens de utilidade em IA representam inovação de infraestrutura genuína ou principalmente veículos especulativos. Essa distinção determinará se esses ativos alcançam relevância duradoura nos mercados cripto ou se desvanecem como mais um ciclo narrativo que se encerra.

Considerações finais

Tokens de utilidade em IA representam uma evolução significativa na narrativa arquitetural do cripto. Bittensor, Fetch.ai e Render Network demonstram que tokens podem servir a propósitos além de reserva de valor ou trading especulativo — eles podem coordenar infraestrutura descentralizada, incentivar trabalho computacional e viabilizar economias máquina‑a‑máquina.

A tese fundamental é convincente.

Redes descentralizadas de GPU agregam recursos subutilizados, reduzindo custos e democratizando o acesso. Agentes autônomos permitem coordenação em escalas impraticáveis para mediação humana.

O desenvolvimento colaborativo de IA distribui a criação de inteligência para além dos monopólios das big techs. Essas visões abordam problemas reais de escalabilidade de infraestrutura, acessibilidade à IA e coordenação econômica.

No entanto, traduzir visão em adoção sustentada continua sendo o desafio crítico. Tokens de utilidade precisam demonstrar vantagens claras sobre alternativas centralizadas, superando o atrito inerente a sistemas descentralizados. Precisam capturar valor por meio do uso, e não de especulação, resolver o problema de velocidade de circulação por meio de tokenomics eficazes e alcançar product‑market fit com empresas e desenvolvedores.

Read Next: XRP Ledger Hits Record 4.49M Transactions Amid Price Decline