Dimentica le memecoin e i cicli di hype: i token AI-utility sono una nuova categoria di crypto che sta facendo rumore e, questa volta, fanno davvero qualcosa.

Stanno costruendo silenziosamente il ponte tra la blockchain e l’enorme macchina computazionale che alimenta l’intelligenza artificiale. E mentre l’AI entra ovunque, dalla scrittura di script alla progettazione di molecole, questi token si evolvono di pari passo, passando da semplici fiches speculative su un tavolo da casinò a strumenti reali che mantengono operative le reti decentralizzate.

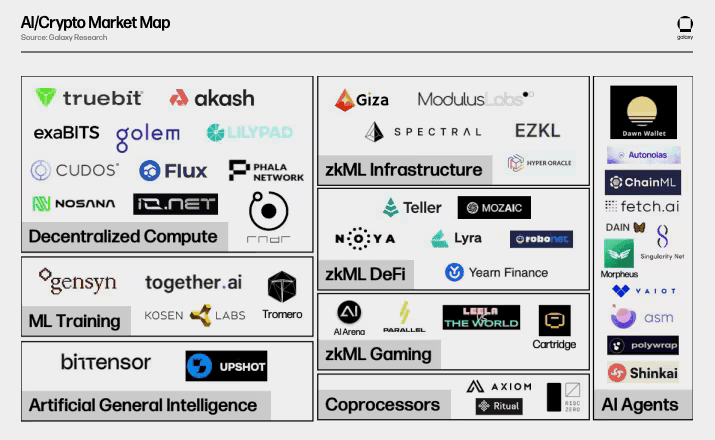

Tre progetti sono in prima linea in questo cambiamento: Bittensor (TAO), Fetch.ai (FET) e Render Token (RNDR).

Bittensor operates a decentralized machine learning network in cui i contributori addestrano modelli di AI in modo collaborativo e ricevono ricompense. Fetch.ai distribuisce agenti economici autonomi che eseguono compiti lungo le filiere, nei mercati energetici e nella finanza decentralizzata. Render Network trasforma la potenza GPU inattiva in un peer-to-peer marketplace per rendering 3D, effetti visivi e inferenza AI.

Questi token rappresentano più di un’innovazione incrementale.

Indicano un possibile cambiamento architetturale nel mondo crypto: dal racconto del “digital gold”, incentrato sulla scarsità e sulla funzione di riserva di valore, verso ecosistemi guidati dalla utility, dove i token facilitano lavoro computazionale reale.

Sebbene Bitcoin (BTC) ed Ethereum (ETH) si siano affermati tramite narrazioni monetarie e di piattaforma, i token AI-utility propongono una tesi di valore diversa: token come chiavi di accesso a infrastrutture decentralizzate, sistemi di pagamento per economie machine-to-machine e meccanismi di ricompensa per risorse computazionali.

Qui analizziamo in profondità perché questi token sono di tendenza ora, esaminiamo i loro modelli di utility e le tokenomics, valutiamo le dinamiche competitive e i rischi narrativi, esploriamo i framework di valutazione e consideriamo le implicazioni più ampie su come i token di utility potrebbero evolversi rispetto agli asset di riserva di valore già affermati.

Perché token di utility, perché ora

La convergenza tra accelerazione dell’AI e infrastrutture blockchain ha creato condizioni favorevoli all’adozione dei token di utility. Diversi macro-driver spiegano lo slancio attuale.

Primo, la domanda di potenza di calcolo per l’AI è esplosa.

L’addestramento di modelli linguistici avanzati e la generazione di media sintetici richiedono enormi risorse GPU, creando colli di bottiglia nelle infrastrutture cloud centralizzate. I provider tradizionali come AWS e Google Cloud faticano a soddisfare la domanda, con data center che hanno una media di utilizzo del 12–18% mentre la carenza di GPU persiste. Questo squilibrio tra domanda e offerta ha spinto al rialzo i costi di calcolo, rendendo economicamente valide le alternative decentralizzate.

Secondo, i precedenti cicli crypto si sono concentrati principalmente su protocolli DeFi e narrazioni di store-of-value. Ma nel 2024–2025 infrastructure and compute emerged come tema dominante.

The total crypto market cap crossed $4 trillion in 2025, and within that growth, AI-crypto projects captured significant investor attention.

I progetti che offrivano infrastrutture tangibili, anziché prodotti puramente finanziari, hanno guadagnato trazione con la maturazione del mercato.

Terzo, la tokenizzazione offre vantaggi unici nel coordinare risorse distribuite.

Reti GPU decentralizzate come Render possono aggregare globalmente potenza di calcolo inattiva, consentendo cost savings of up to 90% rispetto alle alternative centralizzate. I token forniscono lo strato di coordinamento economico: i creatori pagano i servizi di rendering in RNDR, gli operatori dei nodi guadagnano ricompense per la capacità GPU messa a disposizione e il protocollo mantiene trasparenza tramite transazioni on-chain.

Il modello di utility è in netto contrasto con i token di store-of-value. Il valore di Bitcoin si basa sulla fixed supply scarcity e sul suo posizionamento come oro digitale. Ethereum aggiunge programmabilità ma trae ancora molto valore dal ruolo di livello di regolamento e riserva di attività. I token di utility come TAO, FET e RNDR derivano invece valore dall’uso della rete: più modelli di AI vengono addestrati su Bittensor, più agenti autonomi vengono distribuiti su Fetch.ai, più lavori di rendering vengono elaborati su Render Network, più teoricamente aumenta la domanda di token.

Questo spostamento verso la utility non è solo narrativo. Render Network processes rendering jobs per grandi studi utilizzando nodi decentralizzati. Fetch.ai ha dimostrato applicazioni reali, tra cui autonomous parking coordination in Cambridge e sistemi di scambio energetico. L’architettura a subnet di Bittensor include ora 128 active subnets focalizzate su diversi domini di AI, dalla generazione di testo al folding di proteine.

Tuttavia, l’adozione basata sulla utility deve affrontare sfide. La maggior parte dei token viene ancora scambiata principalmente sulla base di valore speculativo più che su fondamentali di utilizzo. La token velocity — la velocità con cui i token cambiano di mano — può minare la stabilità dei prezzi se gli utenti convertono immediatamente le ricompense in altri asset. La domanda diventa se questi protocolli sapranno generare un utilizzo sufficiente a supportare le loro valutazioni o se resteranno asset guidati dalla narrativa, soggetti a cicli di hype.

Also Read: Bitcoin Decentralization Faces A Problem: Mining Power Tied To Just Three Nations

Token 1: Bittensor (TAO) – analisi approfondita

Cos’è Bittensor

Bittensor is an open-source protocol che alimenta una rete di machine learning decentralizzata. A differenza dello sviluppo AI tradizionale, concentrato nei laboratori dei colossi tech, Bittensor crea un marketplace peer-to-peer in cui gli sviluppatori contribuiscono con modelli di machine learning, i validatori ne valutano la qualità e i contributori guadagnano ricompense in base al valore informativo che apportano all’intelligenza collettiva.

Il protocollo è stato founded by Jacob Steeves and Ala Shaabana, ricercatori di informatica che hanno lanciato la rete per democratizzare lo sviluppo dell’AI. La visione è ambiziosa: creare un mercato dell’intelligenza artificiale in cui produttori e consumatori interagiscono in un contesto trustless e trasparente, senza gatekeeper centralizzati.

Utility e funzionamento

Il token TAO svolge diverse funzioni all’interno dell’ecosistema. In modo fondamentale, TAO grants access to the network's collective intelligence. Gli utenti estraggono informazioni dai modelli addestrati pagando in TAO, mentre i contributori che aggiungono valore alla rete accumulano più stake. Si crea così una struttura di incentivi in cui i contributi di modelli di alta qualità ricevono ricompense maggiori.

La rete opera tramite un’architettura a subnet. Each subnet specializes in different AI tasks — elaborazione del linguaggio naturale, riconoscimento di immagini, predizione di dati — e utilizza una propria logica di valutazione. I modelli competono all’interno delle subnet in base ad accuratezza ed efficienza. I validatori mettono in staking TAO per valutare gli output dei modelli e garantire una corretta assegnazione dei punteggi. I nominator sostengono specifici validatori o subnet e condividono le ricompense, in modo simile ai sistemi di delegated proof-of-stake.

Questo design modulare consente a Bittensor di scalare simultaneamente su numerosi domini di AI. Piuttosto che una rete monolitica, il protocollo funziona come infrastruttura per marketplace AI specializzati, ognuno con criteri di valutazione e distribuzioni di ricompense su misura.

Tokenomics

Le tokenomics di Bittensor rispecchiano il modello di scarsità di Bitcoin. TAO has a fixed supply of 21 million tokens, con un’emissione che segue un programma di halving. Il first halving occurred in 2025, dimezzando l’emissione giornaliera da 7.200 a 3.600 token. Questo meccanismo deflazionistico crea una scarsità di offerta simile ai cicli quadriennali di Bitcoin.

Attualmente approximately 9.6 million TAO tokens are in circulation, pari a circa il 46% dell’offerta totale. La circulating supply will continue growing ma a tasso decrescente a causa degli halving, con una distribuzione completa prevista nell’arco di diversi decenni.

Le ricompense di mining vanno ai contributori che riescono a migliorare l’intelligenza della rete. I validatori guadagnano per la valutazione accurata dei contributi dei modelli. Questa struttura duale di ricompense incentiva sia lo sviluppo dei modelli sia l’integrità della rete.

Casi d’uso

Le applicazioni di Bittensor coprono più domini. Collective learning permette, ad esempio, alle istituzioni sanitarie di addestrare modelli su dati medici sensibili senza condividere le informazioni sottostanti—come dimostrato nel rilevamento del COVID-19 da radiografie toraciche con il 90% di accuratezza. Le istituzioni finanziarie possono addestrare in modo collaborativo modelli di rilevamento frodi mantenendo privati i dati proprietari.

La struttura a subnet abilita servizi di AI specializzati. Le subnet di generazione di testo competono per produrre output linguistici di alta qualità. I prediction market sfruttano le capacità di inferenza di Bittensor. I servizi di embedding elaborano e codificano i dati per applicazioni downstream. Ogni subnet opera in modo autonomo pur contribuendo a il più ampio marketplace dell’intelligenza.

L’adozione da parte delle imprese rimane agli inizi ma in crescita. Deutsche Digital Assets and Safello launched il primo ETP Bittensor fisicamente garantito al mondo sulla SIX Swiss Exchange nel novembre 2025, offrendo agli investitori istituzionali un’esposizione regolamentata a TAO. Questo sviluppo segnala un interesse in maturazione oltre la mera speculazione retail.

Concorrenza ed ecosistema

Bittensor compete nello spazio dell’IA decentralizzata con progetti come SingularityNET (AGIX) e Ocean Protocol (OCEAN). SingularityNET gestisce un AI marketplace in cui gli sviluppatori monetizzano algoritmi e servizi. Ocean è focalizzato su marketplace di dati e applicazioni di compute-to-data. Ogni progetto affronta l’IA decentralizzata in modo diverso: Bittensor enfatizza l’addestramento collaborativo dei modelli, SingularityNET si concentra sui marketplace di servizi, Ocean dà priorità agli asset di dati.

Tuttavia, la minaccia competitiva maggiore proviene dai giganti centralizzati dell’IA. OpenAI, Google DeepMind e Anthropic dispongono di risorse immense, dataset proprietari e talenti d’avanguardia. Queste entità possono iterare più rapidamente e distribuire modelli più capaci rispetto alle alternative decentralizzate attualmente disponibili. Bittensor deve dimostrare che il suo approccio collaborativo produce modelli competitivi con le alternative centralizzate, non solo filosoficamente attraenti ma tecnicamente superiori per casi d’uso specifici.

L’aggiornamento della rete ai contratti smart WebAssembly (WASM) nel 2025 ha ampliato le funzionalità, abilitando caratteristiche come il lending, il trading automatizzato dei token dei subnet e le applicazioni cross-subnet. Questo sviluppo infrastrutturale mira a creare un’economia digitale più completa oltre il semplice addestramento di modelli.

Rischio narrativo e valutazione

La valutazione di Bittensor affronta diverse tensioni. Il 12 novembre 2025, TAO era scambiato intorno a $362-390, con una capitalizzazione di mercato vicina a 3,7-4,1 miliardi di dollari. Il token ha raggiunto massimi sopra i $400 all’inizio del 2025 ma ha sperimentato la volatilità tipica degli asset cripto.

I rialzisti indicano diversi driver di crescita.

Il meccanismo di halving crea una pressione deflazionistica, che potenzialmente sostiene l’apprezzamento del prezzo se la domanda rimane stabile. Gli analisti proiettano obiettivi che vanno da $360-500 nel 2026 a previsioni più aggressive che superano i $1.000 nel periodo 2027-2030, sebbene queste previsioni comportino un’incertezza significativa.

La domanda fondamentale è se l’utilizzo della rete giustifichi la valutazione.

La teoria della velocità dei token suggerisce che i token di utilità utilizzati principalmente per le transazioni faticano a mantenere valore perché gli utenti convertono rapidamente le ricompense in altri asset.

Bittensor mitiga questo aspetto tramite lo staking: i validatori devono bloccare TAO per partecipare al consenso della rete, riducendo l’offerta circolante e la velocità.

Tuttavia, se Bittensor non riesce ad attrarre carichi di lavoro di IA significativi oltre l’attività attuale dei suoi subnet, il token diventa principalmente speculativo. Il protocollo deve dimostrare che l’addestramento decentralizzato dei modelli offre vantaggi sufficientemente convincenti da giustificare la migrazione degli sviluppatori dai framework consolidati come TensorFlow o PyTorch combinati con compute centralizzato.

I rischi includono la concorrenza tecnologica, l’incertezza regolamentare intorno ai sistemi di IA, potenziali vulnerabilità di sicurezza nel protocollo e la sfida di mantenere la decentralizzazione man mano che la rete scala. Il calo settimanale recente del 20% evidenzia una volatilità persistente anche mentre cresce l’interesse istituzionale più ampio.

Token 2: Approfondimento su Fetch.ai (FET)

Che cos’è Fetch.ai

Fetch.ai è un ecosistema blockchain che sfrutta IA e automazione per abilitare agenti economici autonomi: entità digitali che eseguono in modo indipendente compiti per conto di utenti, dispositivi o organizzazioni.

Fondata nel 2017 e lanciata tramite IEO su Binance nel marzo 2019, Fetch.ai mira a democratizzare l’accesso alla tecnologia di IA attraverso una rete decentralizzata.

La caratteristica distintiva della piattaforma è costituita dagli Autonomous Economic Agents (AEA).

Si tratta di entità software che operano con un certo grado di autonomia, svolgendo compiti come ottimizzare le catene di approvvigionamento, gestire la distribuzione di energia nelle smart grid, coordinare reti di trasporto e automatizzare il trading DeFi. Gli agenti si scoprono e negoziano tra loro tramite un Open Economic Framework, creando un’economia machine-to-machine.

Il CEO Humayun Sheikh guida un team che immagina sistemi basati su IA in grado di spezzare il monopolio dei dati detenuto dalle grandi aziende tech. Distribuendo le capacità di IA su una rete decentralizzata, Fetch.ai si posiziona come infrastruttura per l’“agentic economy”, un futuro in cui agenti autonomi rappresentano individui e dispositivi in innumerevoli micro-transazioni e compiti di coordinamento.

Utilità di FET

Il token FET funge da principale mezzo di scambio nell’ecosistema Fetch.ai.

Quando due agenti si connettono, comunicano e negoziano, uno paga l’altro per dati o servizi utilizzando FET. Importante, il token supporta micropagamenti di frazioni di centesimo, abilitando le transazioni granulari richieste da un’economia machine-to-machine.

FET ha diverse funzioni specifiche. Paga le commissioni di transazione della rete e il deployment dei servizi di IA. Gli sviluppatori che costruiscono agenti autonomi pagano in FET per accedere alle utilità di machine learning e alle risorse computazionali della rete. Gli utenti possono mettere in staking FET per partecipare alla sicurezza della rete tramite il meccanismo di consenso Proof-of-Stake di Fetch.ai, guadagnando ricompense contribuendo ai nodi validatori.

Gli agenti devono anche depositare FET per registrarsi sulla rete, creando un requisito di staking che finanzia il loro diritto a operare. Questo meccanismo di deposito assicura che gli agenti abbiano “skin in the game” economica, riducendo lo spam e incentivando contributi di qualità.

Tokenomics e struttura

FET esiste in più forme su diverse blockchain. Originariamente lanciato come token ERC-20 su Ethereum, Fetch.ai ha successivamente distribuito la propria mainnet costruita nell’ecosistema Cosmos. Gli utenti possono effettuare il bridge tra la versione nativa e il formato ERC-20, con la scelta che incide sulle commissioni di transazione e sulla compatibilità con diversi ecosistemi DeFi.

La fornitura massima è di circa 1 miliardo di token FET, sebbene distribuzione esatta e programmi di vesting varino.

Il token opera sia su Ethereum (per la compatibilità ERC-20) sia su Binance Smart Chain (come token BEP-20), con un token bridge 1:1 che consente agli utenti di scambiare tra le reti in base alle proprie esigenze.

Fetch.ai fa parte dell’Artificial Superintelligence Alliance, una collaborazione con SingularityNET e Ocean Protocol annunciata nel 2024. L’alleanza mira a creare un ecosistema di IA decentralizzata unificato con una capitalizzazione di mercato combinata mirata alla top-20 delle criptovalute.

I detentori dei token AGIX e OCEAN possono convertirli in FET, potenzialmente consolidando la liquidità e gli sforzi di sviluppo tra i progetti.

Casi d’uso

Le applicazioni di Fetch.ai coprono diversi settori. Nelle smart city, gli agenti coordinano parcheggi e traffico. Un progetto pilota a Cambridge ha dimostrato agenti che trovano autonomamente posti auto, fanno offerte per gli spazi e processano i pagamenti in tempo reale. Integrando il ride-hailing, la rete può assegnare i veicoli in base ai pattern di domanda.

I mercati dell’energia rappresentano un altro caso d’uso importante.

I proprietari di abitazioni con pannelli solari sui tetti distribuiscono agenti che scambiano direttamente l’energia in eccesso con i vicini, bypassando le utility centralizzate. Gli agenti negoziano i prezzi, verificano le transazioni e regolano i pagamenti in FET, creando un marketplace energetico peer-to-peer.

Nella logistica e nella supply chain, gli agenti ottimizzano routing, gestione dell’inventario e selezione dei vettori.

Un’azienda può distribuire un agente che scopre fornitori attraverso la rete, negozia i termini, confronta i prezzi, verifica i punteggi di qualità, effettua ordini, organizza la spedizione e gestisce i pagamenti – tutto in modo autonomo sulla base di parametri predefiniti.

L’automazione DeFi mostra potenziale. Gli agenti possono eseguire strategie di trading complesse, ottimizzare la fornitura di liquidità tra protocolli e gestire le posizioni collaterali nei mercati di lending. A metà 2025, un agente supportato da Fetch.ai ha vinto l’hackathon di UC Berkeley per il coordinamento del traffico aereo, dimostrando capacità nell’assegnare slot di volo, gestire ritardi e negoziare zone di congestione tra agenti autonomi che lavorano con dati in tempo reale.

La partnership con Interactive Strength (TRNR) ha creato agenti di coaching fitness intelligenti che analizzano i dati sulle prestazioni, suggeriscono programmi personalizzatiallenamenti e negoziare piani di training con gli utenti, il tutto regolato tramite pagamenti in FET.

Scenario competitivo e rischi

Fetch.ai compete con altri protocolli incentrati sugli agenti come Autonolas (OLAS), che offre un accelerator program for autonomous agents. Virtuals Protocol è emerso alla fine del 2024 come un importante concorrente, costruendo una piattaforma di lancio per agenti di IA su Base e Solana con un proprio ecosistema di agenti tokenizzati.

La minaccia competitiva più ampia proviene dalle piattaforme di IA centralizzate.

Google, Amazon e Microsoft offrono servizi di IA sofisticati attraverso le loro piattaforme cloud senza richiedere agli utenti di detenere token proprietari.

Per avere successo, il modello di agenti decentralizzati di Fetch.ai deve offrire vantaggi chiari – tutela della privacy, resistenza alla censura, coordinamento diretto peer‑to‑peer – che giustifichino la complessità di gestione degli asset crittografici.

L’incertezza normativa comporta dei rischi. I sistemi di IA che operano in modo autonomo possono essere oggetto di esame nell’ambito delle normative emergenti. L’approccio basato sul rischio dell’AI Act dell’UE potrebbe classificare gli agenti di Fetch.ai come “ad alto rischio” quando operano in settori come energia o logistica, richiedendo audit e supervisione che aumentano i costi operativi.

Persiste lo scetticismo sulla narrativa dell’economia degli agenti.

I critici si chiedono se gli agenti autonomi raggiungeranno un’adozione mainstream o rimarranno una curiosità tecnica di nicchia. Se l’economia machine‑to‑machine non dovesse materializzarsi su larga scala, FET diventerebbe una soluzione in cerca di un problema.

Il 12 novembre 2025, FET veniva scambiato intorno a 0,25–0,30 $, dopo aver sperimentato una significativa volatilità durante l’anno. Il token ha attirato attenzione quando Interactive Strength ha annunciato piani per una tesoreria crypto da 500 milioni di dollari incentrata su FET, segnalando fiducia istituzionale nel potenziale a lungo termine del progetto.

Gli analisti prevedono price targets of $6.71 by 2030, sebbene tali previsioni comportino una sostanziale incertezza. La questione fondamentale è se il coordinamento basato su agenti offra un valore sufficiente a giustificare la tokenomics, o se invece prevarranno alternative centralizzate più semplici.

Gli sviluppi recenti sono promettenti. Fetch.ai ha lanciato un accelerator da 10 milioni di dollari all’inizio del 2025 per investire in startup che costruiscono sulla sua infrastruttura. Questo segnala l’impegno verso la crescita dell’ecosistema oltre il trading speculativo.

Token 3: Analisi approfondita di Render Token (RNDR)

Cos’è Render Network

Render Network is a decentralized GPU rendering platform che connette i creatori che hanno bisogno di potenza computazionale con individui e organizzazioni che offrono risorse GPU inutilizzate. Originariamente concepito nel 2009 dal CEO di OTOY Jules Urbach e lanciato pubblicamente nell’aprile 2020, Render si è evoluto in una delle principali reti decentralizzate di infrastruttura fisica (DePIN) per carichi di lavoro di grafica e IA.

La rete opera come un marketplace peer‑to‑peer. I creatori inviano alla rete job di rendering – grafica 3D, effetti visivi, visualizzazioni architettoniche, inferenza di IA.

Gli operatori di nodo con capacità GPU inutilizzata raccolgono i job e li elaborano in cambio di token RNDR. La piattaforma sfrutta il software di rendering OctaneRender di OTOY, leader nel settore, offrendo capacità di rendering di livello professionale tramite un’infrastruttura distribuita.

Render Network affronta un collo di bottiglia fondamentale: il rendering di alta qualità richiede una potenza GPU massiccia, ma i servizi cloud centralizzati sono costosi e possono risultare a corto di capacità nei periodi di picco. Aggregando GPU sottoutilizzate a livello globale, Render democratizza l’accesso agli strumenti di rendering professionali a una frazione dei costi tradizionali.

Il token di utilità RNDR

Il token RNDR (ora RENDER dopo la migrazione su Solana) funge da network's native utility token. I creatori pagano i servizi di rendering in RENDER, con costi determinati dalla potenza GPU richiesta, misurata in OctaneBench (OBH) – un’unità standardizzata sviluppata da OTOY per quantificare la capacità di rendering.

Gli operatori di nodo guadagnano RENDER per il completamento dei job.

La rete implementa un sistema di reputazione a livelli: Tier 1 (Trusted Partners), Tier 2 (Priority) e Tier 3 (Economy). Gli operatori di nodo di livello più alto applicano tariffe premium ma offrono affidabilità garantita. I punteggi di reputazione dei creatori influenzano la velocità di assegnazione dei job: chi ha una solida cronologia accede alle risorse più rapidamente.

Governance rights accompany RENDER tokens. I detentori votano su aggiornamenti della rete, modifiche del protocollo e proposte di finanziamento tramite la Render DAO. Questa governance decentralizzata assicura che sia la community, e non solo una fondazione centralizzata, a modellare l’evoluzione della rete.

Il meccanismo di Burn‑and‑Mint Equilibrium implementato a gennaio 2023 gestisce dinamicamente l’offerta di token. Quando i creatori pagano per il rendering, il 95% dei token viene bruciato, rimuovendolo dalla circolazione. Gli operatori di nodo ricevono token di nuova emissione per mantenere l’equilibrio economico. Questo design rende RENDER potenzialmente deflazionistico man mano che l’utilizzo della rete cresce, poiché il tasso di burn può superare il tasso di mint se la domanda è forte.

Tokenomics

RENDER è migrato da Ethereum a Solana alla fine del 2023 a seguito di una community vote. Questa transizione mirava a sfruttare le transazioni più rapide e le commissioni più basse di Solana. L’originario token RNDR (ERC‑20) su Ethereum è stato aggiornato a RENDER (token SPL) su Solana. La fornitura totale è limitata a 644.168.762 token, con circa 517 milioni in circolazione nel 2025.

La distribuzione dei token ha allocato il 25% alle vendite pubbliche, il 10% alle riserve e il 65% detenuto in escrow per modulate supply-demand flows. Questa riserva consente alla fondazione di gestire la disponibilità di token man mano che la rete scala.

Casi d’uso

Render Network serve diversi settori. Le società di produzione cinematografica e televisiva utilizzano la rete per il rendering degli effetti visivi. I grandi studi hanno eseguito il rendering di progetti utilizzando nodi decentralizzati, dimostrando la capacità del sistema di supportare workflow professionali con crittografia end‑to‑end a tutela della proprietà intellettuale.

Gli sviluppatori di videogiochi sfruttano Render per la creazione di asset 3D e il rendering in tempo reale.

I progetti metaverse si affidano alla rete per generare ambienti immersivi e grafica degli avatar. La scalabilità della potenza GPU distribuita consente ai creatori di attivare capacità di rendering on‑demand senza investire in costoso hardware locale.

Architetti e product designer utilizzano Render per high-quality 3D visualizations. Gli studi di architettura creano walkthrough in realtà virtuale degli edifici prima della costruzione. I designer di prodotto eseguono prototipazione su larga scala, testando texture e colori tramite rendering GPU parallelizzato.

L’inferenza di IA rappresenta un caso d’uso in crescita.

Nel luglio 2025, Render ha integrato GPU NVIDIA RTX 5090 specificamente per carichi di lavoro di calcolo IA negli Stati Uniti. L’addestramento di alcuni modelli di IA, specialmente quelli che coinvolgono generazione di immagini o video, trae vantaggio dalla potenza GPU distribuita. L’infrastruttura della rete può accelerate AI training in modo significativo rispetto alle configurazioni su singola macchina.

Dinamiche competitive

Render compete sia con provider centralizzati sia con provider decentralizzati. I tradizionali servizi di cloud GPU di AWS, Google Cloud e provider specializzati come CoreWeave offrono interfacce semplificate e SLA affidabili. Tuttavia, applicano prezzi premium e possono avere capacità limitata nei periodi di picco.

Nello spazio decentralizzato, i concorrenti includono Akash Network (AKT), io.net (IO) e Aethir. Ogni piattaforma affronta in modo diverso il coordinamento del marketplace GPU – Akash si concentra su un’infrastruttura cloud più ampia, io.net enfatizza i carichi di lavoro di IA/ML, Aethir punta su gaming e intrattenimento. Render si differenzia attraverso la sua integrazione con il software di rendering professionale di OTOY e la sua reputazione consolidata tra i professionisti creativi.

Rimane aperta la questione della cattura di valore. Il calcolo GPU sta diventando sempre più una commodity man mano che più provider entrano nel mercato.

Render deve dimostrare che il suo modello decentralizzato offre vantaggi chiari – efficienza dei costi, disponibilità globale, resistenza alla censura – che giustifichino l’uso di token crittografici invece delle carte di credito presso provider centralizzati.

La partnership con grandi aziende offre una forma di validazione. Ari Emanuel (Co‑CEO di Endeavor) has publicly supported Render Network, firmando accordi con Disney, HBO, Facebook e Unity. Queste partnership segnalano un riconoscimento mainstream, anche se rimane la sfida di trasformare tali relazioni in un utilizzo consistente della rete.la sfida.

Il 12 novembre 2025, RENDER scambiava intorno a 4,50-5,00 $, con una capitalizzazione di mercato vicina a 2,5-3 miliardi di dollari. Il token ha vissuto una crescita significativa nel 2024, salendo di oltre il 13.300% rispetto al suo prezzo iniziale all’inizio del 2024, anche se in seguito ha consolidato. Gli analisti attribuiscono ciò alle narrazioni su AI e GPU/NVIDIA, con la partnership con Apple che fornisce ulteriore credibilità.

I rischi includono la concorrenza di provider centralizzati che scalano in modo più efficiente, il potenziale di centralizzazione dell’hardware man mano che l’economia del mining favorisce i grandi operatori, e il dubbio se i marketplace decentralizzati di GPU riusciranno a ottenere un’adozione sostenibile o rimarranno soluzioni di nicchia.

Analisi comparativa: token di utilità vs token riserva di valore

I token di utilità per l’AI operano su proposizioni di valore fondamentalmente diverse rispetto ai token riserva di valore come Bitcoin ed Ethereum. Comprendere queste distinzioni fa luce sia sulle opportunità sia sulle sfide che il segmento dei token di utilità deve affrontare.

Scopo e driver della domanda

Il valore di Bitcoin deriva principalmente dal suo posizionamento come oro digitale – una riserva di valore scarsa, decentralizzata e copertura contro l’inflazione monetaria. Il limite di 21 milioni di BTC e una capitalizzazione di mercato superiore ai 2.000 miliardi di dollari lo posizionano come asset macro. Ethereum aggiunge programmabilità, traendo valore dal ruolo di livello di regolamento per protocolli DeFi, NFT e altre applicazioni, con la domanda di ETH che proviene dalle commissioni di gas e dai requisiti di staking.

I token di utilità come TAO, FET e RENDER traggono invece valore dall’utilizzo della rete. Teoricamente la domanda è correlata ai job computazionali elaborati, agli agenti distribuiti e alle attività di rendering completate. Un maggior numero di modelli di AI addestrati su Bittensor dovrebbe aumentare la domanda di TAO per accedere all’intelligenza. Più agenti autonomi su Fetch.ai dovrebbero alimentare le transazioni in FET. Un maggior numero di job di rendering dovrebbe bruciare più token RENDER.

Tokenomics e governance

I token riserva di valore enfatizzano la scarsità. La fornitura fissa e i cicli di halving di Bitcoin creano una riduzione prevedibile dell’emissione. Ethereum è passato al Proof-of-Stake con EIP-1559 che brucia le commissioni di transazione, introducendo pressione deflazionistica quando l’utilizzo della rete è elevato.

I token di utilità adottano approcci differenti. Bittensor replica il modello di halving di Bitcoin, creando scarsità. Il Burn-and-Mint Equilibrium di Render lega l’offerta all’utilizzo: un’elevata domanda brucia più token di quanti ne vengano coniati, riducendo l’offerta. Fetch.ai mantiene una fornitura fissa ma fa affidamento sugli incentivi di staking per ridurre la velocità di circolazione.

La governance è notevolmente diversa. Bitcoin mantiene un approccio di sviluppo conservativo con modifiche minime al protocollo.

Ethereum utilizza coordinamento off-chain e un consenso approssimativo finale. I token di utilità spesso implementano una governance on-chain diretta in cui i detentori votano sugli aggiornamenti del protocollo, sulle proposte di finanziamento e sugli aggiustamenti dei parametri, dando alle comunità una gestione più attiva.

Percorsi di adozione e base utenti

I token riserva di valore mirano a investitori che cercano esposizione agli asset crypto o coperture contro la finanza tradizionale. Bitcoin attrae chi crede nei principi di “sound money”. Ethereum attrae sviluppatori e utenti che interagiscono con applicazioni DeFi e Web3.

I token di utilità devono attrarre tipologie di utenti specifiche. Bittensor ha bisogno che ricercatori di AI e data scientist scelgano l’addestramento di modelli decentralizzato al posto dei framework consolidati. Fetch.ai richiede sviluppatori che costruiscano agenti autonomi per applicazioni reali. Render ha bisogno che i professionisti creativi si fidino dell’infrastruttura decentralizzata per i flussi di lavoro in produzione.

Queste barriere all’adozione sono più ripide. Gli sviluppatori affrontano costi di switching dagli strumenti esistenti. Le imprese richiedono affidabilità e supporto che le reti decentralizzate nascenti potrebbero faticare a fornire. I token di utilità devono dimostrare vantaggi chiari – costo, prestazioni, funzionalità – per superare l’inerzia.

Meccanismi di cattura del valore

I token riserva di valore catturano valore tramite scarsità ed effetti di rete.

Man mano che più partecipanti riconoscono Bitcoin come riserva di valore, la domanda aumenta mentre l’offerta rimane fissa, spingendo i prezzi verso l’alto. Questo circolo speculativo si autoalimenta, anche se crea volatilità.

I token di utilità affrontano il problema della velocità. Se gli utenti convertono immediatamente i token guadagnati in fiat o in altre crypto, l’alta velocità impedisce l’accumulo di valore. L’Equazione di scambio (M×V = P×Q) suggerisce che, a parità di volume di transazioni (P×Q), una velocità (V) più alta implica una capitalizzazione di mercato (M) più bassa.

I protocolli mitigano la velocità tramite diversi meccanismi. I requisiti di staking bloccano i token, riducendo l’offerta circolante. Bittensor richiede ai validatori di mettere in staking TAO. Fetch.ai ricompensa gli staker con le commissioni di rete. Meccanismi di burn come quello di Render rimuovono permanentemente token dalla circolazione. I diritti di governance creano incentivi a detenere token per il potere di voto.

Performance di mercato e traiettorie

Bitcoin ha toccato massimi storici oltre 126.000 $ nel 2025, proseguendo la sua traiettoria come asset macro. Ethereum si è ripreso dai ribassi post-2022, mantenendo la propria posizione di principale piattaforma di smart contract.

I token di utilità per l’AI hanno mostrato una performance più volatile. TAO ha scambiato tra 200-750 $ nel 2024-2025, con capitalizzazione di mercato a 3,7-4,1 miliardi di dollari ai picchi. FET ha vissuto movimenti significativi, in particolare intorno all’annuncio dell’Artificial Superintelligence Alliance. RENDER ha registrato una crescita esplosiva nel 2023-2024 prima di consolidare.

Questi token scambiano sia sulla base della speculazione sia dei fondamentali. Quando le narrazioni AI dominano il discorso crypto, i token di utilità sovraperformano. Nei periodi di ribasso, spesso sottoperformano Bitcoin ed Ethereum mentre gli investitori si rifugiano negli asset percepiti come più sicuri.

Coesistenza o competizione?

La questione è se i token di utilità rappresentino la “prossima ondata” o coesistano come categoria complementare. Le evidenze suggeriscono che la coesistenza sia più probabile. I token riserva di valore hanno funzioni diverse rispetto ai token operativi. Bitcoin funziona come oro digitale, Ethereum come livello di regolamento programmabile, mentre i token di utilità agiscono come carburante per applicazioni specifiche.

Tuttavia il successo non è garantito. La maggior parte dei token di utilità potrebbe fallire se l’utilizzo non si materializza o se le alternative centralizzate si dimostrano superiori. La capitalizzazione del mercato AI-crypto ha raggiunto 24-27 miliardi di dollari nel 2025, significativa ma piccola rispetto al solo Bitcoin che supera i 2.000 miliardi.

I probabili vincitori dimostreranno:

- Utilizzo di rete sostenuto in crescita indipendentemente dalla speculazione

- Vantaggi chiari rispetto alle alternative centralizzate

- Ecosistemi di sviluppatori solidi e adozione da parte delle imprese

- Mitigazione efficace della velocità tramite staking o burning

- Modelli di governance che bilanciano decentralizzazione ed efficienza

Il test finale è se i token di utilità diventeranno infrastruttura per carichi di lavoro AI su larga scala o se rimarranno soluzioni di nicchia offuscate dai provider cloud centralizzati.

Valutazione, metriche di adozione e rischio narrativo

Valutare i token di utilità richiede schemi diversi rispetto alla valutazione degli asset riserva di valore. Mentre Bitcoin può essere valutato tramite modelli stock-to-flow o come oro digitale paragonabile ai metalli preziosi, i token di utilità richiedono metriche basate sull’uso.

Metriche chiave per i token di utilità

Le statistiche di utilizzo della rete forniscono le fondamenta. Per Bittensor, le metriche significative includono:

- Numero di subnet attive e le loro specializzazioni

- Ore di calcolo dedicate all’addestramento dei modelli

- Conteggio di miner e validator che mettono in sicurezza la rete

- Volume di transazioni che fluisce attraverso il protocollo

- Distribuzioni di modelli di successo che servono applicazioni reali

Bittensor riporta 128 subnet attive alla fine del 2025, un aumento sostanziale rispetto ai periodi precedenti. Tuttavia, valutare se queste subnet generino domanda genuina rispetto ad attività speculative richiede un’analisi più approfondita.

Per Fetch.ai, le metriche rilevanti includono:

- Numero di agenti autonomi distribuiti

- Interazioni agente-agente e volume di transazioni

- Integrazioni nel mondo reale in vari settori

- Partnership con imprese o governi

- Partecipazione allo staking e numero di validator

Fetch.ai ha dimostrato proof-of-concept in coordinamento dei parcheggi, trading energetico e logistica, ma la sfida rimane quella di scalare dai progetti pilota a un’adozione diffusa.

Per Render Network, gli indicatori critici sono:

- Job di rendering elaborati mensilmente

- Numero di node operator attivi che forniscono capacità GPU

- Client enterprise che utilizzano la rete per flussi di lavoro in produzione

- Tasso di burn rispetto al tasso di mint nel modello Burn-and-Mint Equilibrium

- Ore GPU utilizzate sulla rete decentralizzata

Render ha ottenuto partnership con grandi studi e gestisce job di rendering reali, fornendo evidenze d’uso più concrete rispetto a molti token di utilità.

Velocità del token e metriche di burn

La velocità del token misura la rapidità con cui i token circolano nell’economia. Un’alta velocità indica che gli utenti spendono o convertono immediatamente i token, impedendo l’accumulo di valore. Una bassa velocità suggerisce che i token vengono detenuti più a lungo, potenzialmente come riserva di valore o per staking rewards.

Bitcoin mostra una velocità del 4,1%, Ethereum del 3,6%, indicando asset maturi prevalentemente detenuti piuttosto che transati. I token di utilità tipicamente mostrano velocità più elevate inizialmente, poiché gli utenti ricevono token per il lavoro svolto e li convertono immediatamente in valute stabili.

I meccanismi di burn contrastano l’alta velocità. Il sistema di Render brucia il 95% dei token di pagamento a ogni transazione, rimuovendo offerta. Se il tasso di burn supera il tasso di mint, l’offerta circolante diminuisce, potenzialmente sostenendo l’apprezzamento del prezzo se la domanda rimane costante.

Valutare i burn richiede trasparenza. I progetti dovrebbero pubblicare regolarmente report sui burn che mostrino i token rimossi dalla circolazione. Render fornisce questi dati, permettendo la verifica indipendente delle affermazioni deflazionistiche.

Partnership e Integrazioni nel Mondo Reale

L’adozione da parte delle imprese segnala una reale utilità. Il primo lancio ETP di Bittensor su SIX Swiss Exchange offre accesso istituzionale. I 500 milioni di dollari di tesoreria FET di Interactive Strength dimostrano fiducia aziendale. Le partnership di Render con Disney, HBO e Unity convalidano le capacità della piattaforma per i flussi di lavoro di produzione.

Tuttavia, le sole partnership non garantiscono un utilizzo sostenuto. Molti progetti blockchain annunciano partnership che non si traducono in ricavi significativi o attività di rete. Monitorare il volume reale di transazioni derivante dalle relazioni con le imprese fornisce una visione più chiara.

Rischi di Narrazione

Diversi rischi di narrazione minacciano le valutazioni dei token di utilità:

Hype su AI + Crypto senza risultati: La convergenza tra AI e blockchain crea narrazioni potenti, ma se i sistemi di AI decentralizzata non riescono a eguagliare le prestazioni delle alternative centralizzate, le valutazioni si sgonfiano. La maggior parte degli esperti si aspetta che solo pochi progetti AI-crypto abbiano successo nel lungo periodo, con molti che resteranno speculativi.

Potenza di calcolo senza domanda: Costruire infrastrutture GPU decentralizzate è inutile se gli sviluppatori non le utilizzano. Se l’uso non riesce a scalare oltre i primi adottanti e gli evangelisti, i token diventano soluzioni in cerca di problemi. La domanda è se il compute decentralizzato possa catturare una quota di mercato significativa da AWS, Google Cloud e altri giganti centralizzati.

Minacce normative: I governi di tutto il mondo stanno sviluppando regolamentazioni per l’AI. Il quadro basato sul rischio dell’AI Act dell’UE potrebbe classificare alcuni sistemi di AI come ad alto rischio, richiedendo audit e supervisione. Gli agenti autonomi che prendono decisioni economiche potrebbero essere sottoposti a scrutinio. L’incertezza sul fatto che i token di utilità costituiscano o meno titoli aggiunge rischio regolamentare.

Centralizzazione dell’hardware: Le reti decentralizzate rischiano di recentralizzarsi. Se il mining o l’operatività dei nodi diventano economicamente sostenibili solo per i grandi attori con economie di scala, la promessa di decentralizzazione svanisce. Le reti GPU potrebbero consolidarsi attorno ai principali data center, vanificando lo scopo di un’infrastruttura peer‑to‑peer.

Limitazioni tecniche: I sistemi decentralizzati affrontano compromessi intrinseci. I costi di coordinamento, la latenza e i problemi di affidabilità possono impedire ai token di utilità di competere con alternative centralizzate ottimizzate. Se le limitazioni tecniche si rivelano insormontabili, l’adozione si blocca.

Framework di Valutazione

I modelli finanziari tradizionali faticano con i token di utilità. Il Discounted Cash Flow (DCF) funziona per i token con profit‑sharing—Augur paga i detentori di REP per il lavoro sulla rete, creando flussi di cassa adatti all’analisi DCF. Ma i token di pura utilità senza dividendi non hanno flussi di cassa ovvi da scontare.

La Equation of Exchange offre un approccio: M×V = P×Q, dove M è la market cap (ciò che vogliamo determinare), V è la velocità, P è il prezzo per transazione e Q è la quantità di transazioni. Riorganizzando: M = P×Q / V. Questo implica che la market cap è pari al volume delle transazioni diviso per la velocità.

Un volume di transazioni più alto (P×Q) sostiene valutazioni più elevate. Una velocità (V) più bassa sostiene anch’essa valutazioni più elevate. I progetti devono quindi aumentare l’utilizzo o ridurre la velocità – idealmente entrambi. Lo staking riduce la velocità; i meccanismi di burn riducono l’offerta; la reale utilità aumenta il volume di transazioni.

La Legge di Metcalfe suggerisce che il valore di una rete cresce in proporzione al quadrato degli utenti. Man mano che più partecipanti si uniscono a Bittensor, Fetch.ai o Render, gli effetti di rete potrebbero guidare una crescita di valore esponenziale. Tuttavia, questa legge presuppone che tutte le connessioni siano preziose – cosa non sempre vera per le reti nelle fasi iniziali.

La valutazione comparativa esamina progetti simili. Se Bittensor raggiunge un utilizzo di rete simile a SingularityNET o Ocean Protocol, confrontare le market cap fornisce benchmark approssimativi. Tuttavia, la tokenomics e i casi d’uso unici di ciascun progetto limitano l’utilità del confronto diretto.

In definitiva, la valutazione dei token di utilità rimane speculativa. Finché le reti non dimostrano un utilizzo sostenuto indipendente dalla speculazione, i prezzi riflettono la forza della narrazione e il sentiment di mercato tanto quanto il valore fondamentale.

Cosa Succede Dopo: Scenari per il Futuro

La traiettoria dei token di utilità AI dipende da diverse variabili incerte: tassi di adozione tecnologica, sviluppi regolamentari, concorrenza da parte dei provider centralizzati e capacità dei token di catturare valore dall’utilizzo della rete. Tre ampi scenari illuminano i possibili futuri.

Scenario Migliore: i Token di Infrastruttura Diventano Livello Centrale

In questo scenario ottimistico, l’infrastruttura AI decentralizzata raggiunge l’adozione mainstream. Bittensor diventa la piattaforma preferita per l’addestramento collaborativo di modelli di AI, attirando grandi istituzioni di ricerca e imprese. L’architettura delle subnet si dimostra superiore ai framework centralizzati per alcuni casi d’uso – AI per la sanità rispettosa della privacy, marketplace di modelli decentralizzati, intelligenza collettiva crowdsourced.

Gli agenti autonomi di Fetch.ai proliferano in tutti i settori. Le città intelligenti implementano reti di agenti per il coordinamento del traffico, la distribuzione dell’energia e i servizi pubblici. Le supply chain si standardizzano sull’ottimizzazione basata su agenti. I protocolli DeFi integrano agenti per l’esecuzione automatizzata delle strategie. L’“economia agentica” si materializza come previsto, con miliardi di micro‑transazioni coordinate da software autonomo.

Render Network cattura una quota di mercato significativa dai provider GPU centralizzati. I professionisti creativi e i ricercatori AI utilizzano regolarmente il compute decentralizzato per i flussi di lavoro in produzione. Il mercato globale del cloud gaming, previsto a 121 miliardi di dollari entro il 2032, alimenta la domanda di infrastrutture GPU distribuite.

In questo scenario, i token di utilità ottengono valore duraturo grazie a:

- Crescita d’uso sostenuta: L’attività di rete aumenta indipendentemente dalla speculazione

- Mitigazione della velocità: Staking, burning e incentivi di governance fanno sì che i token vengano detenuti anziché venduti subito

- Effetti di rete: Più utenti si uniscono, più le piattaforme diventano preziose per tutti

- Chiarezza regolamentare: Emergenza di framework che accolgono l’AI decentralizzata proteggendo i consumatori

I prezzi dei token potrebbero raggiungere le proiezioni più ottimistiche degli analisti – TAO oltre i 1.000 dollari, FET vicino a 6‑10 dollari, RENDER oltre i 20 dollari – se i fondamentali di utilizzo giustificano le valutazioni. Le market cap crescerebbero proporzionalmente, con i principali token di utilità AI potenzialmente in grado di raggiungere valutazioni tra 20 e 50 miliardi di dollari, catturando porzioni dei mercati dell’AI e del cloud computing da trilioni di dollari.

Per gli investitori, ciò rappresenta un significativo apprezzamento rispetto ai livelli attuali. Per gli sviluppatori, convalida l’infrastruttura decentralizzata come alternativa praticabile ai provider cloud centralizzati. Per i mercati crypto, dimostra che i token di utilità possono evolvere oltre la speculazione, diventando asset infrastrutturali funzionali.

Also Read: Bitcoin Goes Below $67K After Trump Vows To Bomb Iran To 'Stone Ages'

Scenario di Base: Alcuni Token Hanno Successo, Molti si Stabilizzano

Uno scenario più realistico riconosce che solo una parte degli attuali token di utilità AI raggiungerà un’adozione sostenuta. I vincitori si distinguono grazie a tecnologia superiore, ecosistemi forti, partnership reali ed efficaci meccanismi di cattura del valore. La maggior parte dei progetti si stabilizza o scompare quando gli utenti riconoscono l’utilità pratica limitata.

In questo scenario, Bittensor, Fetch.ai e Render – in quanto progetti leader – hanno maggiori probabilità rispetto ai concorrenti più piccoli. Tuttavia, anche questi affrontano sfide. L’AI decentralizzata risulta preziosa per nicchie specifiche—applicazioni critiche per la privacy, reti resistenti alla censura, alcuni ambiti di ricerca—ma non riesce a sostituire i provider centralizzati per la maggior parte dei casi d’uso.

I token store‑of‑value restano dominanti. Bitcoin consolida la sua posizione di oro digitale. Ethereum continua a fungere da principale livello di regolamento per le applicazioni decentralizzate. I token di utilità AI coesistono come infrastruttura per applicazioni specializzate piuttosto che piattaforme generaliste.

I prezzi dei token riflettono una crescita d’uso moderata. TAO potrebbe raggiungere 500‑800 dollari, FET 2‑4 dollari, RENDER 8‑12 dollari nei prossimi anni – un apprezzamento significativo ma lontano dalle previsioni esplosive. Le market cap crescono ma rimangono ordini di grandezza al di sotto di Bitcoin ed Ethereum.

Diversi fattori caratterizzano questo scenario di base:

- Adozione di nicchia: I token di utilità servono efficacemente verticali o casi d’uso specifici

- Concorrenza centralizzata: AWS, Google Cloud e altri giganti mantengono il dominio per il compute generico

- Oneri regolamentari: I requisiti di conformità aggiungono attriti alle piattaforme decentralizzate

- Compromessi tecnici: per molte applicazioni, i sistemi decentralizzati risultano più lenti, più complessi o meno affidabili rispetto alle alternative centralizzate.

Per gli investitori, un apprezzamento moderato ricompensa i primi sostenitori ma non raggiunge le proiezioni più rialziste. Per i mercati crypto, i token di utilità acquisiscono legittimità come categoria di asset distinta dai token “store-of-value”, ma con valutazioni più moderate.

Scenario negativo: l’utilizzo non si materializza

Lo scenario pessimista vede i token di utilità incapaci di tradurre le capacità tecniche in una domanda sostenuta. Nonostante un’infrastruttura impressionante, gli utenti non migrano dalle piattaforme consolidate. Gli sviluppatori continuano a usare TensorFlow, PyTorch e il cloud computing centralizzato invece di imparare nuovi protocolli decentralizzati. I professionisti creativi restano fedeli ad Adobe, Autodesk e ai render farm tradizionali invece di sperimentare alternative abilitate dalle criptovalute.

In questo scenario, i token AI di utilità diventano principalmente asset speculativi. I prezzi fluttuano in base al sentiment più ampio del mercato crypto e ai cicli di hype sull’AI, piuttosto che sull’utilizzo fondamentale. Quando le narrative si esauriscono – come è avvenuto per molti token ICO del 2017-2018 – le valutazioni crollano.

Diverse dinamiche potrebbero produrre questo esito:

- Attrito nell’esperienza utente: la gestione dei wallet, il pagamento delle gas fee e la navigazione nei protocolli decentralizzati risultano troppo macchinosi per gli utenti mainstream

- Gap di performance: le alternative centralizzate rimangono più veloci, più affidabili e più ricche di funzionalità rispetto alle opzioni decentralizzate

- Sostenibilità economica: la tokenomics non riesce ad allineare correttamente gli incentivi, causando abbandono dei provider, problemi di qualità o instabilità della rete

- Repressione normativa: i governi classificano i token di utilità come titoli o vietano determinate applicazioni, limitandone l’uso legale

I prezzi dei token tornerebbero a minimi speculativi. TAO potrebbe scendere sotto i 200 $, FET sotto 0,50 $, RENDER sotto i 3 $, man mano che gli investitori riconoscono la mancanza di domanda fondamentale. I progetti potrebbero sopravvivere grazie a comunità dedicate ma senza raggiungere una scala significativa.

Questo scenario rappresenta un rischio esistenziale per la categoria dei token di utilità. Se i progetti di punta, con finanziamenti consistenti, team di talento e partnership reali, non riescono a dimostrare il product-market fit, ciò suggerisce che il modello AI/compute decentralizzato non funziona fondamentalmente su larga scala.

Also Read: Dogecoin Drops Below $0.089 On Bearish Signals

Implicazioni nei vari scenari

Per gli investitori: i profili rischio-rendimento variano drasticamente tra gli scenari. Nel caso migliore, si ottengono ritorni multipli sull’investimento, ma solo se diverse incertezze si risolvono in modo favorevole. Lo scenario di base offre un apprezzamento modesto con un rischio inferiore. Lo scenario negativo implica perdite significative.

La costruzione del portafoglio dovrebbe tenere conto delle probabilità dei vari scenari. Allocare piccole percentuali ai token di utilità offre un upside asimmetrico se si realizza il caso migliore, limitando al contempo l’esposizione al downside. Concentrarsi sui token di utilità invece che sugli asset “store-of-value” aumenta volatilità e rischio.

Per gli sviluppatori: costruire su piattaforme basate su token di utilità richiede una valutazione della loro sostenibilità a lungo termine. Se si concretizzano lo scenario di base o quello negativo, le applicazioni sviluppate su queste piattaforme potrebbero faticare a trovare utenti o finanziamenti. Gli sviluppatori dovrebbero mantenere opzionalità, progettando applicazioni portabili tra più piattaforme o in grado di operare con backend centralizzati se l’infrastruttura decentralizzata si dimostra inadeguata.

Per la struttura del mercato crypto: il successo o il fallimento dei token di utilità plasma l’evoluzione del crypto. Se si realizza il caso migliore, il crypto si espande oltre lo store-of-value e la DeFi, diventando vera infrastruttura. Se prevale lo scenario negativo, il settore resta principalmente un dominio speculativo e finanziario.

Cosa monitorare

Diversi indicatori chiariranno quale scenario si stia concretizzando:

Numero di nodi e partecipazione: la crescita di miner, validatori e provider GPU segnala veri effetti di rete. Una partecipazione stagnante o in calo suggerisce mancanza di sostenibilità economica.

Job di calcolo elaborati: job di rendering effettivi, training di modelli AI e interazioni tra agenti – non solo attività su testnet – dimostrano una domanda reale. I progetti dovrebbero pubblicare statistiche d’uso trasparenti.

Partnership aziendali: trasformare le partnership annunciate in volumi di transazione misurabili convalida i modelli di business. Partnership senza utilizzo associato indicano possibile vaporware.

Burn e staking dei token: per i progetti con meccanismi di burn, un tasso di burn superiore al tasso di mint indica una domanda forte. Un’elevata partecipazione allo staking riduce la velocità di circolazione e mostra fiducia dei detentori di lungo termine.

Attività degli sviluppatori: ecosistemi di sviluppo in crescita – misurati tramite commit su GitHub, nuovi protocolli costruiti sopra le piattaforme, partecipazione agli hackathon – segnalano fondamenta sane. Un calo dell’interesse degli sviluppatori preannuncia stagnazione.

Chiarezza normativa: framework più chiari riguardo ai token di utilità, ai sistemi di AI e all’infrastruttura decentralizzata riducono l’incertezza. Regolamentazioni favorevoli accelerano l’adozione; quelle restrittive la frenano.

Ecosistemi hardware: l’integrazione con i principali produttori di GPU o provider cloud legittima il compute decentralizzato. Partnership o riconoscimenti da parte di Nvidia, AMD e altri nei confronti delle piattaforme di token di utilità rappresenterebbero un segnale di validazione mainstream.

Monitorare queste metriche tra il 2025 e il 2027 chiarirà se i token di utilità per l’AI rappresentano una vera innovazione infrastrutturale o principalmente veicoli speculativi. Questa distinzione determinerà se questi asset otterranno un ruolo duraturo nei mercati crypto o svaniranno come l’ennesimo ciclo narrativo concluso.

Considerazioni finali

I token di utilità per l’AI rappresentano un’evoluzione significativa nella narrativa architetturale del crypto. Bittensor, Fetch.ai e Render Network dimostrano che i token possono avere funzioni oltre lo store-of-value o la pura speculazione: possono coordinare infrastrutture decentralizzate, incentivare il lavoro computazionale e abilitare economie machine-to-machine.

La tesi di fondo è convincente.

Le reti GPU decentralizzate aggregano risorse sottoutilizzate, riducono i costi e democratizzano l’accesso. Gli agenti autonomi permettono forme di coordinamento su scale impraticabili per la mediazione umana.

Lo sviluppo collaborativo di AI distribuisce la creazione di intelligenza oltre i monopoli dei giganti tech. Queste visioni affrontano problemi reali in termini di scalabilità dell’infrastruttura, accessibilità dell’AI e coordinamento economico.

Tuttavia, il passaggio dalla visione all’adozione sostenuta resta la sfida cruciale. I token di utilità devono dimostrare vantaggi chiari rispetto alle alternative centralizzate, superando al contempo gli attriti intrinseci ai sistemi decentralizzati. Devono catturare valore tramite l’utilizzo e non tramite la speculazione, risolvere il problema della velocità di circolazione attraverso una tokenomics efficace, e raggiungere il product-market fit presso imprese e sviluppatori.

Read Next: XRP Ledger Hits Record 4.49M Transactions Amid Price Decline